PersonaPlex-7Bとは、NVIDIAが公開したフルデュプレックス音声対話モデルです。従来の音声認識(ASR)→推論(LLM)→音声合成(TTS)の構成とは異なり、聞き取りと発話を同時に行う設計が特徴です。この設計により、割り込みや相槌、同時発話といった自然な会話を実現します。

本記事では特徴だけでなく、PersonaPlex-7Bの使い方や料金の考え方、日本語対応状況まで解説します。

PersonaPlex-7Bとは

PersonaPlex-7Bとは、NVIDIAが公開したフルデュプレックス音声対話を実現する音声対話モデルです。プロンプトの構成や従来の音声AIとの比較をもとに、PersonaPlex-7Bの特徴を解説します。

フルデュプレックス音声対話|割り込み・相槌・同時発話

PersonaPlex-7BはNVIDIAが公開したフルデュプレックス(全二重)音声対話を特徴とするAIモデルです。

従来の音声対話システムでは「ユーザが話し終わる → システムが応答する」という半二重(ターンベース)方式が一般的でした。この方式では話している途中でAIが割り込んだり、相槌を打つような振る舞いが難しく、対話の自然さに課題がありました。

フルデュプレックス音声対話は、ユーザとシステムが同時に音声を送受信可能です。つまり、AIがユーザの発話をリアルタイムで聞き、同時に自身の応答を生成・出力します。これにより、人間同士の会話に見られる「割り込み発話」「発話の重なり」「相槌(バックチャンネル)」といった自然な双方向対話の特徴が再現できるようになります。

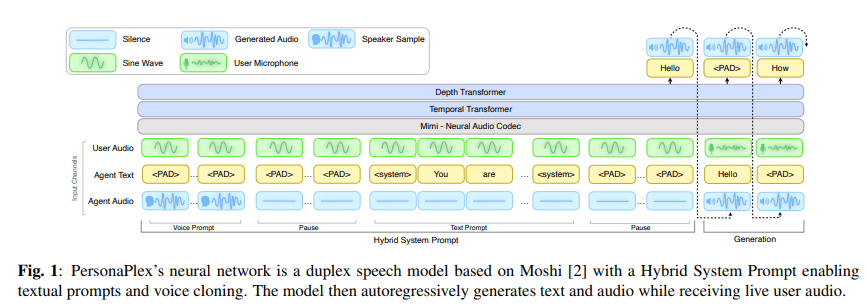

ペルソナ制御(Text Prompt)と声の条件付け(Voice Prompt)の関係

PersonaPlex-7BではText PromptとVoice Promptにより、AIの役割(ペルソナ)や声質を制御できます。

Text Promptでは、Teacher(教師)やCustomer Supportといった役割設定を与えることで、会話中の振る舞い方や応答のスタイルを制御します。

Voice Promptでは話者のアクセント、声質などの音声的特徴を指示することが可能です。

- Text Prompt … 会話におけるAIの役割、背景情報、コンテキスト等を指定

- Voice Prompt … 音声の特徴、話し方、アクセント等を指定

Text PromptとVoice Promptをそれぞれ設定することで、教育・接客・医療受付など特性の異なる会話体験を簡単に実現できます。同じ音声を使いながら異なる性質の音声エージェントを作成できる点が特徴です。

【比較表】従来の音声AI(ASR→LLM→TTS)との違い

従来の音声AIは一般的に、以下の3段階の処理を直列に行います。

- 自動音声認識(ASR: Automatic Speech Recognition)

- 大規模言語モデル(LLM:Large Language Models)

- 音声合成(TTS:Text-to-Speech)

ユーザ音声をテキストに起こし(ASR)、生成AIで応答文を作り(LLM)、最後に音声合成で発話させる(TTS)という流れです。この方式は要素ごとにチューニングできるメリットがありますが、応答までの遅延が大きい、非同時な対話になるといった課題がありました。

一方フルデュプレックス音声対話ではユーザの音声を逐次的に処理し、入力の認識・理解と出力(応答)の生成・音声合成を同時に行います。ユーザが発話中でも、並列でAIが応答を生成できるため、割り込み、重なり、相槌といった自然な対話が可能になります。

PersonaPlexと従来の主な音声AIとの違いは以下の通りです。

| 観点 | PersonaPlex | 従来の音声AI |

|---|---|---|

| 特徴 | 音声の入出力をストリーミングで扱い、聞き取りと発話を並列に実行 | ①音声認識(ASR)→②文章生成(LLM)→③音声合成(TTS)の3段カスケード(直列処理) |

| 会話の進行 | 聞きながら話すが可能 | ターン交代が不自然になりやすい傾向 |

| 割込み | 割り込み・途中応答が可能な設計 | AIによる割り込み/先回りが難しい設計 |

| 相槌 (バックチャンネル) | 低遅延の応答生成・音声出力が可能 | 直列処理のため、相槌のような即時反応は生成しにくい |

| 同時発話 (会話の重なり) | 同時発話を許容する設計 | 同時発話を前提にした設計ではないことが多い |

| 向く用途 | 自然な掛け合いやインタラクティブ体験を重視するケース 例:リアルタイム接客、英会話練習など | 定型フロー/音声UIなどで多く使用 例:コールセンターIVR、読み上げなど |

PersonaPlex-7Bの使い方ガイド

PersonaPlex-7Bは公開モデルとして、誰でも任意の環境で実行可能です。PersonaPlex-7Bを使った音声対話Web UIが公式に提供されているため、すぐに検証可能なWeb UIのデプロイ方法やつまづきポイントについて解説します。

事前準備|Gated modelに同意・Hugging Faceトークン取得

PersonaPlex-7BはHugging Faceで公開されており、ダウンロードして任意の実行環境にデプロイ可能です。ダウンロード前にHugging Face上で必要な操作は以下の通りです。

https://huggingface.co/ にアクセスし、「Log In」ボタンをクリックしてログインします。アカウントがない場合は、「Sign Up」よりアカウントを作成してください。

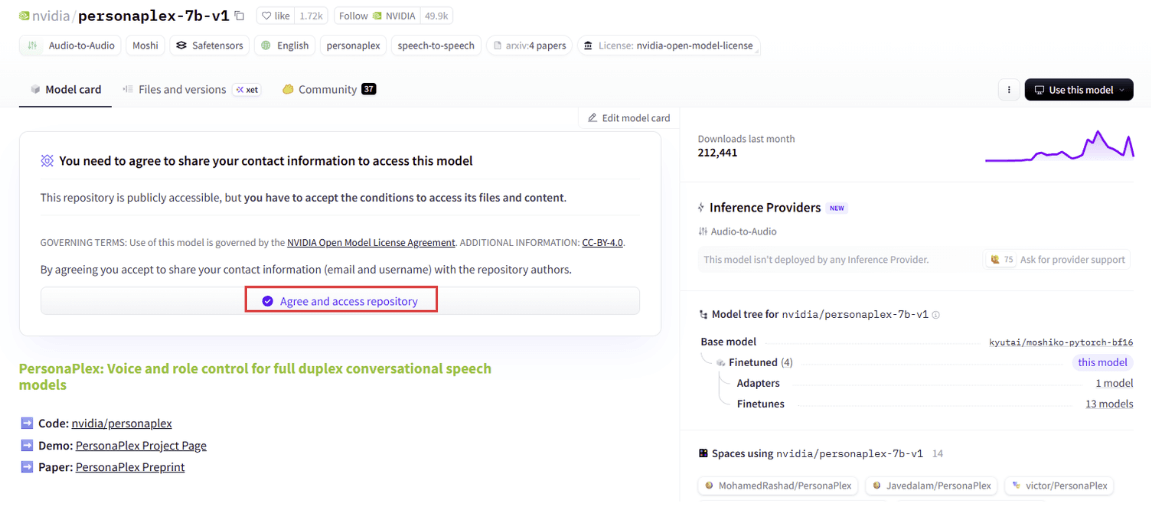

Hugging Faceで公開されているモデルへアクセスするために、利用条件に同意する必要があります。https://huggingface.co/nvidia/personaplex-7b-v1 にアクセスし、「Agree and access repository」ボタンをクリックします。

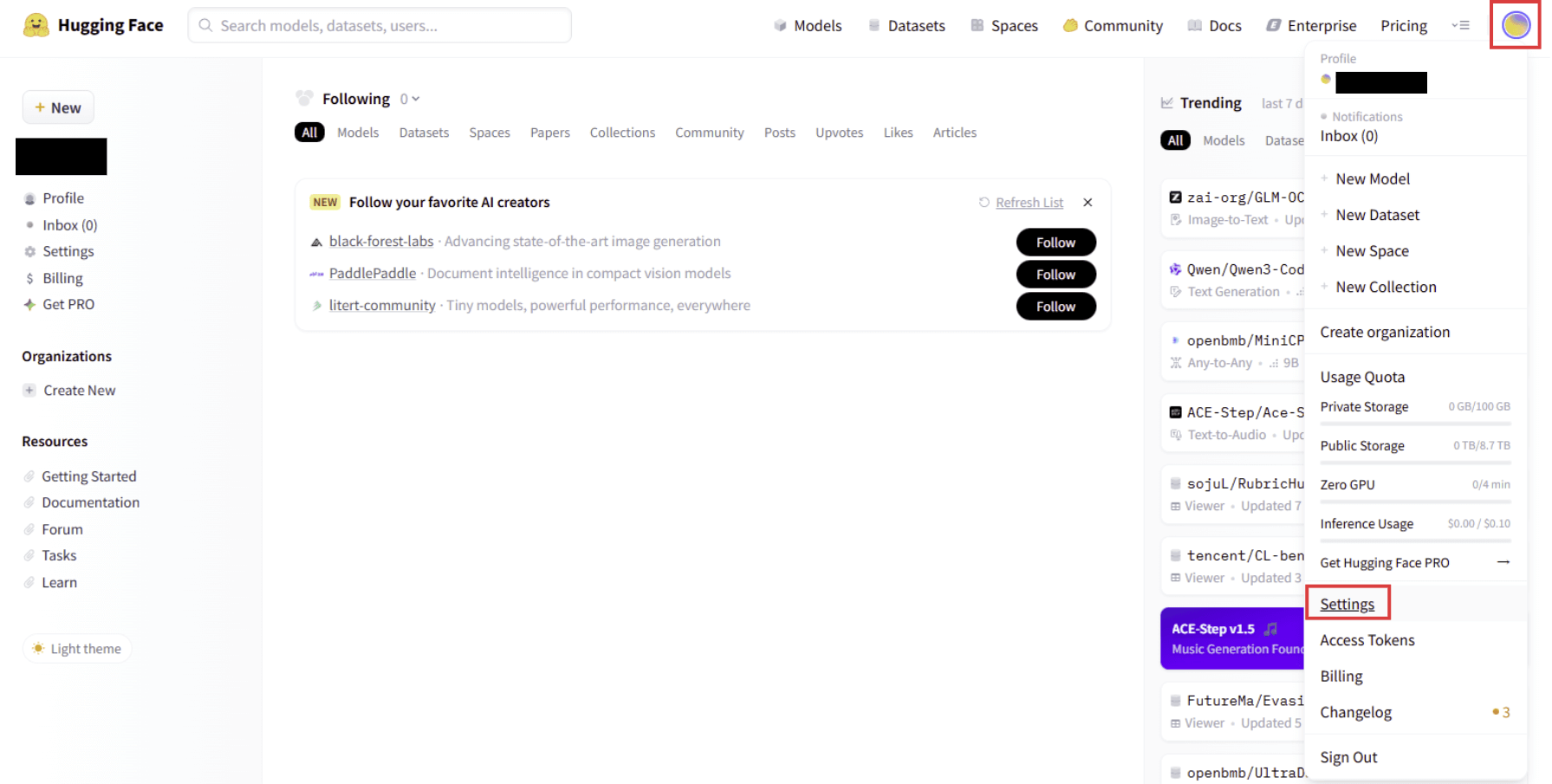

画面右上のプロフィールアイコンをクリックし、「Settings」をクリックします。

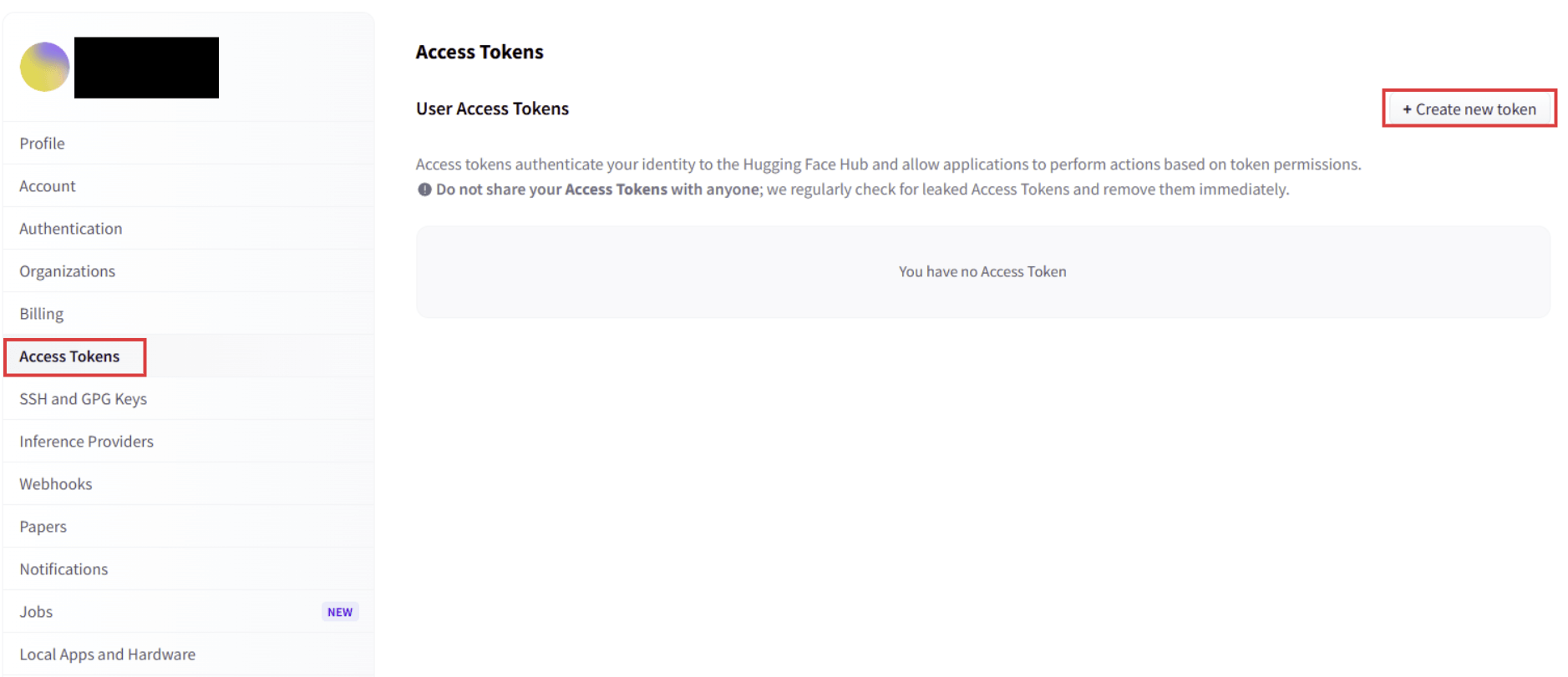

左側のサイドメニューで「Access Tokens」をクリックし、「+ Create new token」ボタンをクリックしてください。

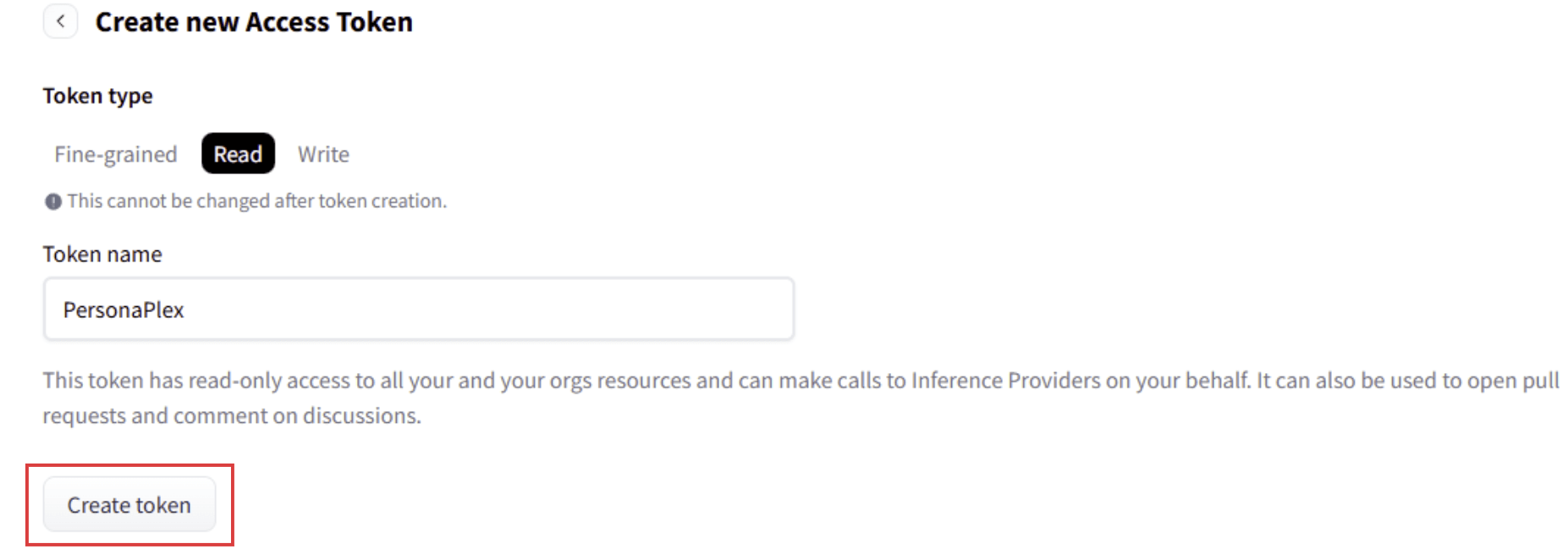

以下の設定を指定したら、「Create token」ボタンをクリックします。

- Token Type:Read

- Token name:任意の名前

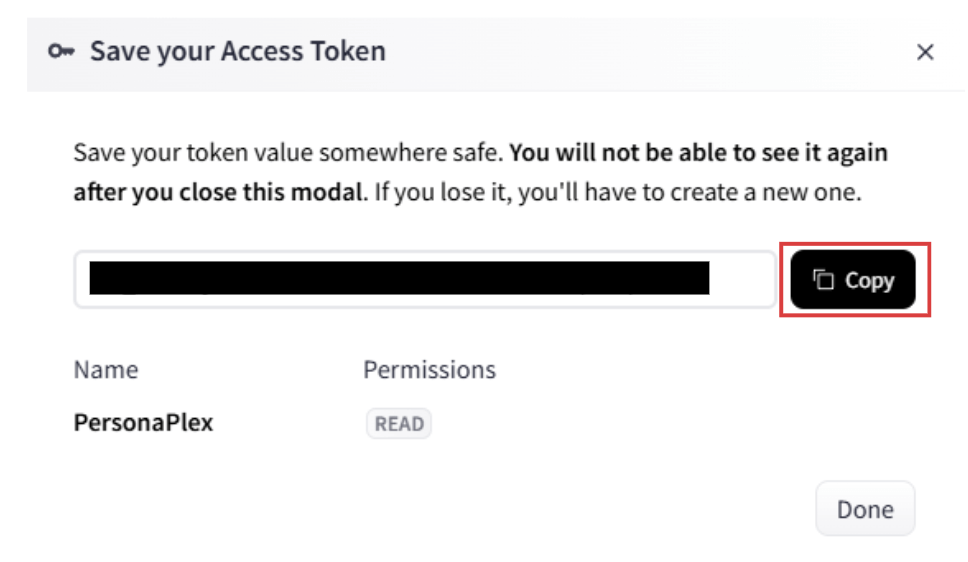

作成されたアクセストークンは後の手順で利用するため、コピーしてメモ帳などに控えておきます。

以上の手順により、Hugging Faceで公開されているPersonaPlex-7Bを利用する準備ができました。

ローカル環境にPersonaPlex-7Bをデプロイ|リアルタイム対話用Web UIの実行

NVIDIAの公式リポジトリでは、ローカル環境上でPersonaPlex-7Bを動かしてリアルタイム対話を行うWeb UIが提供されています。UbuntuでWeb UIをデプロイする手順は以下の通りです。

以下のコマンドを実行し、必要なパッケージ(音声コーデックの開発パッケージ)をインストールします。sudo apt install libopus-dev

以下のコマンドを実行し、GitHubに公開されているリポジトリをローカルに取得します。

git clone https://github.com/NVIDIA/personaplex.git

cd personaplex

以下のコマンドを実行し、取得したリポジトリに含まれるパッケージをインストールしてください。

pip install moshi/.

以下のコマンドを実行し、「事前準備|Gated modelに同意・Hugging Faceトークン取得」のSTEP6で控えたアクセストークンを環境変数として設定します。

export HF_TOKEN=<アクセストークン>

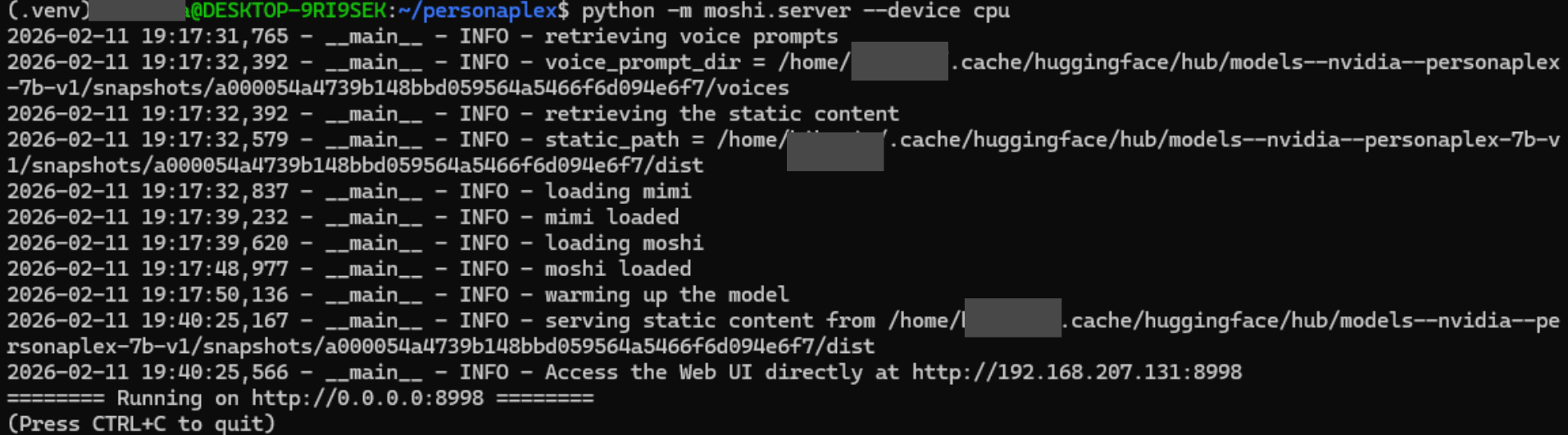

以下のコマンドを実行し、Web UIを起動します。今回はCPUを使って実行するため、--device cpuオプションを指定しています。

python -m moshi.server --host 0.0.0.0 --port 8998 --device cpu

Web UIが起動すると、画像の通りアクセス用のURLが表示されます。

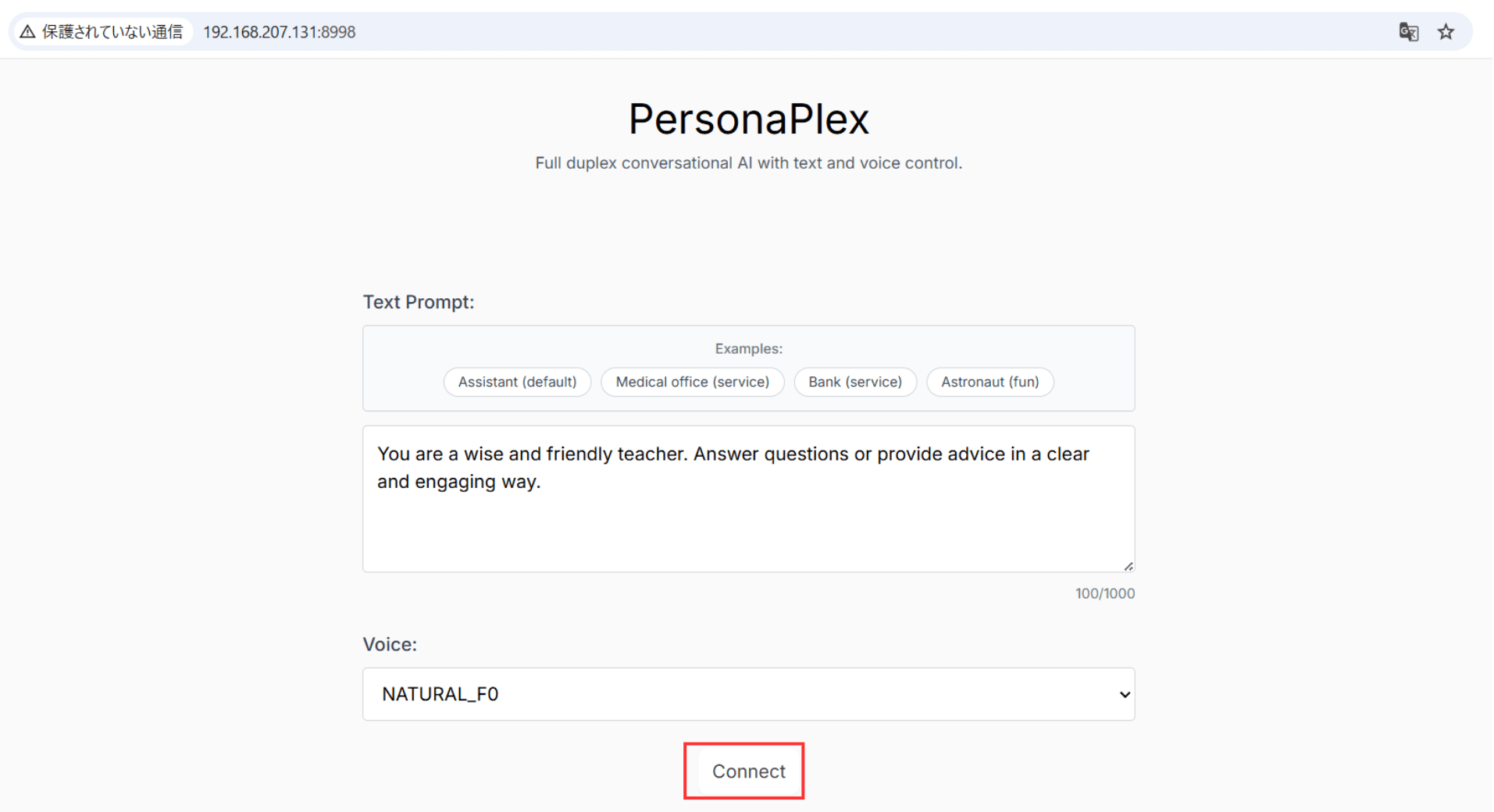

Webブラウザにhttps://192.168.207.131:8998/を入力し、Web UIにアクセスします。以下の画面でText Prompt、Voice Promptを入力し、「Connect」ボタンをクリックすると会話を開始できます。

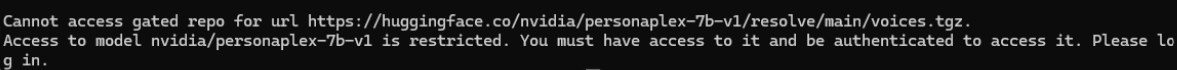

PersonaPlex-7B利用でつまずくポイント|Gated modelに同意・トークン設定の確認

PersonaPlex-7Bはオープンなモデルとして、任意の環境で実行できます。しかし利用のためにはHugging Face上で利用規約に同意し、発行したアクセストークンを指定してモデルをダウンロードする必要があります。

この操作手順に不備があったり、指定するアクセストークンが誤っている場合、画像の通り You must have access to it and be authenticated to access it.というメッセージが表示されます。

モデルのアクセスに関するエラーが発生した場合には、「事前準備|Gated modelに同意・Hugging Faceトークン取得」の手順を参考に、不備がないか確認してください。

PersonaPlex-7Bの料金

PersonaPlex-7Bは「NVIDIA Open Model License」に基づいて公開されています。NVIDIA Open Model Licenseの内容を踏まえて、PersonaPlex-7Bの利用時に発生する料金や実行環境の選択肢について解説します。

PersonaPlex-7Bのコスト構造

PersonaPlex-7Bのような公開モデルを利用する場合、「モデルの利用料金」と「モデルの実行環境の利用料金」について考慮する必要があります。

PersonaPlex-7Bは以下の通り、自由な利用が意図されたモデルであり商用利用も可能です。

NVIDIA models released under this Agreement are intended to be used permissively and enable the further development of AI technologies. Subject to the terms of this Agreement, NVIDIA confirms that:

- Models are commercially usable.

- You are free to create and distribute Derivative Models.

- NVIDIA does not claim ownership to any outputs generated using the Models or Derivative Models.

【参考訳】

本契約に基づきリリースされるNVIDIAモデルは、AI技術のさらなる発展を可能にするために、自由に利用されることが意図されています。本契約の条項に従い、NVIDIAは以下の事項を保証します。出典:NVIDIA Open Model License Agreement

- モデルは商用利用可能です。

- お客様は派生モデルを自由に作成および配布できます。

- NVIDIAは、モデルまたは派生モデルを使用して生成された出力に対する所有権を主張しません。

PersonaPlex-7Bの場合は「モデルの利用料金」が発生しないため、基本的に「モデルの実行環境の利用料金」がそのままPersonaPlex-7Bの利用料金となります。

- モデルの利用 … 利用料金は発生しない

- モデルの実行環境 … 計算リソースの使用に料金が発生するケースがある

【比較表】PersonaPlex-7Bの実行環境と料金(ローカル/Hugging Face Spaces/AWS)

本記事ではCPUを使ってPersonaPlex-7Bを実行する手順を解説しましたが、リアルタイム性を重視する場合、GPUの使用が現実的です。

GPUの実行環境と料金について、ローカル、Hugging Face Spacesの有料プラン、AWSについて整理しました。

| 実行環境 | GPU提供機能(代表例) | ハードウェアスペック | 料金 | 備考 |

|---|---|---|---|---|

| ローカル | GPU搭載のノートPC,サーバ等 | 任意のスペックを用意可能 | 初期コストのみ (価格はハードウェアに依存) | 既にGPU実行環境がある場合、追加のコスト不要 |

| Hugging Face Spaces | Nvidia T4 – small | 4vCPU メモリ15GB ディスク50GB | $0.40/時間 (62円/時間) | GPU環境でPythonアプリケーションをデプロイ可能 |

| Amazon EC2 (仮想マシンサービス) | g4dn.xlarge | 4vCPU メモリ16GB ディスク125GB | $0.71/時間 (110円/時間) ※OS:Linux、リージョン:東京の場合 | g4dn.xlargeは機械学習モデルデプロイ用のNVIDIA GPUを搭載した仮想マシン 価格はリージョン・OS・購入方法(スポット/オンデマンド/事前購入)により変動 |

既存のリソースがある場合は、追加コストが不要なローカルでの実行が有力な候補となります。利用可能なリソースがない場合、初期コスト不要ですぐに利用できるHugging Face SpacesやAmazon EC2のようなクラウドサービスの利用を検討するとよいでしょう。

PersonaPlex-7Bの日本語対応状況

PersonaPlex-7Bのモデルカードでは、想定されるユースケースやトレーニングデータセットに関する情報が示されています。これらの公式情報をもとに、日本語を使用する際に必要な検証項目について整理します。

音声入出力でサポートされる言語と注意点

PersonaPlex-7Bで利用が想定されていることが明示されている言語は英語のみです。本記事の執筆時点では、英語以外の言語の対応状況は明確にされていません。

Use Case:

出典:nvidia/personaplex-7b-v1

Wherever NVIDIA’s speech-to-speech conversational models are used, PersonaPlex can generate English speech response for English speech input.

【参考訳】

ユースケース:

NVIDIA の音声対音声会話モデルが使用されている場合はどこでも、PersonaPlex は英語の音声入力に対して英語の音声応答を生成できます。

また学習用データセットも英語であることが示されています。したがって日本語などの他言語を使用する場合、言語に合わせたチューニングや性能検証を利用者が行う必要があります。

日本語を検証する場合のチェックリスト

PersonaPlex-7Bは日本語に特化したモデルではないため、日本語を利用する場合は事前検証が必要です。

PersonaPlex-7Bの特徴が日本語でも十分に機能するか確認するための検証観点として、以下のような項目が考えられます。

| 項目 | 概要 |

|---|---|

| 音声理解(入力) | 割り込み発話時に日本語が認識されるか 日本語音声がリアルタイムで処理されるか |

| 音声生成(出力) | 日本語発話がストリーミング生成されるか 応答のスピードが実用範囲か |

| Text Promptの挙動 | Text Promptで指定した人格が日本語応答でも維持されるか |

| 会話の品質 | 相槌や同時発話が日本語会話として自然か |

上記以外にも想定している利用用途に合わせて、日本語による検証を行うようにしましょう。

まとめ

PersonaPlex-7Bは従来の直列型音声AIとは異なり、「聞きながら話す」自然な対話を実現できます。割り込みや同時発話、相槌(バックチャンネル)といった会話特有の挙動を再現できる点が最大の特徴です。

ただし、明示的に利用が想定されている言語は英語のみのため、日本語を利用する際には事前検証が不可欠です。

リアルタイム対話が可能なWeb UIが提供されており、本記事ではそのデプロイ方法について具体的な手順を紹介していますので、まずはローカル環境で動かしてみてはいかがでしょうか。