OpenAIは小型モデルの新製品として「GPT-5.4 mini」と「GPT-5.4 nano」を公開しました。いずれも高速性と効率性を重視したモデルで、大量の処理を伴うワークロード向けに設計されたといいます。なかでもGPT-5.4 miniは、従来のGPT-5 miniに比べてコーディング、推論、マルチモーダル理解、ツール利用の各面で性能を高めつつ、2倍以上高速に動作すると説明されています。

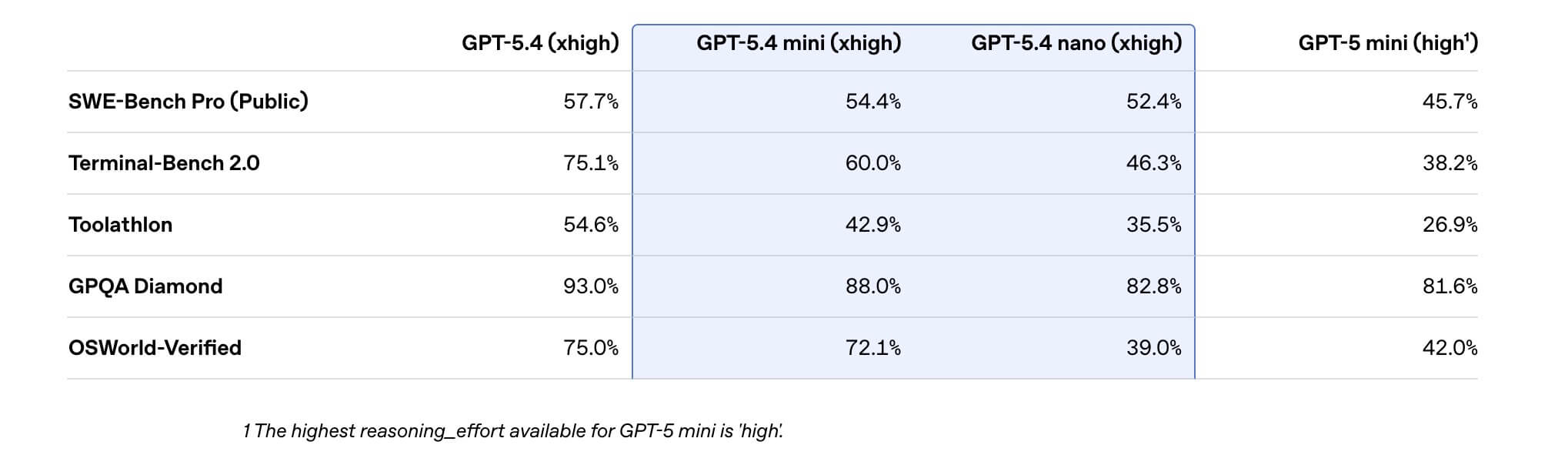

性能面では、GPT-5.4 miniは上位モデルのGPT-5.4に迫る結果も示しました。公開された評価では、SWE-Bench Pro(Public)で54.4%、OSWorld-Verifiedで72.1%を記録し、GPT-5.4の57.7%、75.0%に近い水準となっています。GPT-5 miniの45.7%、42.0%と比べると改善幅は大きく、特にコーディングやコンピュータ利用の分野で強化が目立ちます。

OpenAIは、こうしたモデルが応答速度の影響を受けやすい用途に向くと説明しました。具体例として、反応の速さが求められるコーディング支援、補助作業を並列で進めるサブエージェント、画面のスクリーンショットを読み取って操作するコンピュータ利用システム、画像を扱うマルチモーダルアプリケーションを挙げています。Codexでは、大型のGPT-5.4が計画や最終判断を担い、GPT-5.4 miniがコードベース検索や大きなファイルの確認といった補助タスクを処理する使い方も想定されています。

同時に発表されたGPT-5.4 nanoは、GPT-5.4系で最小かつ最も低価格なモデルです。分類、データ抽出、ランキング、比較的単純な補助的コーディング作業など、速度とコストを優先する用途に適するとしています。API価格は、GPT-5.4 miniが入力100万トークンあたり0.75ドル、出力100万トークンあたり4.50ドル、GPT-5.4 nanoが入力100万トークンあたり0.20ドル、出力100万トークンあたり1.25ドルです。

提供先は、GPT-5.4 miniがChatGPT、Codex、APIで、本日から利用可能です。一方、GPT-5.4 nanoはAPI限定で提供されます。OpenAIは今回の発表で、高性能モデル一辺倒ではなく、速度とコストのバランスを取った小型モデルの重要性を改めて打ち出した形です。