GPT-5.3-Codex-Sparkとは、高速な応答を特徴とするOpenAIの新たなコーディング向けAIモデルです。

実運用でのコーディングタスクでも利用可能な性能を維持しながら、毎秒1,000トークン以上という高速な生成が可能であり、UIや機能の調整など短く反復するタスクにおいてその能力を発揮します。

この記事では、GPT-5.3-Codex-Sparkの特徴や使い方、料金について解説します。

GPT-5.3-Codex-Sparkとは?概要と特徴

GPT-5.3-Codex-Sparkは、2026年2月12日にOpenAIが公開したコーディング特化型AIモデルです。

GPT-5.3-Codexの軽量版として設計された、OpenAI初のリアルタイムコーディング向けモデルであり、短い反復作業を高速でこなすことを目的としています。

まずはGPT-5.3-Codex-Sparkの特徴についてご紹介します。

リアルタイムコーディング向け高速モデルの位置づけ

GPT-5.3-Codex-Sparkは、既存のGPT-5.3-Codexを小型化し、推論速度と応答性を高めたリアルタイムコーディング向けの高速モデルとして位置づけられています。なお、現在は研究プレビュー版として公開されています。

AIとの対話における遅延を最小限に抑えることで、開発者が思考を止めることなくコードを記述できる環境を実現しました。

従来のモデルが時間をかけて複雑なタスクをこなす熟練エンジニアの役割を担うのに対し、本モデルは瞬時のフィードバックを提供するペアプログラマーのような存在です。

長時間の推論よりも、人間と同等の即時レスポンスが求められるインタラクティブな開発体験を実現するためのモデルとなっています。

スピードと性能|得意とする作業

本モデルの最大の特徴は、毎秒1,000トークン以上という驚異的なテキスト生成速度にあります。

実運用のコーディングタスクに対応できる高い性能を維持しながら、毎秒1000トークン以上の生成速度を実現します。

出典:GPT‑5.3‑Codex‑Spark のご紹介

これは従来の標準的なGPT-5.3-Codexと比較して約15倍のスピードであり、ユーザーがプロンプトを打ち終えるとほぼ同時に結果が返ってくるような感覚です。

得意とする作業は、単一ファイル内の関数書き換えや変数名の変更といった小規模で独立したタスクです。UIの細部をその場で直したい、ロジックをすぐ確かめたい、などといった場面でストレスなく使うことができます。

また、フロントエンド開発におけるCSSの微調整やReactコンポーネントの修正など、即座にプレビューを確認しながら反復作業を行うUIやUXの改善ループにも適しています。

開発者はコンパイル待ちのようなストレスを感じることなく、短いサイクルでアイデアを形にすることが可能です。

速度と精度のトレードオフ

圧倒的なスピードを実現した一方で、推論の深さや複雑な問題解決能力においては通常版のGPT-5.3-Codexに譲る部分があります。

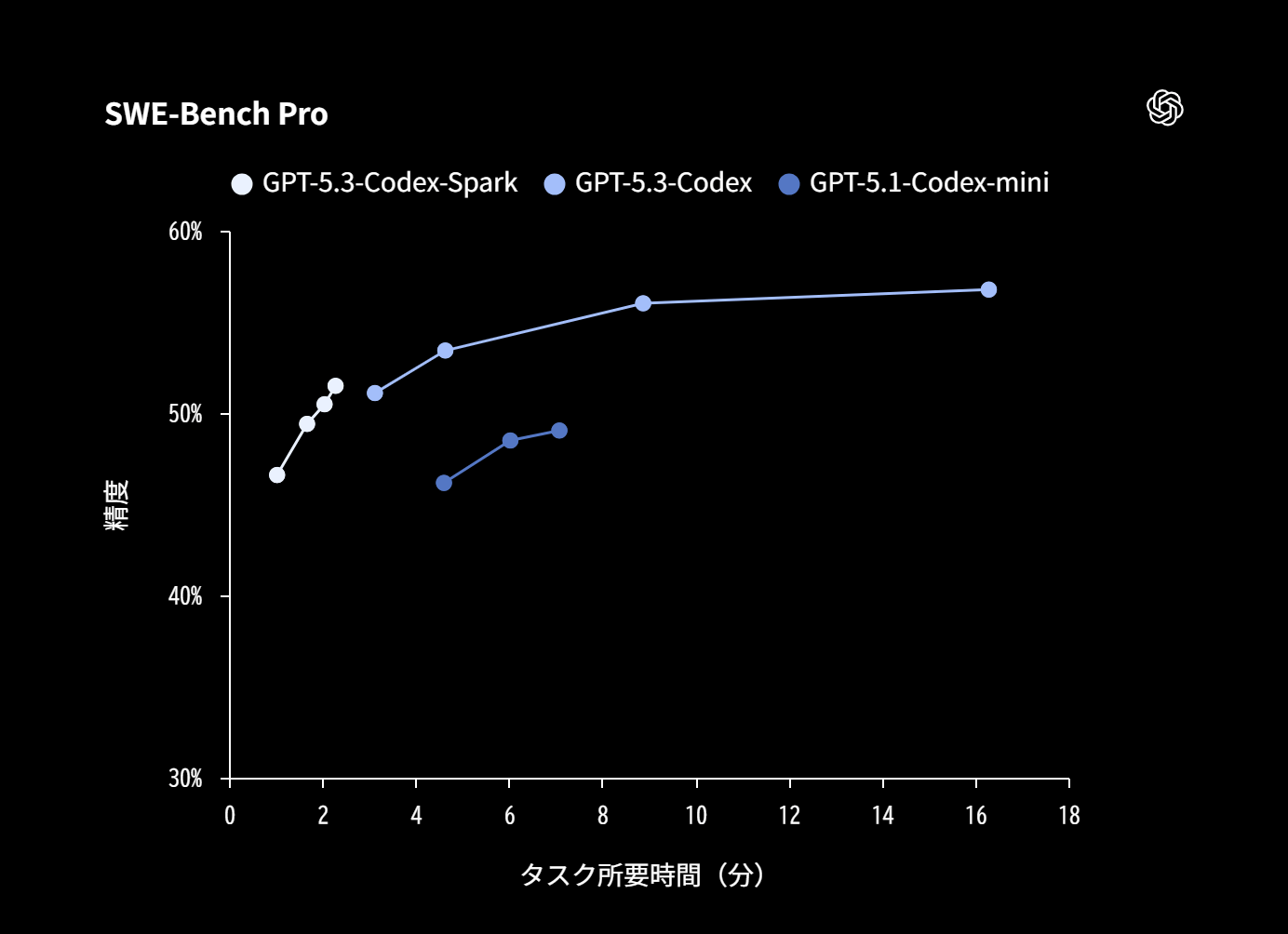

ソフトウェアエンジニアリングのベンチマークであるSWE-Bench Proにおいて、タスクの所要時間は通常版が16.29分であるのに対し、本モデルは2.29分と高速であることが分かります。一方でスコアは精度が56.8%であるのに対し、本モデルは約51.5%にとどまっています。

そのため、複数ファイルにまたがるアーキテクチャの設計や、状態を保持したまま複数ステップを踏む高度なデバッグ作業には向いていません。

数ステップ以上の長期的な計画を立てさせると途中で文脈を見失う傾向があるため、利用シーンに応じた適切なモデル選択が必要です。また、コンテキストウィンドウは128Kであり、大規模なコードベース全体を分析するには不十分な場合があります。

具体的には、素早いプロトタイピングやUI調整には本モデルを使い、難易度の高いロジック構築や全体設計には通常版を使うという使い分けが推奨されます。

制約と安全面

Codex-Sparkは専用の低遅延ハードウェア上で動作するため、使用量は標準のレート制限とは別枠で管理されており、研究プレビュー期間中は需要が高い場合にアクセスが制限されたり、順番待ちが発生したりすることがあります。

研究プレビュー期間中は、Codex-Spark 専用のレート制限が適用されます。また、その利用分は通常のレート制限には含まれません。需要が高い場合には、ユーザー間の安定性を確保するため、アクセスが制限されたり、一時的に順番待ちが発生したりすることがあります。

出典:GPT‑5.3‑Codex‑Spark のご紹介

また、リリース時点ではコンテキストウィンドウが128Kに設定されており、入力はテキストのみを受け付けます。

提供開始時点では、Codex-Spark は128k のコンテキストウィンドウに対応し、テキスト入力のみに対応します。

出典:GPT‑5.3‑Codex‑Spark のご紹介

安全面については、メインモデルと同じ安全トレーニングを受けており、サイバーセキュリティや生物兵器に関する高い能力のしきい値に達する可能性はないとOpenAIは評価しています。

Codex-Spark は、標準のデプロイメントプロセスに基づいて評価されています。このプロセスには、サイバー分野を含む各種能力に関するベースライン評価が含まれます。その結果、サイバーセキュリティおよびバイオ分野における高い能力について、当社の Preparedness Framework が定めるしきい値に達する現実的な可能性はないと判断しました。

出典:GPT‑5.3‑Codex‑Spark のご紹介

提供形態

2026年2月現在、提供対象はChatGPTのProプランユーザーに限定されており、Codex アプリ、CLI、VS Code拡張機能の最新バージョンから利用できます。

この驚異的なスピードを支えるインフラの背景には、AIチップ開発企業であるCerebras Systemsとの強力なパートナーシップが存在します。

本モデルは、大規模なオンチップメモリと高い並列処理性能を持つ巨大プロセッサWafer Scale Engine 3上で稼働しています。

この超低遅延に最適化された専用ハードウェアと軽量化されたモデルの組み合わせが、開発者のフローを途切れさせない推論体験を生み出しています。

GPT-5.3-Codex-Sparkの使い方

続いて、GPT-5.3-Codex-Sparkの使い方について解説します。

使い方の全体像|短い反復を回す前提の進め方

Codex-Sparkを使いこなすうえで最も重要なのは、「一度に多くを任せない」という意識です。

Codex-Sparkは、ターゲットを絞った編集、ロジックの再構成、インターフェースの調整といった作業を即座にこなすことに最適化されており、結果をすぐ確認しながら次の修正を加えるリアルタイムの反復サイクルで力を発揮します。

まず大まかな方向性を決めてから、細部を一つずつモデルに渡して即座のフィードバックを得るという進め方が効率的です。

もし複雑な設計判断や大規模な変更が必要になった際は、通常のGPT-5.3-Codexに切り替えるのが得策です。

Codex CLIでの使い方

Codex CLIはターミナル上でCodexを活用するための公式ツールです。

Codex CLIでGPT-5.3-Codex-Sparkを使う方法は以下の通りです。

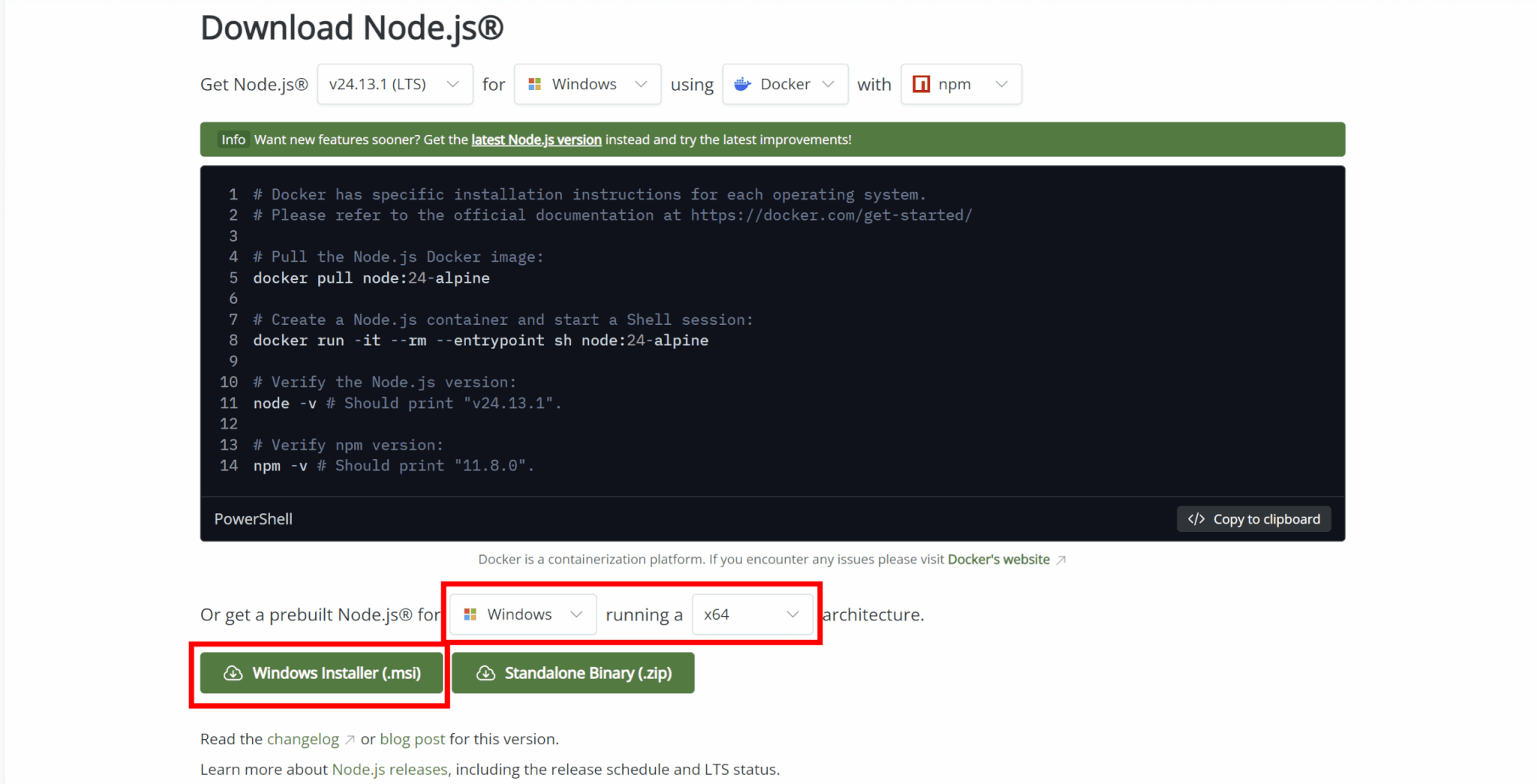

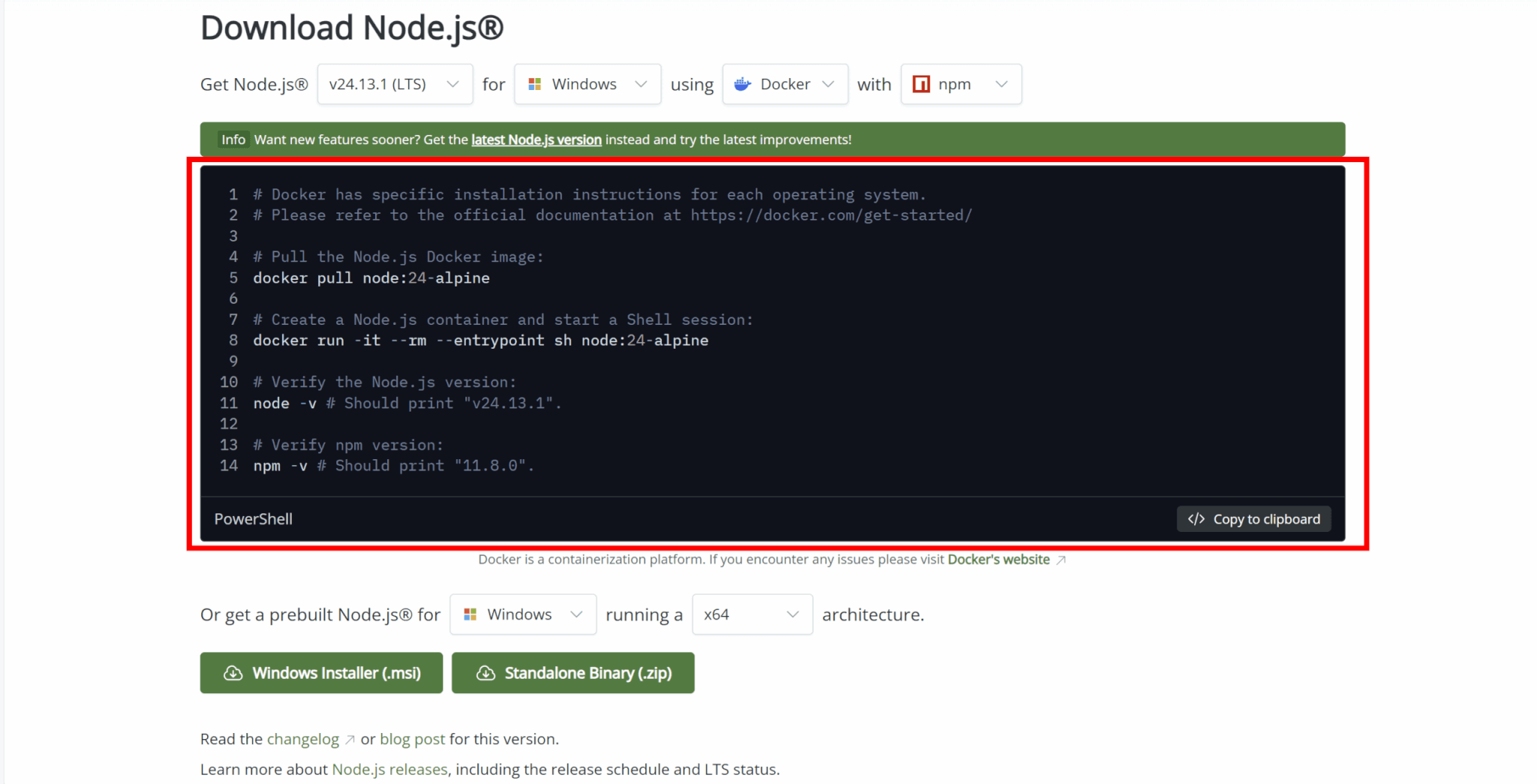

Codex CLIをインストールするには、Node.jsが必要です。

公式サイトにアクセスし、自分の環境に合ったインストーラをダウンロードしましょう。

ダウンロードしたインストーラを起動してインストールします。

なお、表示されているコマンドを実行することでもインストールが可能です。

以下のコマンドを実行して、バージョン情報が表示されればインストール完了です。

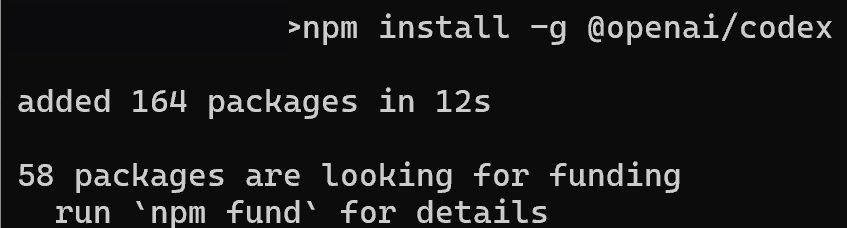

npm -vターミナル上で以下のコマンドを実行してCodex CLIをインストールしましょう。

npm i -g @openai/codex

なお、すでにインストールしている場合は、以下のコマンドでアップデートができます。

npm i -g @openai/codex@latestターミナル上でCodexを使いたいリポジトリに移動し、以下のコマンドを実行します。

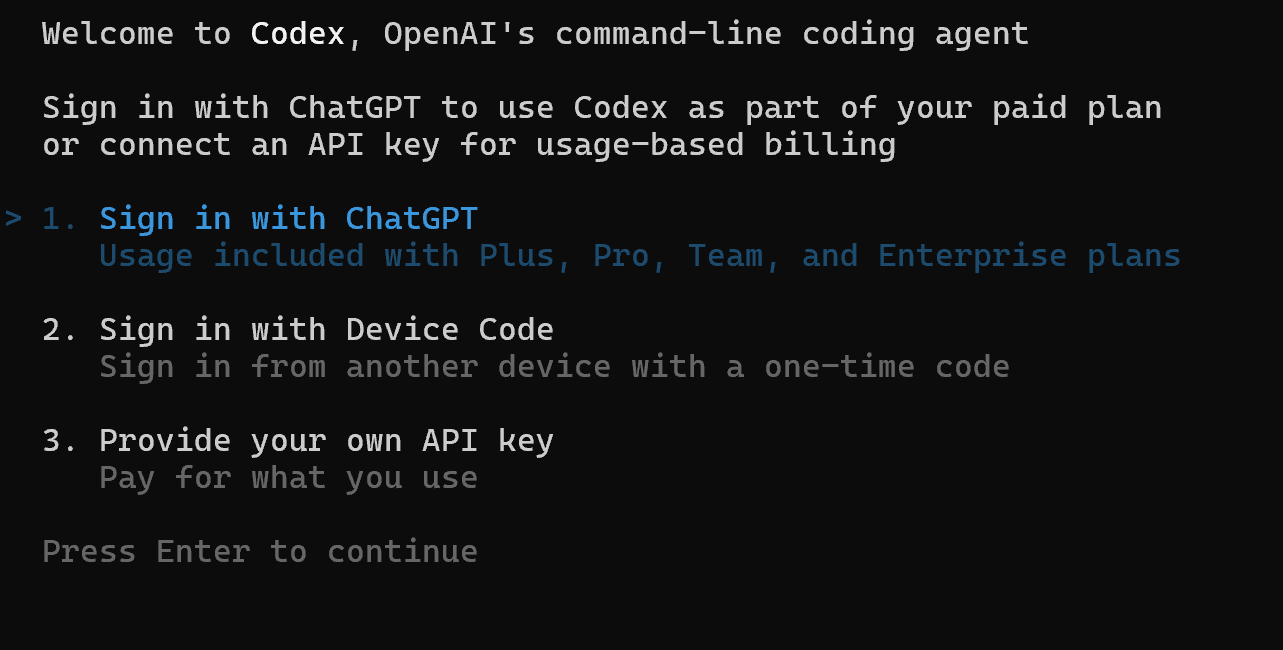

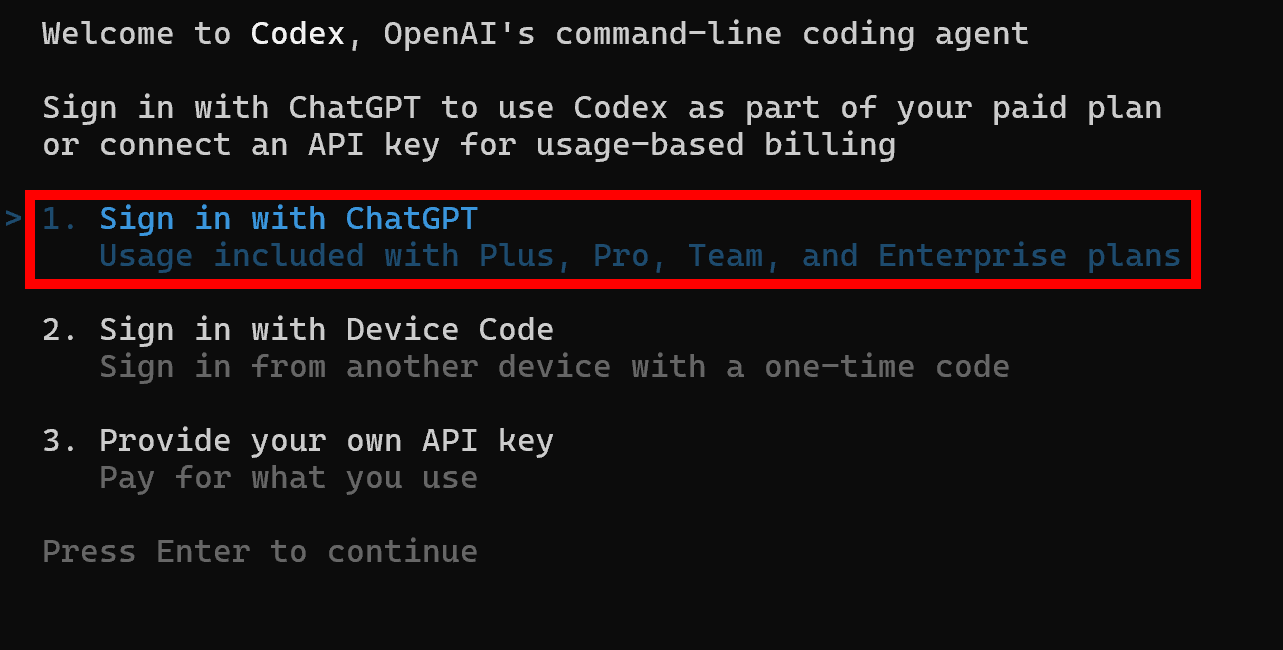

codexするとCodexが起動し、以下のように使用方法の選択肢が表示されます。

現状GPT-5.3-Codex-SparkはChatGPTのProプラン契約者のみに提供されており、APIでの提供はされていないため、「Sign in with ChatGPT」を選択します。

ブラウザが起動するので、アカウントにログインしましょう。

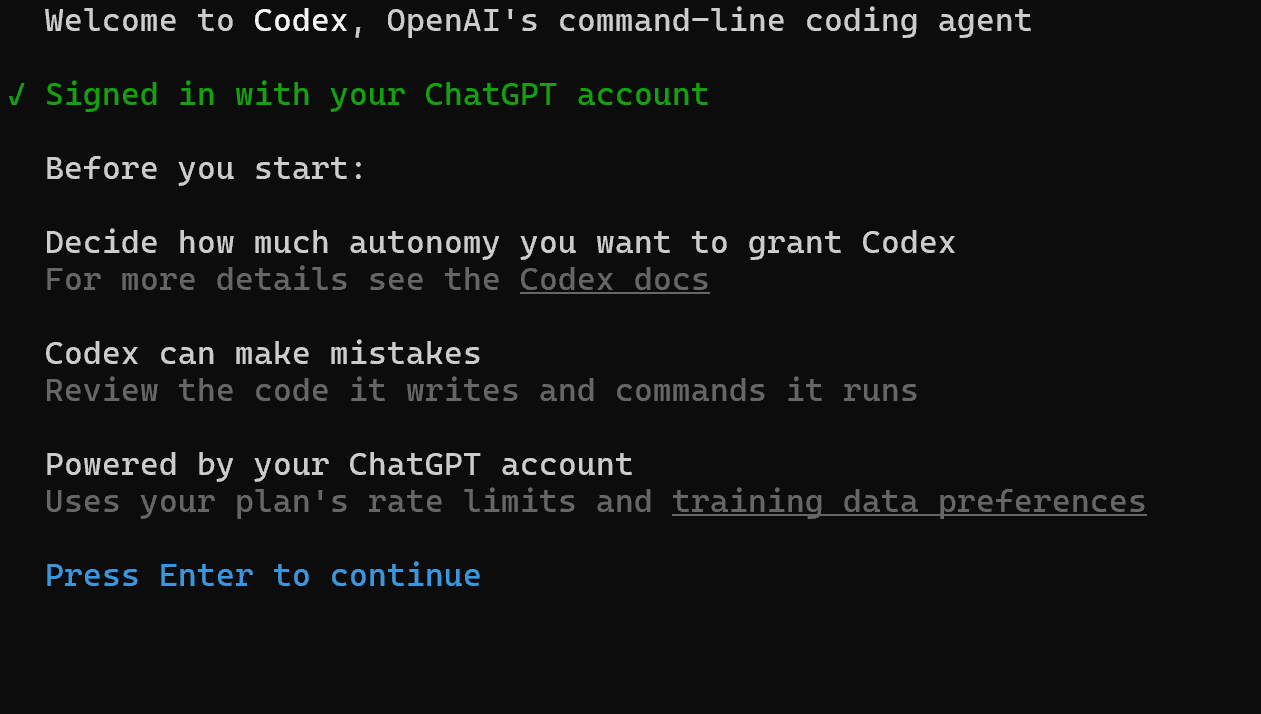

ログインが完了したら、ターミナルに戻ります。注意事項が表示されているので、確認してEnterキーを押しましょう。

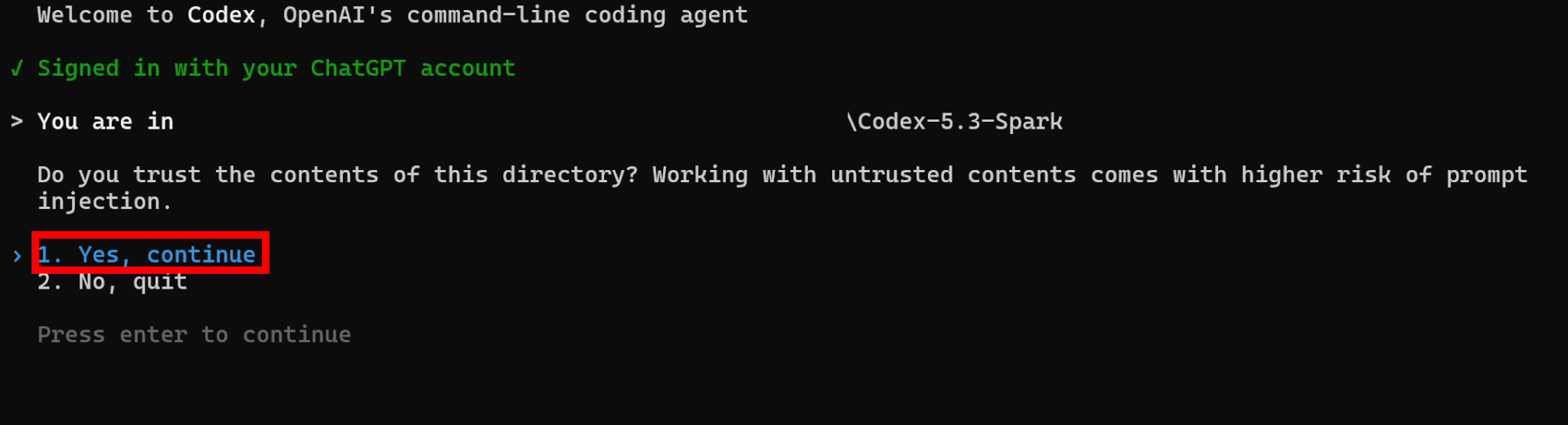

初めて使うリポジトリの場合、そのリポジトリを信頼するかどうか聞かれるため、「Yes, continue」を選択して続けます。

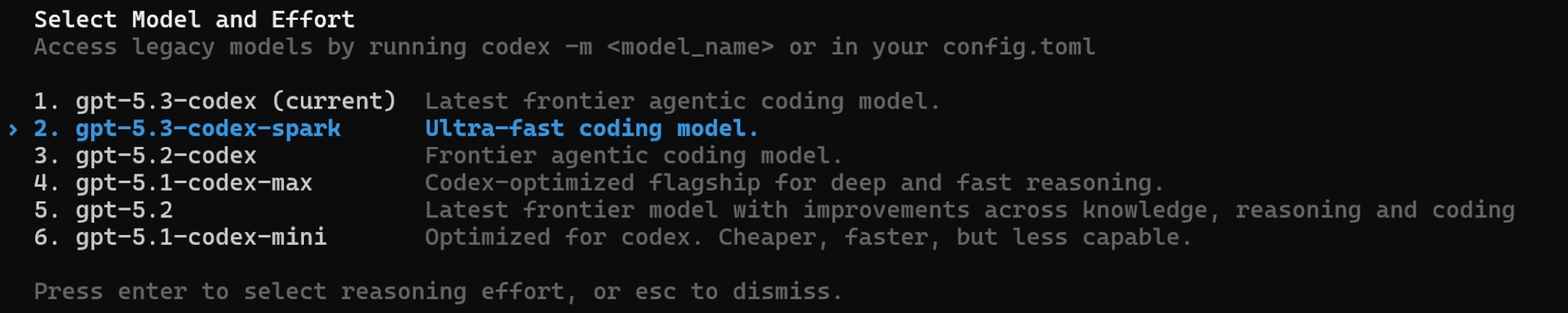

そして以下のコマンドを実行することでモデルを選択できます。

/model複数のモデルが表示されるので、「gpt-5.3-codex-spark」を選びましょう。

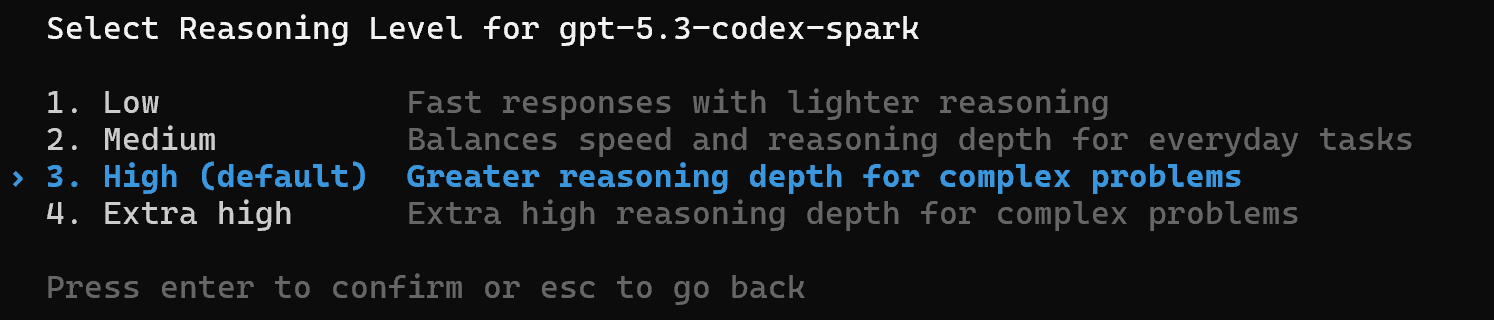

推論レベルも選びます。特にこだわりがなければ、デフォルトの「High」にしておきましょう。

なお、以下のコマンドを実行することで使用状況などを確認可能です。

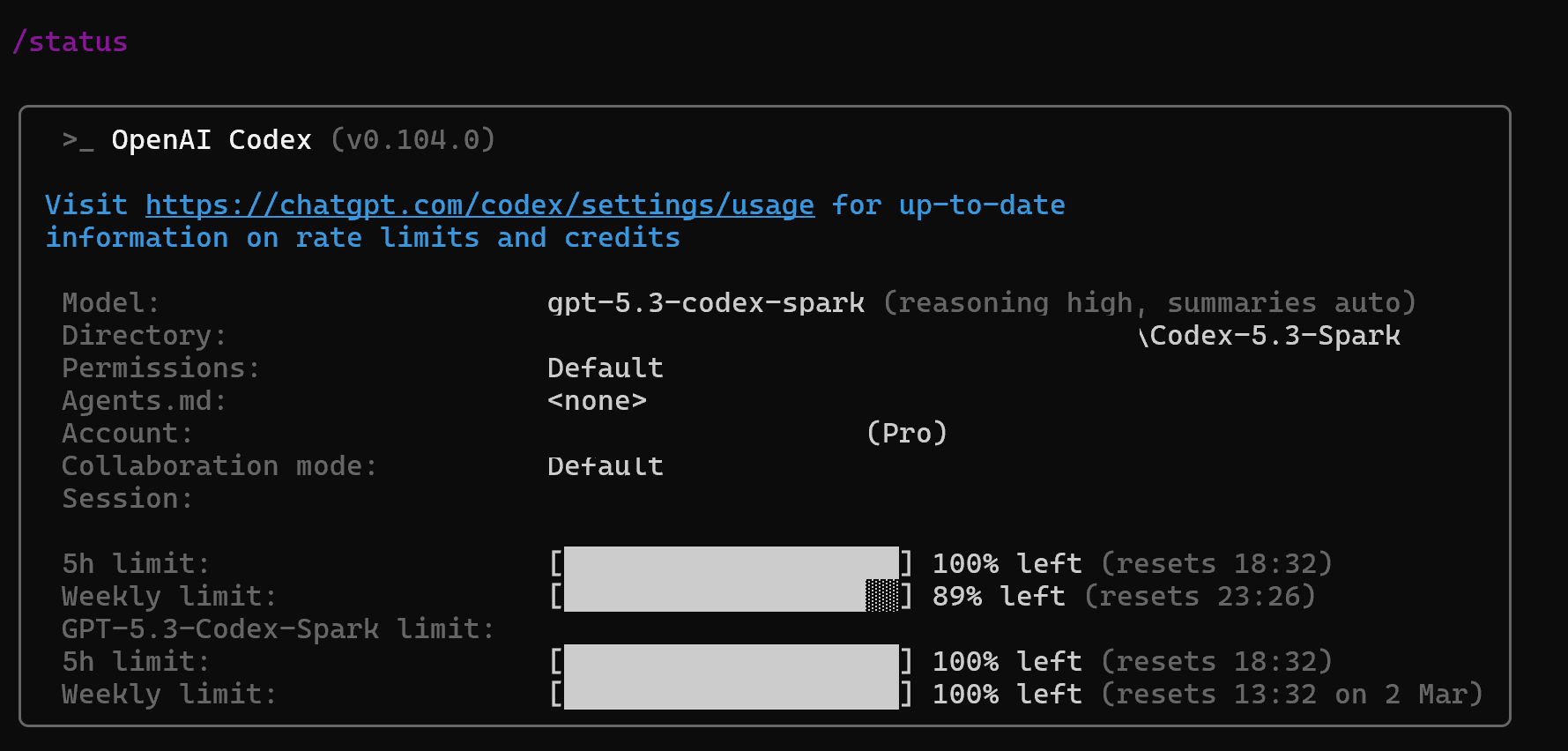

/status以下のようにGPT-5.3-Codex-Sparkは別枠で制限があることが分かります。

設定が完了したら、やってもらいたいタスクをプロンプトで送信しましょう。ここではスケジュール管理アプリを作成してもらいました。

プロンプト送信後、数十秒でタスクが完了し、以下のようなアプリが作成されました。

さらに、GPT-5.3-Codex-Sparkは微調整に強みを持ちます。完成したアプリやシステムについて、さらにプロンプトを送信することで、即座にコードの修正が行われるため、反復して調整が可能です。

「登録した予定をカレンダーで可視化できるようにしてください。」というプロンプトを送信すると、20秒程度で以下のようなカレンダーがアプリ上に追加されました。

このように細かい調整を短時間で反復することを繰り返すのが、GPT-5.3-Codex-Sparkを活用するうえで有効な使い方となります。

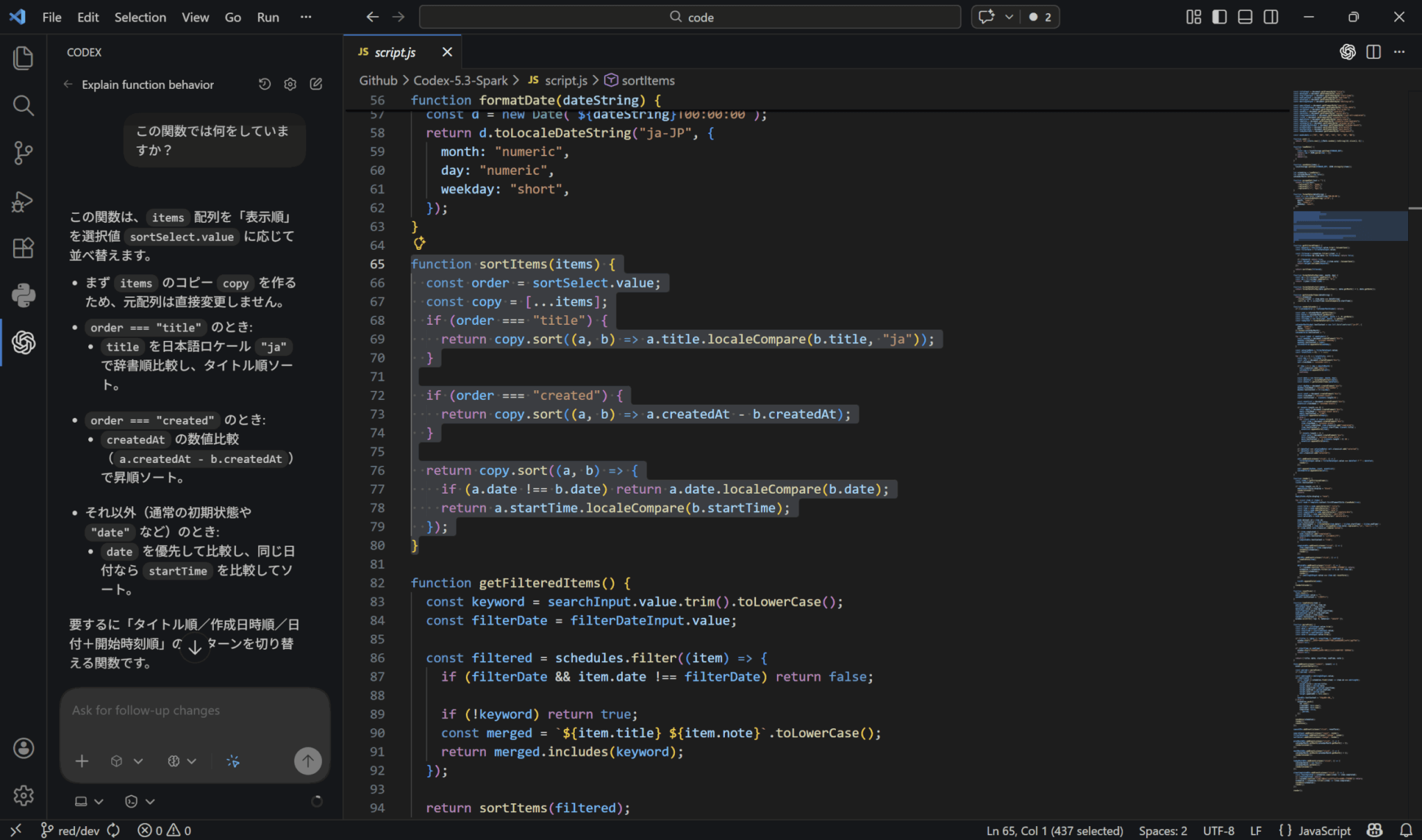

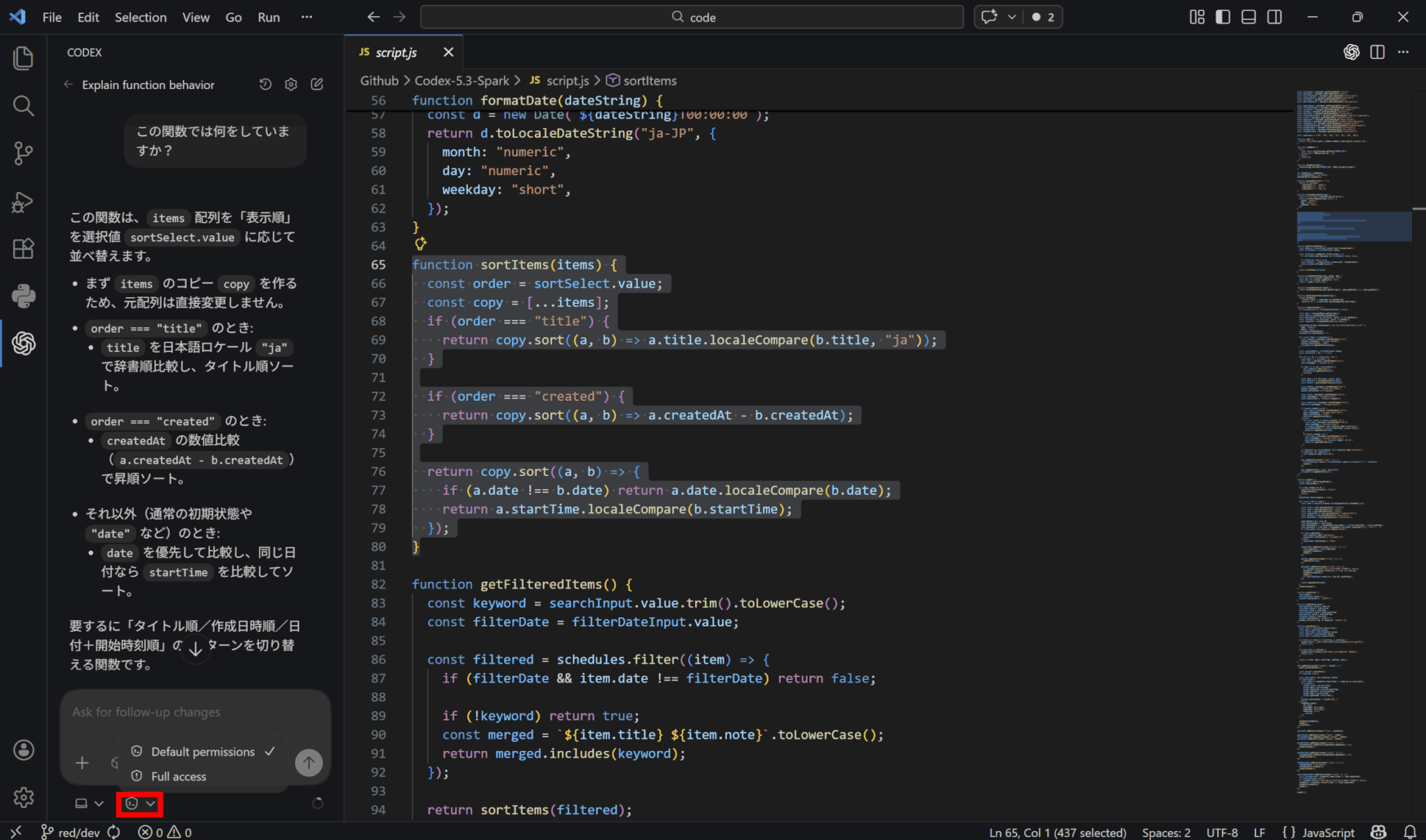

VS Codeの拡張機能での使い方

CodexはVS Codeの拡張機能としても提供されています。VS Codeでの使い方は以下の通りです。

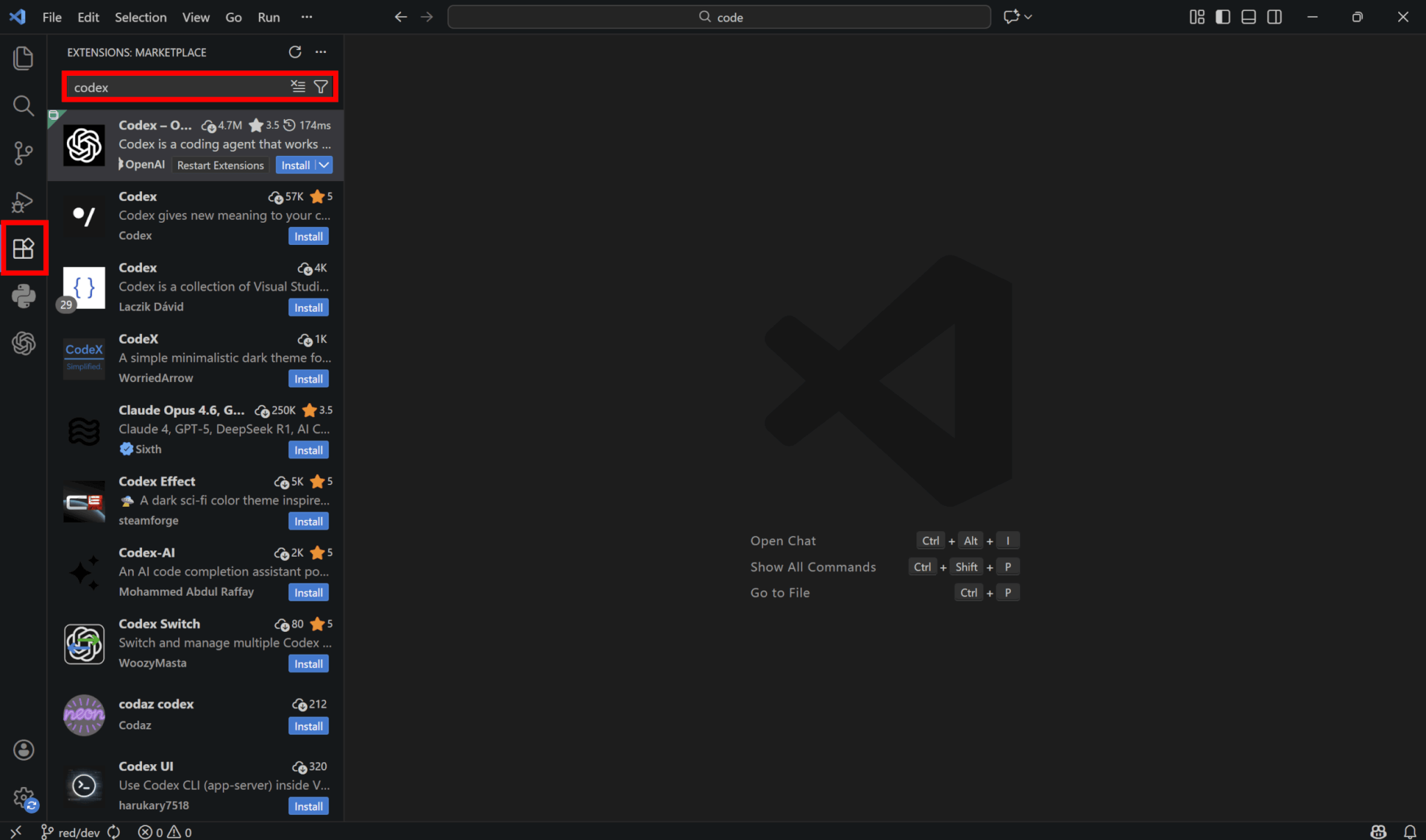

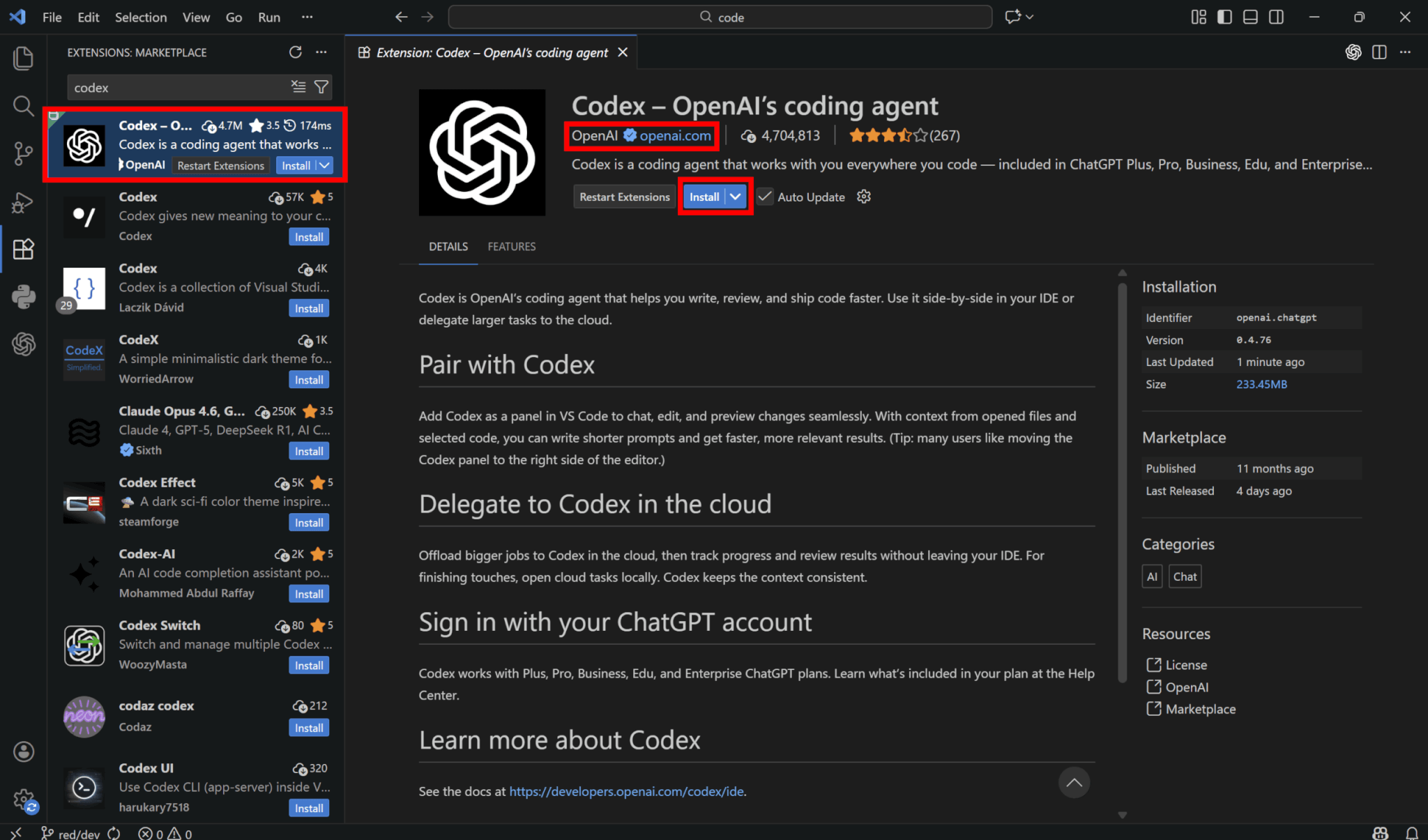

VS Codeの左側にある拡張機能タブを開き、検索バーに「codex」と入力しましょう。

OpenAIが提供している公式のCodexを選び、インストールしましょう。他にも「Codex」という名前の拡張機能はあるため、必ず提供元がOpenAIになっているかを確認してください。

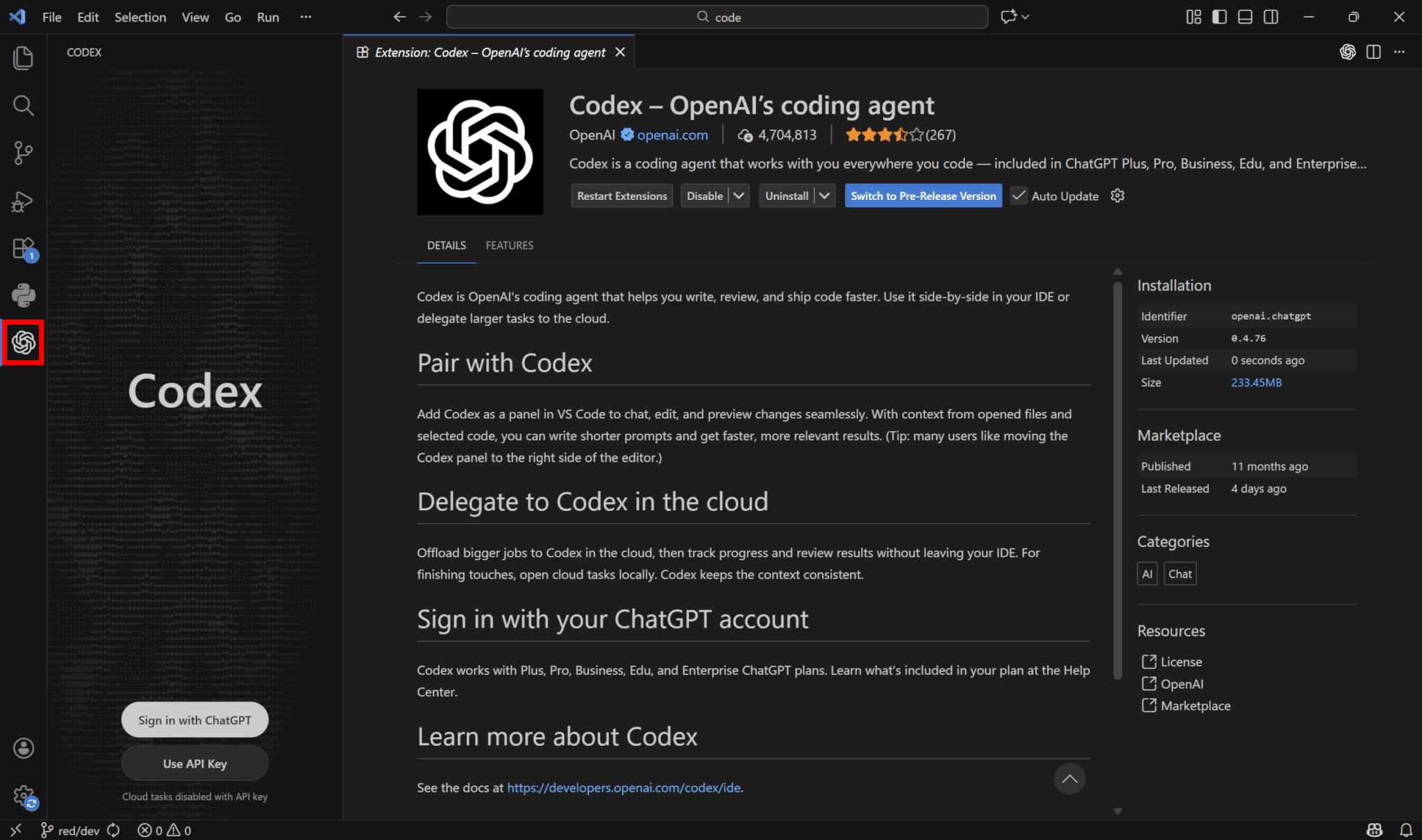

インストールが完了したら、左側にあるCodexのタブを選びましょう。

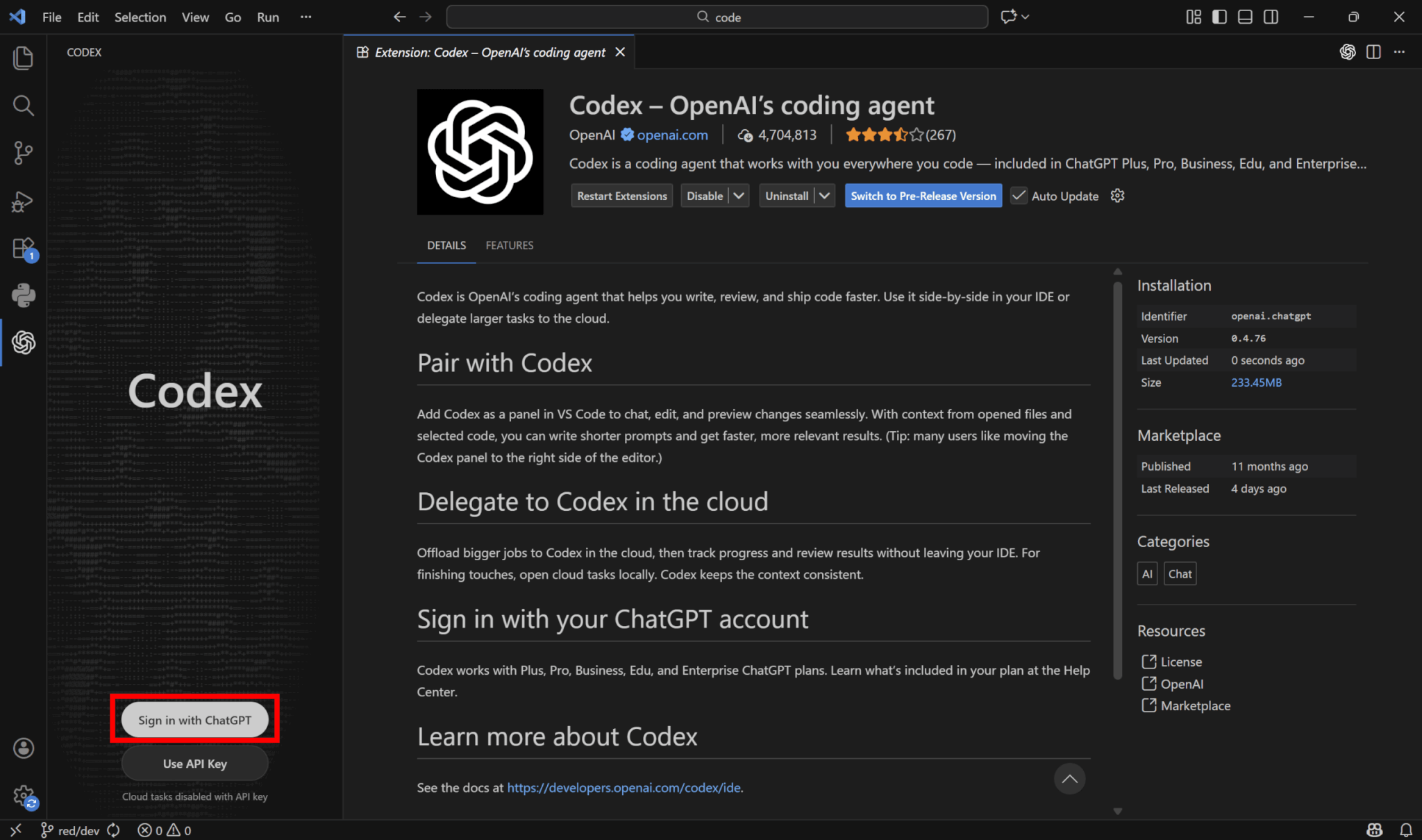

「Sign in with ChatGPT」をクリックし、ブラウザからChatGPTのアカウントでログインします。

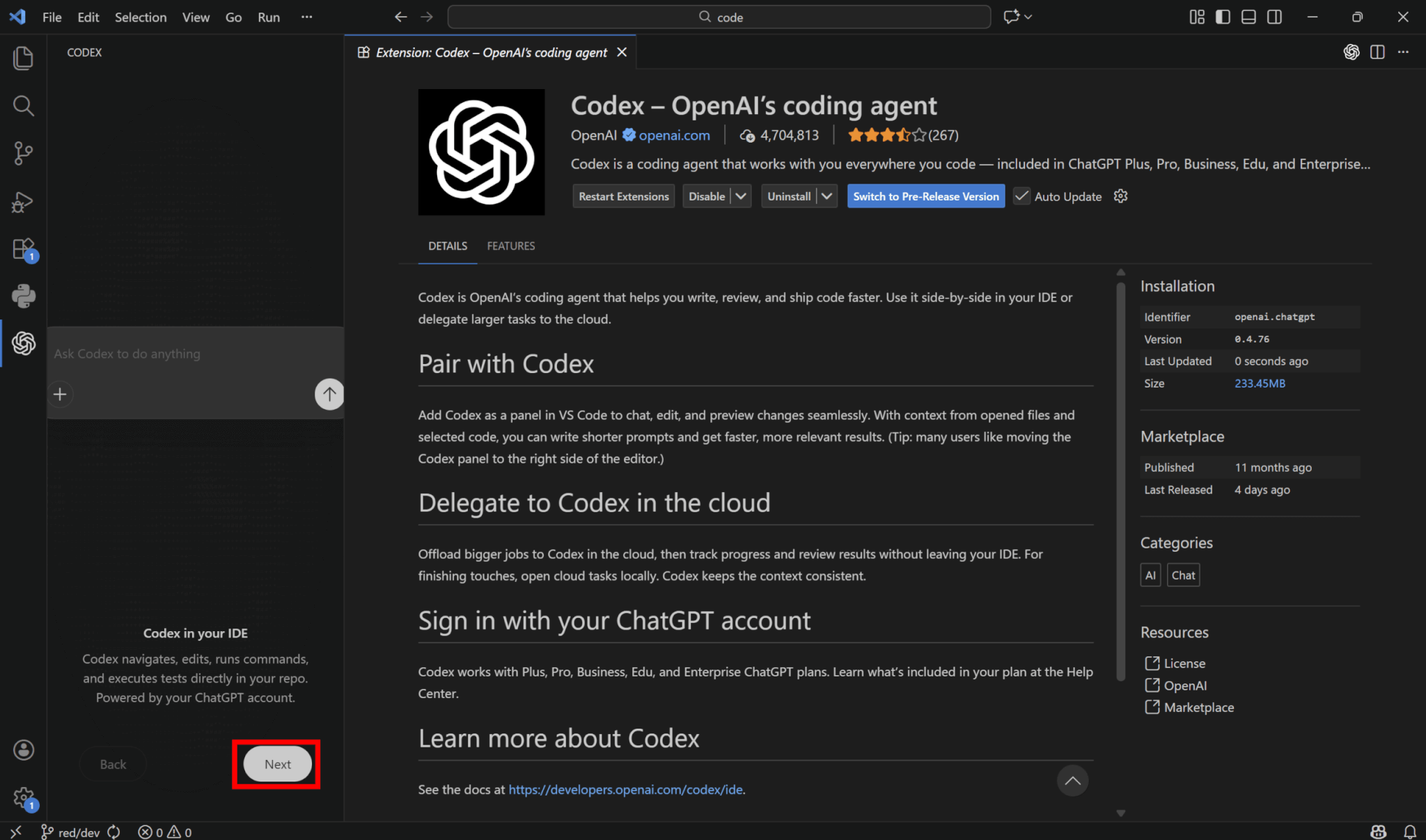

ログインが完了してVS Codeに戻ると、下に説明が表示されるので、「Next」をクリックします。

画面左にチャット画面が表示されれば、Codexが使用可能です。

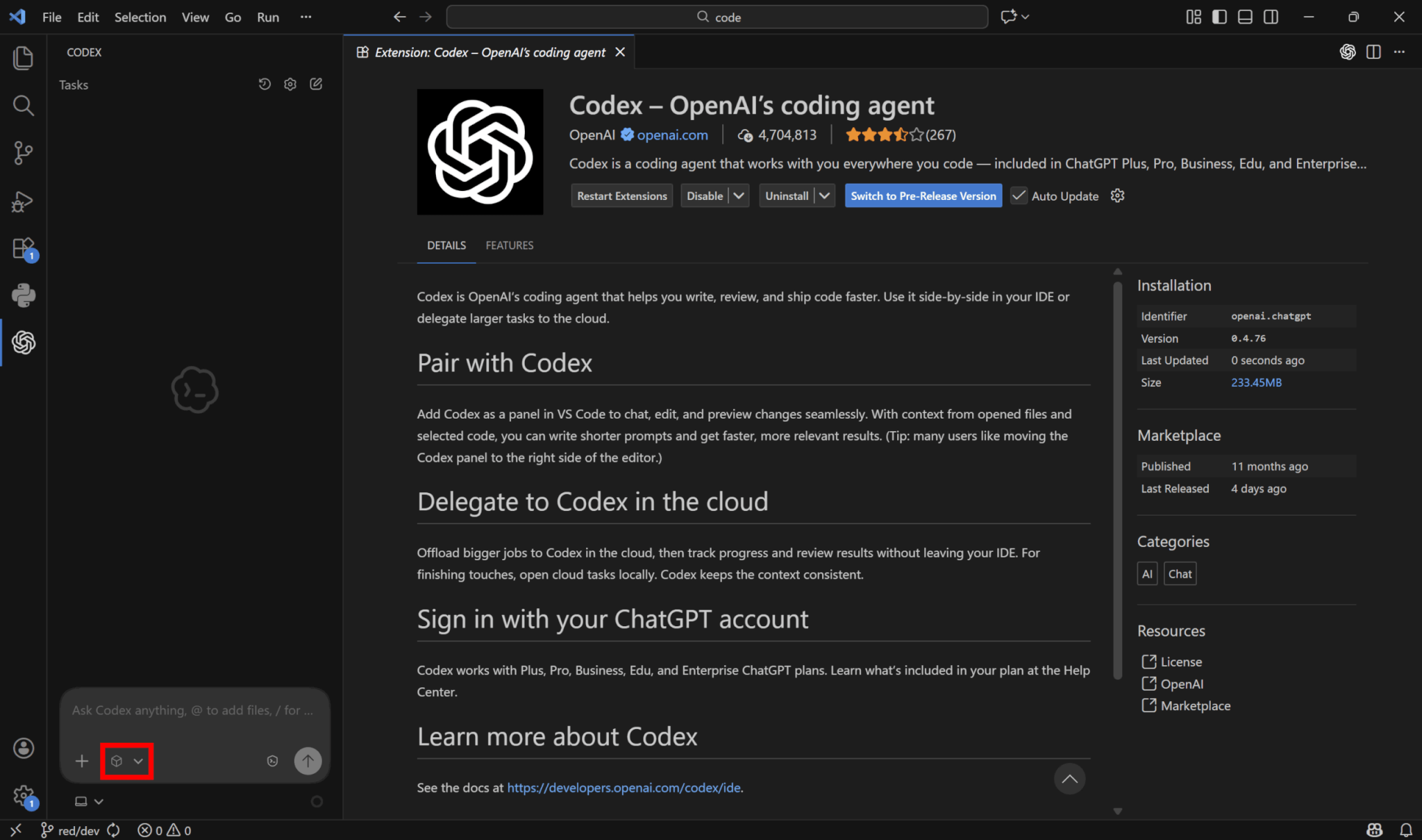

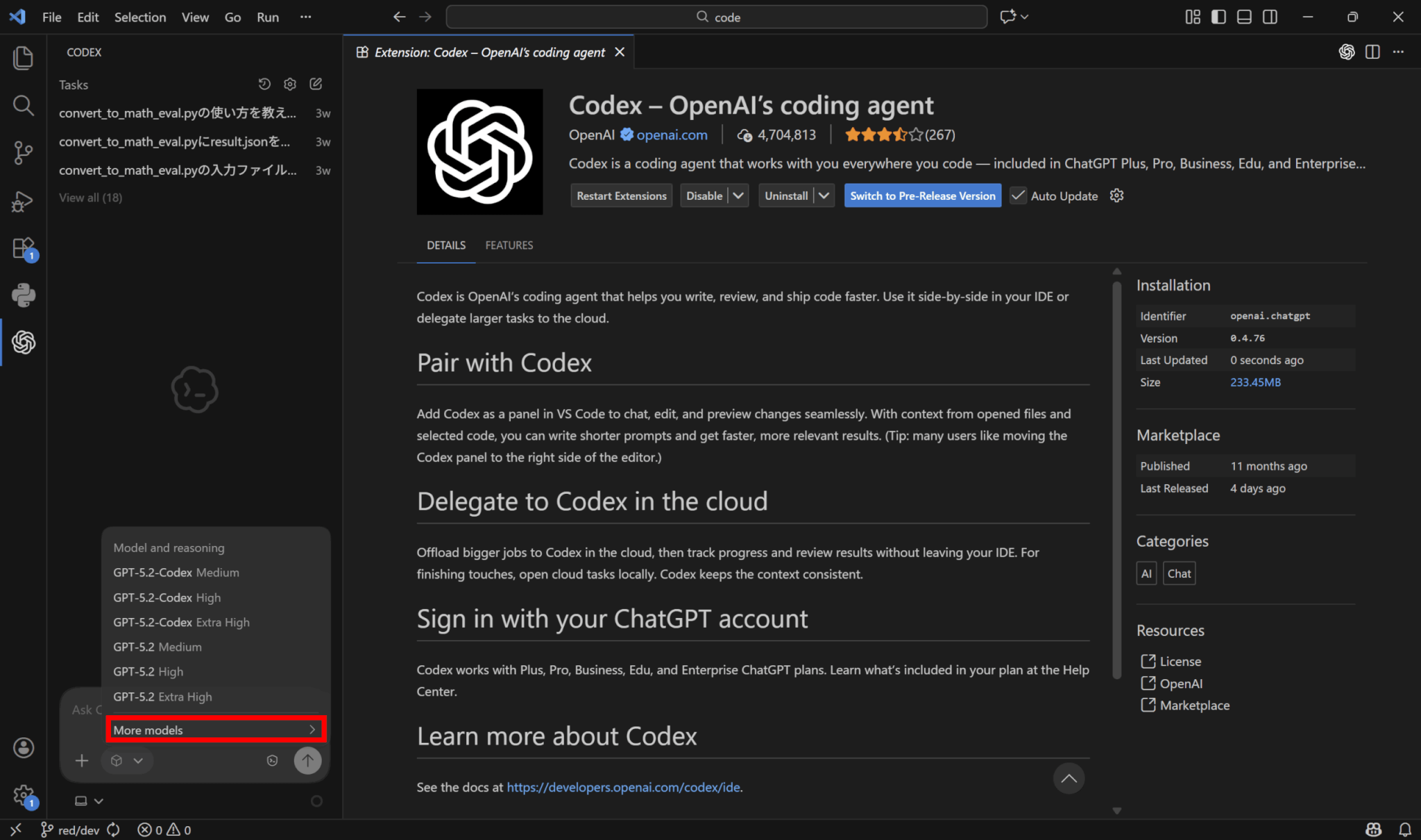

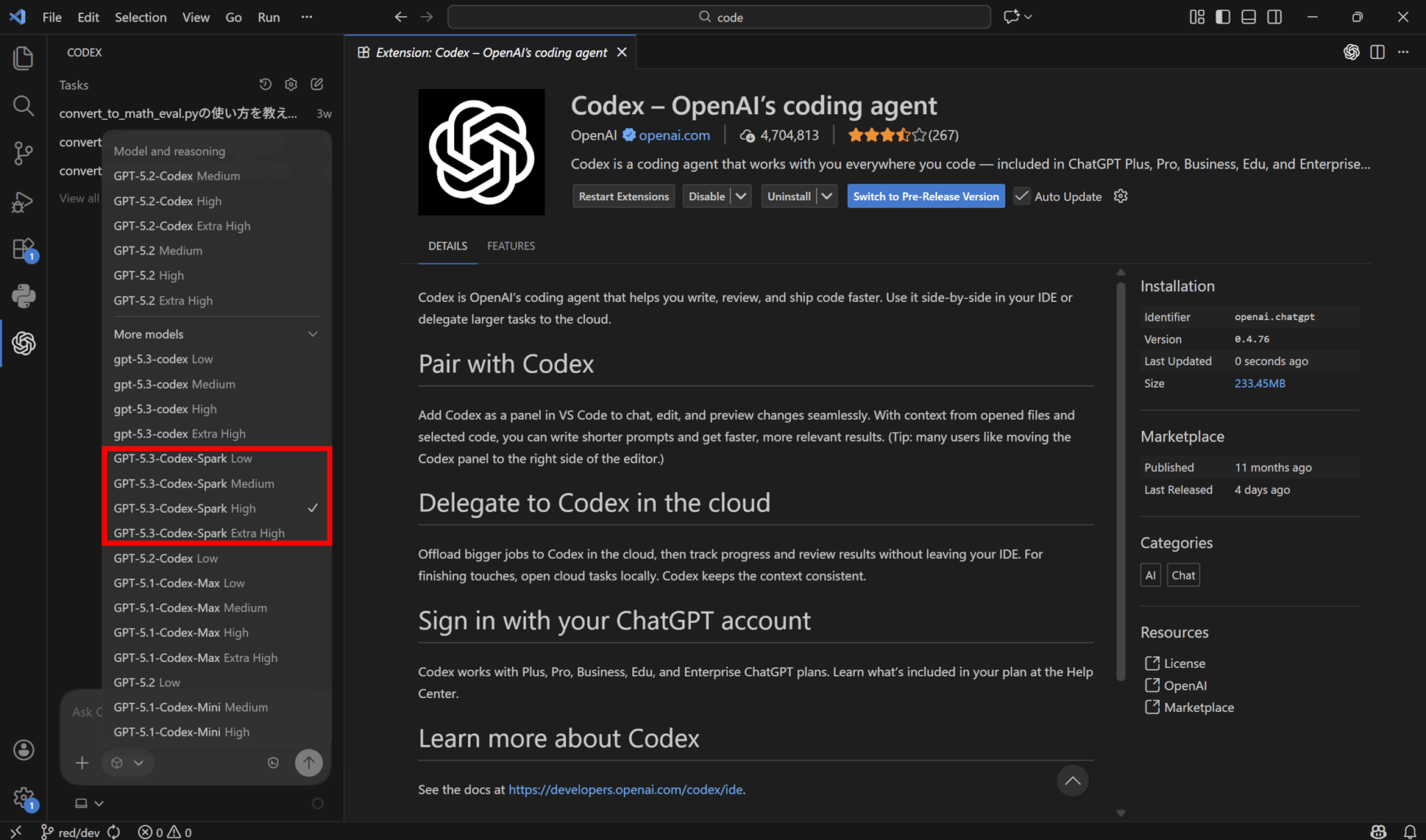

テキストウィンドウの左下にあるプルダウンをクリックすると、モデルを選択できます。

もしGPT-5.3-Codex-Sparkが表示されない場合は、「More models」をクリックしましょう。

使いたい推論レベルのGPT-5.3-Codex-Sparkを選択しましょう。

依頼したいタスクを入力し、プロンプトを送信します。このとき、コードを選択しておくことで、ファイル全体ではなく、選択箇所のみを対象としてタスクを実行できます。

このように局所的な編集指示を出すことでモデルの変更範囲が絞られ、意図しない箇所への影響を防ぎつつ、Sparkの速さを最大限に活かせます。

即座に変更案が返ってくるため、UIの細かな調整やリファクタリングの試行錯誤に最適なワークフローを実現できます。

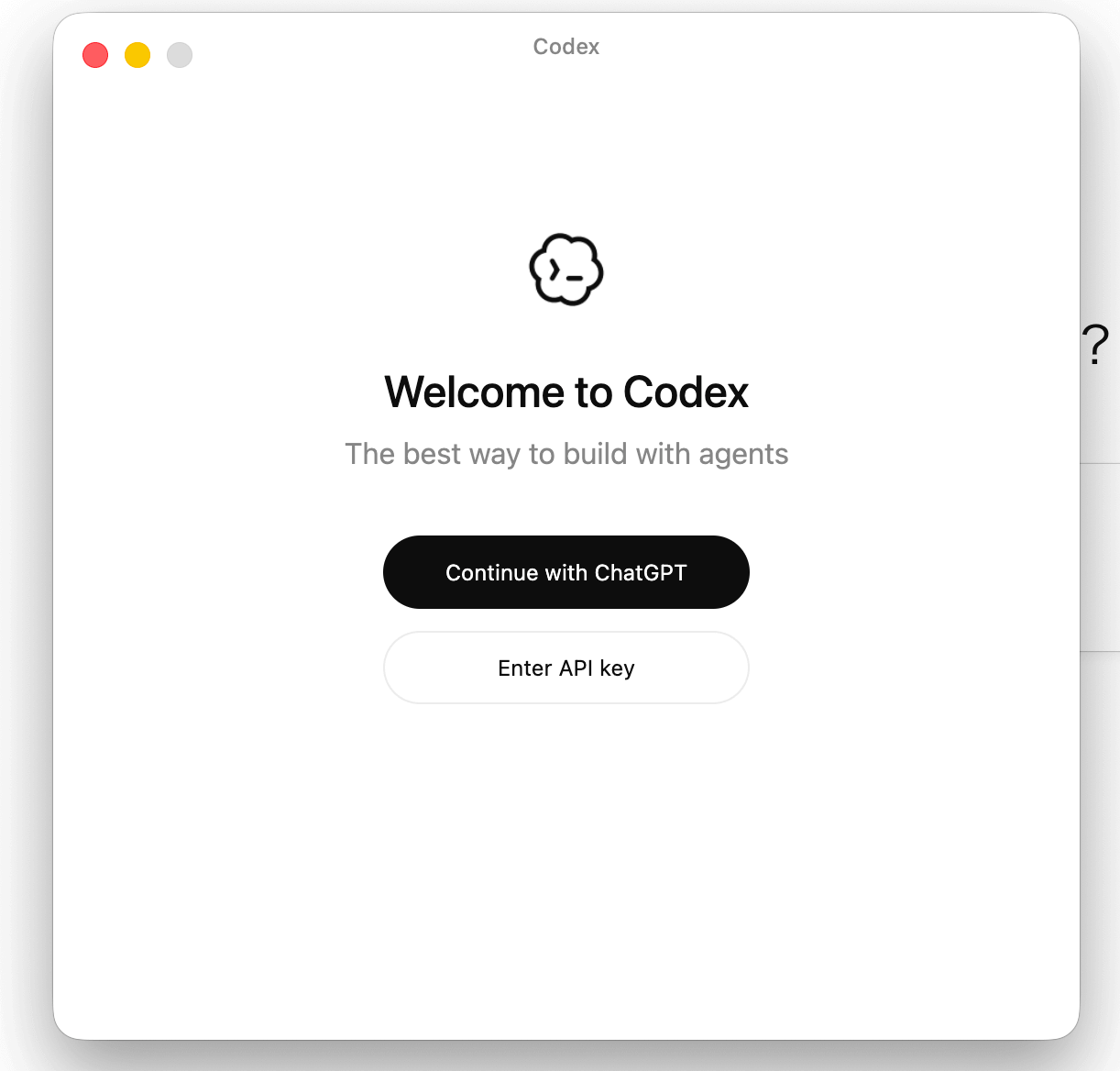

Codex アプリでの使い方

macOS向けに提供されているCodex アプリでも、GPT-5.3-Codex-Sparkを使うことができます。

Codex アプリでの使い方は以下の通りです。

インストールしたアプリを起動し、ChatGPTのアカウントでログインします。

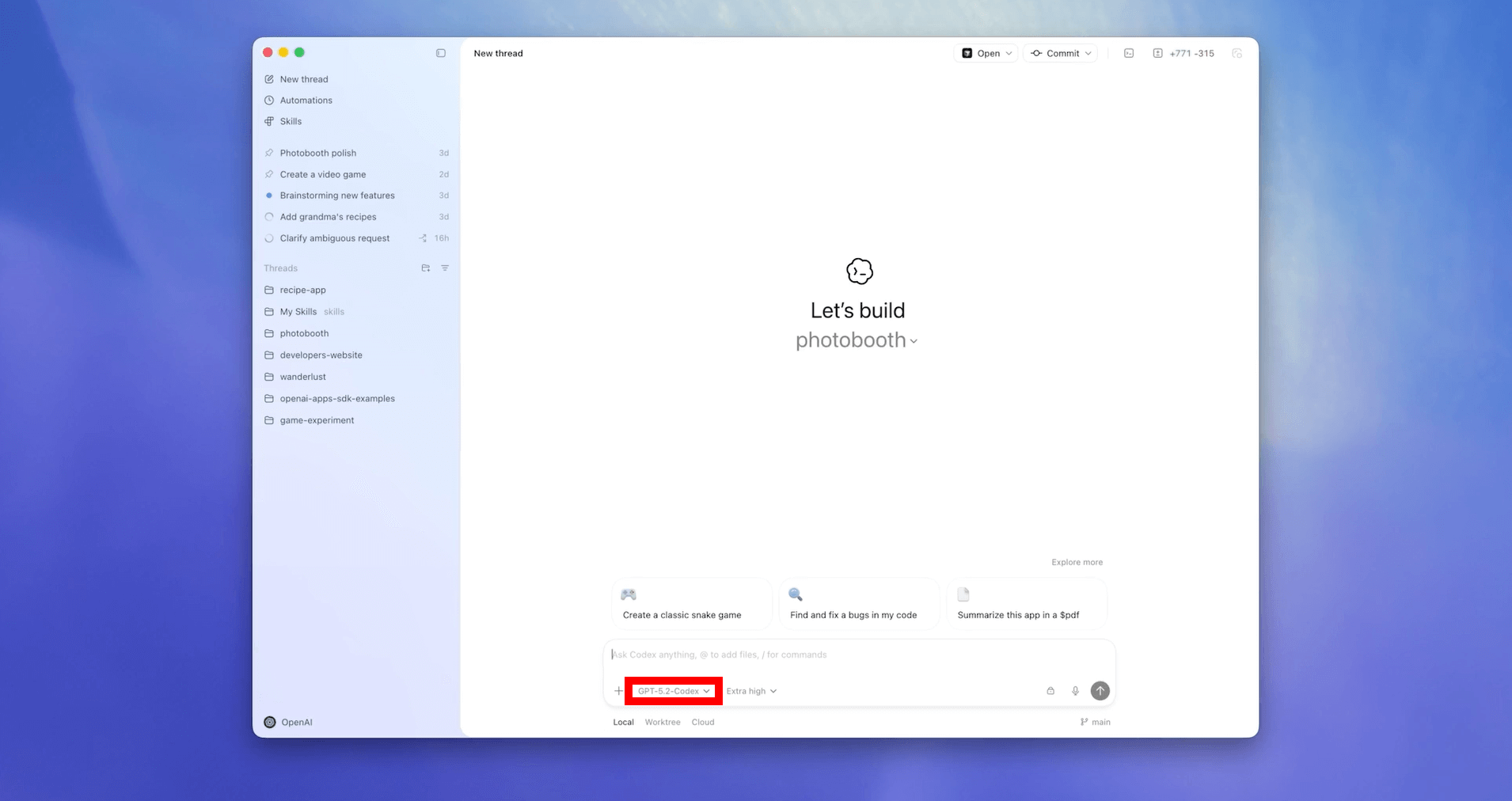

サインイン後、Codexで実際に作業を行うプロジェクトフォルダを選択します。

以前にアプリやCLI、IDE拡張機能でCodexを使用したことがある場合、過去に作業を行っていたプロジェクトが表示されます。

メッセージウィンドウ下部にあるモデル名をクリックすると、使用するモデルを選択できます。

ここでGPT-5.3-Codex-Sparkを選びましょう。

モデルを選択したら、セッションを開始しましょう。

セッション開始後は、変更したい箇所を具体的に指定しながら短いプロンプトを繰り返し送ることがポイントです。

応答が速い分、曖昧な指示でも素早く修正のサイクルを回せますが、精度を高めるためにはできる限り的確な指示を出すことを心がけましょう。

つまずきやすい点と対処法

Codex-Sparkを使い始めた際につまずきやすいのは権限周りで、Codex CLIやVS Codeの拡張機能は既定でワークスペース外の操作やネットワーク利用に制約があり、必要に応じて承認モードを切り替えて使用します。

CLIであれば/permissionsコマンド、VS Codeの拡張機能なら「Change permissions」から切り替え可能です。

自動実行を強めるほど便利ですが、フルアクセスはリポジトリやタスクを信頼できる場合に限定して使うのが前提です。

また、Codex-Sparkは高速化のため既定の動作が軽量で、指示しない限りテストを自動実行しない設計です。実行や検証が必要なときは、最初からテスト実行や確認手順を明示して依頼すると、意図したワークフローになりやすいです。

レート制限については、研究プレビュー中はCodex-Sparkの使用量が別枠で管理されており、需要が集中している時間帯には制限や順番待ちが発生することがあります。

そのような場合には、短い依頼に分割する、重要タスクは別モデルに切り替えるなどの運用が安定するでしょう。

GPT-5.3-Codex-Sparkの料金体系

最後に、GPT-5.3-Codex-Sparkを使用する際にかかる料金についてまとめます。

プラン別の利用可否

GPT-5.3-Codex-Sparkは研究プレビューとしてChatGPT Proユーザー限定で公開されており、APIでの利用は現時点では提供されていません。

各プランでの対応状況は以下の通りです。

| プラン | 月額料金 | GPT-5.3-Codex-Sparkの利用可否 |

|---|---|---|

| Free | 無料 | |

| Go | $8 | |

| Plus | $20 | |

| Pro | $200 | |

| Business | $30/ユーザー | |

| Enterprise | 要問い合わせ |

なお、料金や対応状況は変更される可能性があるため、公式サイトで最新情報を確認するようにしてください。

Pro(月額$200)で増える価値と判断基準

Codex-Sparkの研究プレビューへのアクセスはChatGPT Proユーザーに限定されており、専用の低遅延ハードウェアで動作するため使用量は別枠で管理されています。

月額$200のProプランは決して安くはありませんが、毎秒1,000トークン以上の超高速生成とリアルタイムのコード編集体験は、開発スピードを重視するプロのエンジニアにとって十分な費用対効果をもたらし得ます。

他にも、ChatGPTにおいて最高性能モデルであるGPT-5.2 Proへのアクセスや、あらゆるモデルへのアクセス拡大など、最新のAIを存分に活用したい方はProプランを検討する価値があるでしょう。

また、OpenAIの研究プレビューに早期アクセスできるという点でも、最新技術をいち早く試したい開発者にとっては大きなメリットです。

PlusやBusinessでの代替について

現時点でCodex-Sparkが利用できないPlus・Businessユーザーには、通常のGPT-5.3-CodexやGPT-5.1-Codex-Miniが主要な選択肢となります。

Sparkのような高速な応答を求める場合、GPT-5.1-Codex-Miniがより適しているでしょう。

PlusおよびProユーザーは使用量の上限に達した場合、既存のプランをアップグレードせずに追加クレジットを購入して作業を継続することができ、Business・Edu・EnterpriseプランはワークスペースクレジットをCodexの追加利用に充てることができます。

日常的なコード補完や中程度の複雑さのタスクであれば、通常のCodexモデルで十分な場面も多いため、まずはPlusプランで試してみるのがおすすめです。そのうえで、高速な反復が必要だと感じた場合にはProへのアップグレードを検討するのが現実的な判断基準と言えます。

API提供の現状と注意点

Codex-Sparkはリリース時点ではAPIとして一般向けに提供されていません。

そのため、自社サービスやツールにCodex-Sparkを組み込みたい開発者は、現時点ではAPIの提供開始を待つしかない状況です。

OpenAIはCerebrasとのデータセンター増強を進めており、今後のAPIアクセス解放が期待されていますが、時期の詳細は明らかにされていません。

さらに、開発者が Codex-Spark を自社製品へどのように統合したいかを把握するため、少数のデザインパートナー向けに API でも提供します。実際のワークロードで統合の最適化を進めながら、今後数週間で提供範囲を拡大していきます。

出典:GPT‑5.3‑Codex‑Spark のご紹介

運用上の注意点として、研究プレビュー中は使用量制限が予告なく変更される可能性があるため、業務の中核にすぐ組み込むのではなく、まずは補助的な用途から試すことが推奨されます。

専用の低レイテンシハードウェア上で動作するため、利用には別途レート制限が適用されます。研究プレビュー期間中は、需要に応じてこの制限が調整される場合があります。

出典:GPT‑5.3‑Codex‑Spark のご紹介

おすすめできる人と最初に試すべき運用パターン

GPT-5.3-Codex-Sparkは、こまめに方向性を確認しながら進める開発スタイルと相性が良いです。UIの微調整やスタイル変更を何度も繰り返すフロントエンドエンジニアや、コードレビュー中に気になる箇所をその場で検証したいリードエンジニア、そしてユーザーテスト前に短時間で複数の実装パターンを試したいプロダクト開発者などに向いています。

一方で、アーキテクチャ全体の設計や複数ファイルにまたがる大規模リファクタリングを主な業務とするエンジニアには、通常のGPT-5.3-Codexのほうが向いているでしょう。

最初に試すべき運用パターンとして、最も手軽なのはCodex-Sparkで開発した後、通常版のCodexで仕上げるという2段階ワークフローです。

Codex-Sparkはベンチマークにおいて通常版のCodexに迫る精度を記録しており、現実のソフトウェアエンジニアリングタスクの多くは、一定の精度を保ちつつ大幅な速度向上を享受できます。

ただし、精度が高いのは通常版のGPT-5.3-Codexであるため、より質を求める場面においては通常版の方が向いています。

高速なモデルで方向性を探り、精度の高いモデルで仕上げるという使い分けが有効となるでしょう。

まとめ

GPT-5.3-Codex-Sparkは、リアルタイムコーディング向けの高速モデルであり、実運用で活用できる高い性能を維持しながら高速な出力を実現しました。

UIの調整や対象を絞った編集など、短い反復を何度も繰り返すタスクに向いており、インタラクティブな開発体験でスピード感を重視するエンジニアに適しています。

精度を重視する場合はGPT-5.3-Codex、速度を重視する場合はSparkといった使い分けができ、タスクに応じたモデルの切り替えが有効です。

ChatGPTのProプラン利用者限定のモデルとはなりますが、高速な応答を体験したい人はぜひ導入を検討してみてください。