Google DeepMindは4月2日、オープンモデル群「Gemma 4」を発表しました。Gemma 4は、Gemini 3と同じ研究・技術基盤から生まれたモデル群で、Googleは「これまでで最も賢いオープンモデル」と位置付けています。高度な推論やエージェントワークフロー向けに設計されており、自社のハードウェア上でローカルに実行できる点が特徴です。

今回公開されたのは、Effective 2B(E2B)、Effective 4B(E4B)、26B Mixture of Experts(MoE)、31B Denseの4種類です。小型のE2BとE4Bは、スマートフォンやIoT機器などエッジデバイスでの利用を想定しています。一方、26Bと31Bは、個人向けPCや開発者向け環境での高度な推論やコード生成、エージェント処理に対応するモデルとして投入されました。

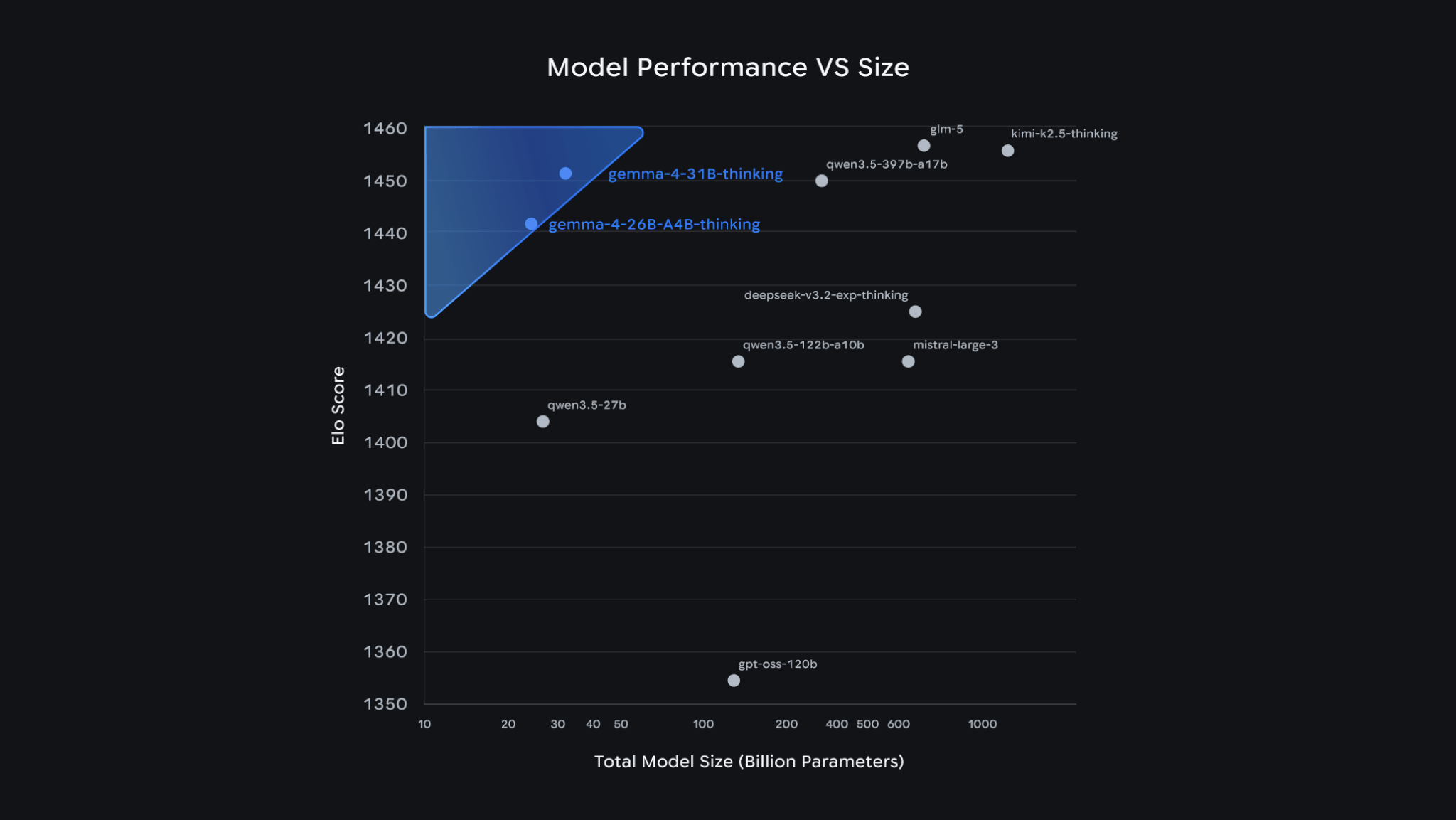

Googleによると、31Bモデルは4月1日時点のArena AIテキストリーダーボードでオープンモデル世界3位、26Bモデルは6位に入っています。Gemma 4は、自身の20倍規模のモデルを上回る性能を示す場面があるとされ、パラメータ当たりの性能の高さを強みとしています。

機能面では、複数段階の計画立案に対応する推論能力に加え、関数呼び出し、構造化JSON出力、システム命令を備えています。これにより、外部ツールやAPIと連携する自律型エージェントを構築しやすくなりました。コード生成にも対応し、ローカル環境中心のAIコードアシスタントとして使えます。さらに、全モデルが画像と動画をネイティブに処理し、OCRやグラフ理解にも対応します。E2BとE4Bは音声入力もサポートします。

コンテキスト長は、E2BとE4Bが128K、26Bと31Bが最大256Kです。対応言語は140以上で、長文処理や多言語アプリケーション開発にも活用できます。Googleは、Android端末、ノートPC向けGPU、ワークステーション、クラウドまで幅広い環境での利用を想定しています。

ライセンスにはApache 2.0を採用しました。商用利用を含めて制約が少なく、開発者がデータ、インフラ、モデルを柔軟に管理できる構成です。モデル重みはHugging Face、Kaggle、Ollamaなどから取得でき、Google AI StudioやGoogle AI Edge Galleryでも試用できます。オープンモデルと独自モデルの両輪で開発基盤を広げるGoogleの戦略が、Gemma 4で一段と鮮明になった形です。