画像生成AIによって、実在の児童に酷似した画像を生成するための追加学習用データがネット上で売買されていることが発覚しました。

過去に日本で活動した児童タレントのデータも含まれており、これらのデータを用いて生成された児童タレントに酷似した性的画像が別のサイトで販売されています。専門家は、現行の児童買春・児童ポルノ禁止法では規制が困難であり、法整備が必要であると主張しています。

読売新聞の調査では、過去に活動した複数の児童タレントの追加データが英語のサイトで暗号資産を用いて販売されていて、このデータをもとに生成された画像が別の日本語サイトで性的画像として販売されていました。

読売新聞は、過去に国内外で活動した複数の児童タレントの追加データを販売している英語のサイトを確認。サイト上では説明文に実在のタレント名が記され、1点あたり暗号資産で3ドル相当で取引されていた。成人の女性のデータもあった。

追加データが販売されていた日本の児童タレントと酷似した性的画像は、別の日本語サイトで数百円で販売されていた。AIで製造したと記され、複数の専門家によると、画像の特徴から、追加データで生成したとみられる。

引用元:実在児童に酷似した性的画像、生成AIで作成か…ネット上で追加学習用データを売買 : 読売新聞

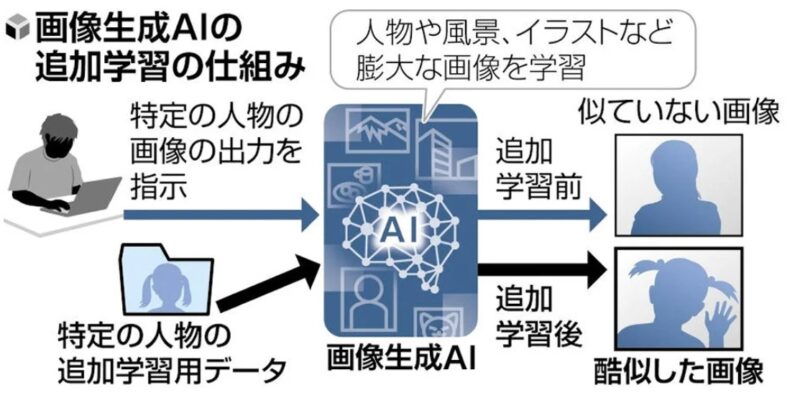

画像生成AIは大量の画像を短時間で生成できます。そのため実在の人物の追加データが流通すれば、酷似した性的画像が広範に拡散する恐れがあります。

法務省によると、児童ポルノ禁止法は実在する被害児童を対象としており、AIで生成された画像が規制対象となるには顔や体の特徴が酷似していないといけません。専門家は、現行法が想定していない状況に対応するため、法整備が必要だと強調しています。