動画生成AIツールのEasyAnimateが、ソースコードをGitHub上で公開しました。同ツールは、高解像度で長時間の動画を生成するためソリューションです。トランスフォーマーをベースとした拡散ジェネレーターのトレーニング、長尺映像を処理するためのVAEのトレーニング、メタデータの前処理が可能です。

🔥EasyAnimate: An end-to-end solution for generating high-quality, long videos!🎥

— Gradio (@Gradio) May 31, 2024

– Utilizes transformer-based diffusion models and VAEs🧩

– Generates videos up to 6 seconds long (144 frames) at 24 fps🎞️

– Incorporates motion module, U-ViT, and Slice-VAE techniques📹 pic.twitter.com/upRjXBNgOF

OpenAIのSoraのような構造とDITに基づき、トランスフォーマーを動画生成のためのdiffuserとして使用します。モーションモジュール、u-vit、slice-vaeをベースに構築しています。

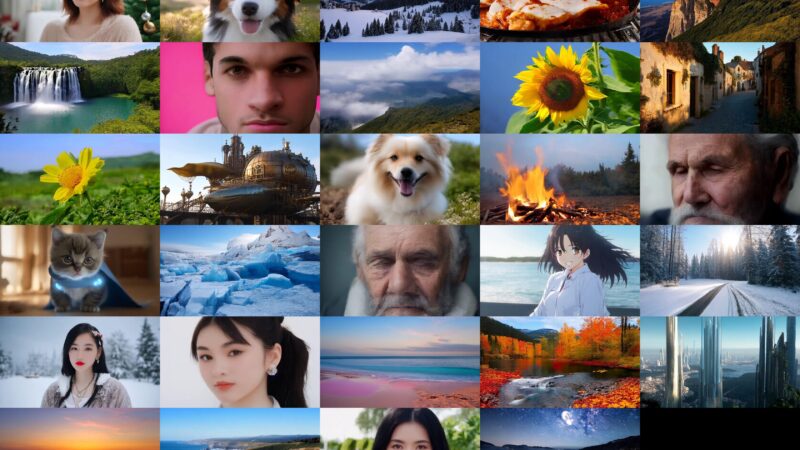

事前にトレーニングされたEasyAnimateモデルから直接予測を行い、24fpsで最長6秒のビデオを生成することができます。将来的にはより長いビデオをサポートする予定とのことです。また、ユーザー自身がベースモデルやLoRAモデルをトレーニングし、特定のスタイル変換を実行することもできます。

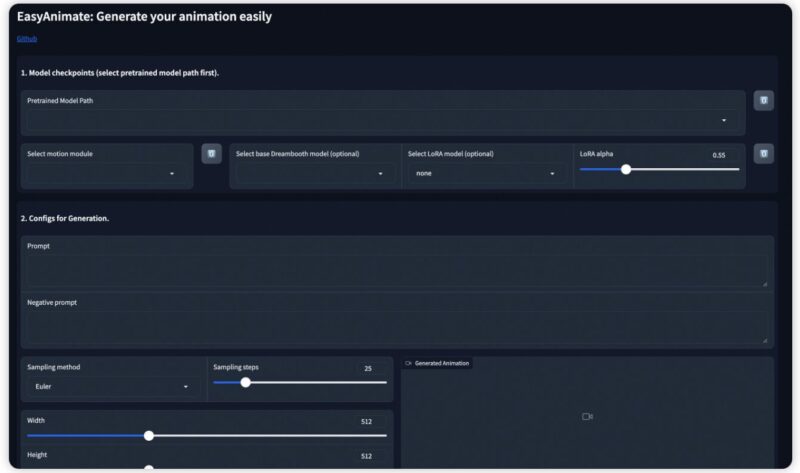

提供するインターフェースでは、ベースモデル、モーションモジュールのバージョン、ベースチェックポイント、LoRAモデルを選択できます。プロンプトおよびネガティブプロンプトを入力後、generateをクリックして動画を生成します。

将来的には効果を向上させるために、より多くのトレーニングプログラムを試みるということです。