「ChatGPT-4oとは?」「無料で使えるの?」と疑問を感じている方も多いのではないでしょうか。

本記事では、ChatGPT-4oの使い方や料金プラン、無料で使える範囲や回数制限を解説しています。

さらに、アプリでの使い方や外部ツールとの連携方法、日本語対応についてもご紹介しています。

読み終える頃には、自分に合った使い方がわかり、安心してChatGPT-4oを使い始められるようになるでしょう。

ChatGPT-4oとは?旧モデルより多機能・高速な最新AI

ChatGPT-4oは、OpenAIが提供する新世代のAIモデルです。

従来のGPT-4と比較して、高速・高性能・多機能のすべてを兼ね備えた「万能型モデル」として登場しました。

4oの「o」はすべてを統合する“Omni”の頭文字

GPT-4oの名称に含まれる「o」は、「Omni(オムニ)」の頭文字に由来しています。

Omniは「すべてを包含する」「万能の」といった意味を持ちます。

ChatGPT-4oは、テキスト・音声・画像といった異なる入力をひとつのAIで統合的に理解・出力できる点が大きな特長です。

OpenAIは、GPT-4oを以下のように説明しています。

GPT‑4o (“o” for “omni”) is a step towards much more natural human-computer interaction—it accepts as input any combination of text, audio, image, and video and generates any combination of text, audio, and image outputs.

GPT-4o(”o “は “omni “の意)は、より自然な人間とコンピュータのインタラクションへの一歩であり、テキスト、オーディオ、イメージ、ビデオのあらゆる組み合わせを入力として受け入れ、テキスト、オーディオ、イメージのあらゆる組み合わせを出力として生成する。

出典:OpenAI

異なる情報ソースをまたいで一貫した出力ができるため、これまで以上に自然で多彩なコミュニケーションが実現可能になりました。

ChatGPT-4やo3との位置づけと比較

GPTシリーズは、それぞれの特性に応じて適切に使い分けられます。

精度重視・日常利用・高度な情報探索まで、目的別に選ぶことで最大の効果が得られます。

| モデル | 利用可能プラン | 主な特徴 | 主な用途 |

|---|---|---|---|

| GPT-4 | API専用 | 高精度 高安定 | 法務文書 研究レポート 業務組込みなど |

| GPT-4o | Free Plus Pro Team Enterprise API | 高速 低コスト マルチモーダル対応 | 日常Q&A 画像説明 音声対話 簡易分析など |

| GPT-o3 | Plus Pro Team Enterprise API | 複数ツールの連携 高度な推論 | 研究開発 戦略立案 分析業務など |

GPT-4は、安定性と応答精度が求められる企業ユースに向いています。

GPT-4oはマルチモーダル対応と速度面のバランスが良く、個人利用でも扱いやすいモデルです。

最新のo3は、ChatGPT内のツール群(Python・Web・画像解析など)を組み合わせてタスクを自律的にこなす推論型AIです。

ChatGPT-4oの進化した5つの注目アップデート

ChatGPT-4oは、従来のGPT-4と比べて多くの面で進化を遂げました。

中でも注目すべき5つのアップデートを紹介していきます。

テキスト・画像・音声を統合したマルチモーダル対応

GPT-4oの最大の特長は、テキスト・画像・音声というさまざまなタイプの情報を、ひとつのモデルで扱える「マルチモーダル対応」です。

例えば、画像をアップロードして音声で質問し、返答をテキストで受け取るといった操作もスムーズに行えます。

従来は、画像には画像生成AIのDALL·E、音声には音声生成AIのWhisperといった個別モデルを組み合わせる必要がありました。

しかし、GPT-4oではすべてが統合されたため、情報の整合性が高まりユーザー体験が格段に向上しました。

用途に応じて、異なる出力形式を自由に選べるのも強みです。

高精度な画像生成&画像解析が可能に

2025年3月に搭載された「4o Image Generation」により、GPT-4oは画像生成能力も強化されました。

テキストの指示に応じて、構図や内容を正確に反映した高品質な画像を生成できます。

注目ポイントは以下の通りです。

- 日本語テキストの自然な描画

- 構図や人物設定の忠実な再現

- チャット形式による段階的な修正

- 複数画像におけるキャラ特徴の維持

- 細かな描写指示への高い追従性

さらに、画像解析機能も進化し、アップロード画像のテキスト認識や複雑なパターン分析もこなします。

資料読解や視覚データの活用にも期待が高まっています。

割込み&感情表現に対応した音声会話

GPT-4oの音声会話は、より人間らしいやり取りができるよう設計されています。

注目すべきは、会話中の「割り込み」への対応と「感情をともなうやり取り」です。

従来のAIでは発話中にユーザーが話しかけるのは難しく、会話のテンポに違和感がありました。

GPT-4oでは、会話中に自然に割り込むことができ、やり取りがよりリアルになっています。

さらに、ユーザーの声のトーンを読み取って、会話に合わせた感情表現のある返答が可能です。

It can respond to audio inputs in as little as 232 milliseconds, with an average of 320 milliseconds, which is similar to human response time in a conversation.

最短で232ミリ秒、平均で320ミリ秒の速さで音声入力に応答できます。この応答速度は、会話における人間の応答速度とほぼ同じです。

出典:OpenAI

GPT-4oは、まるで人間と話しているかのような、リアルな対話体験を実現しています。

最大128Kトークンの超長文コンテキストに対応

GPT-4oは、一度に読み取れる情報量が大幅に増え、最大128,000トークン(日本語換算で約10万語)まで対応しています。

128,000 context window

出典:Model – OpenAI API

長文や複雑な対話も文脈を維持したまま処理できます。

主な利点は以下の通りです。

- 論文や契約書などの長文を一括で処理

- 長いチャットのやりとりでも文脈を保持可能

- 大量のデータを一貫したロジックで分析できる

従来のモデルでは、会話や文章が長くなると、途中の内容を忘れてしまうこともありました。

GPT-4oではその制限が大きく緩和され、読み取れる文量も、理解の一貫性も大きく向上しています。

日本語トークナイザーの強化で非英語も効率化

GPT-4oでは、文章を最小の意味単位に分ける「トークナイザー」の性能が全体的に向上しています。

日本語を含む多言語で、より効率的な処理が可能になりました。

特に日本語では、GPT-4と比べておよそ1.4倍のトークン効率が改善されたと報告されています。

Japanese 1.4x fewer tokens (from 37 to 26)

日本のトークンが1.4倍減少(37枚から26枚へ)

出典:OpenAI

主な恩恵は以下の通りです。

- APIコスト削減につながるトークン節約

- 応答速度の向上による操作性改善

- 自然な文脈理解と表現生成

- 長文読解や要約の精度向上

日本語ユーザーにも、英語圏と同等レベルで高度な対話やデータ活用が行える環境が整いつつあります。

今後は、翻訳や教育支援、業務自動化といった領域での活用がさらに進むことが期待されます。

ChatGPT-4oの料金プランと無料プランの回数制限

ChatGPT-4oでは、無料から法人向けまで幅広い料金プランが用意されています。

自分に合ったプランを選ぶために、まずは各プランの違いを整理しておきましょう。

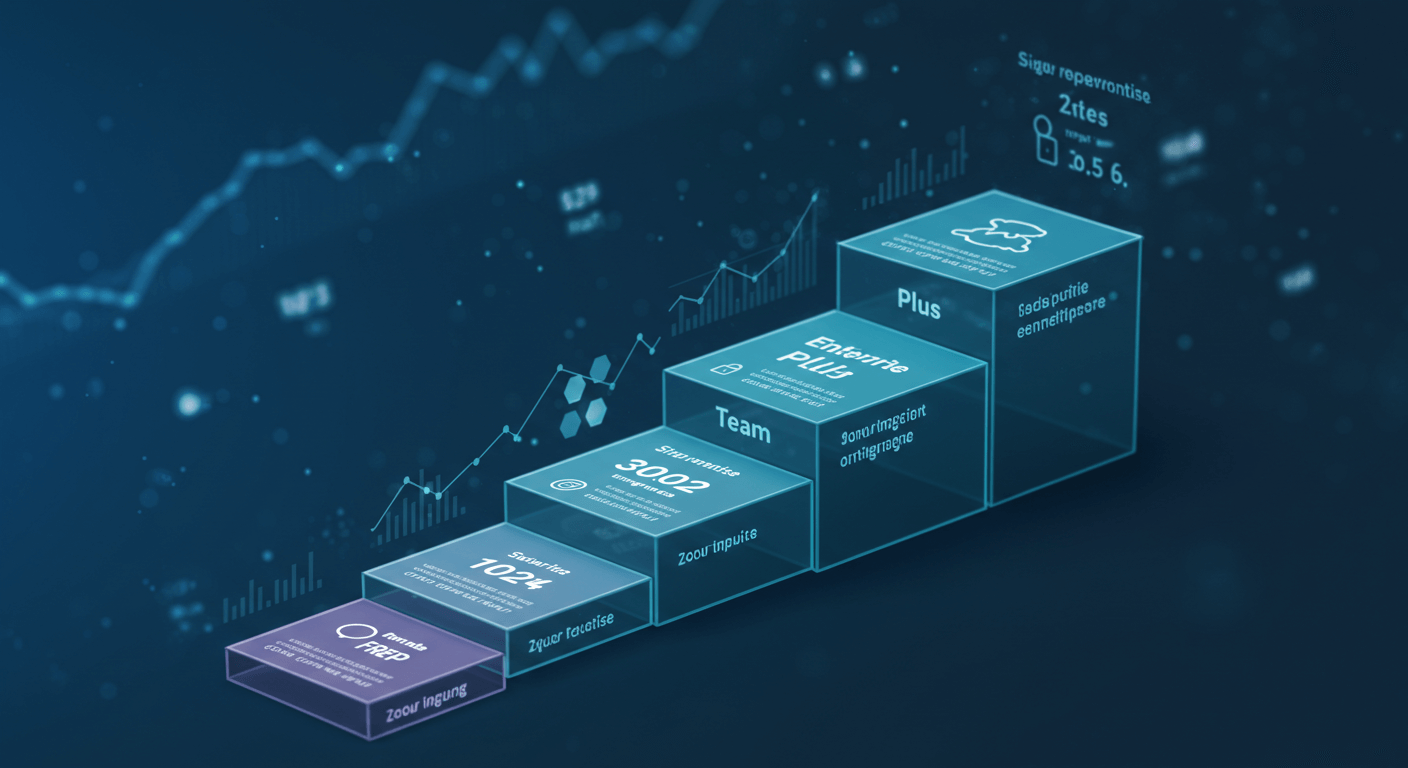

プラン別の機能比較(Free/Plus/Team/Enterprise/API)

ChatGPTの機能や使い勝手は、契約するプランによって大きく変わります。

GPT-4oを活用する上では、無料プランと有料プランで使える機能や回数に違いがあるため、事前に比較しておくことが重要です。

以下に、各プランの特徴と制限の違いをまとめました。

| プラン名 | 月額料金 | GPT-4oの主な特徴とプラン概要 |

|---|---|---|

| Free | 無料 | 約5時間で10回まで利用可能 画像生成は1日5回まで 音声・分析は制限付き |

| Plus | $20 約3,000円 | 優先アクセスあり 画像生成は実質無制限 マルチモーダル機能に対応 |

| Team | $30 ユーザー/月 | チームでの共同編集 管理機能付き 全機能を安定利用可 |

| Enterprise | 要問い合わせ | 大規模導入向け セキュリティ強化(DLP・VPC) 学習除外 制限緩和 |

| API | 従量課金 | 入力100万=$5、出力100万=$15 画像/音声/分析APIに対応 無料枠あり |

それぞれのプランは、個人の試用からビジネスチーム、大規模な法人利用まで幅広く対応しています。

「まず試してみたい」「チームで共有したい」「API連携でサービスに組み込みたい」といった目的に応じて、柔軟に選択できる構成です。

無料プランの回数制限とリセット周期

ChatGPT-4oは、無料ユーザーでも利用できる点が大きな魅力です。

ただし、利用にはいくつかの注意点があります。

まず、無料プランではGPT-4oの利用回数に制限があり、筆者の検証では以下のような仕様が確認できました。

- チャットは最大10回まで連続使用可能

- 上限を超えると「GPT-4.1 mini」に自動切り替え

- 約5時間経過で使用回数がリセットされる

- 画像は最大5回まで連続生成可能

- 生成画像に対して24時間経過でリセットされる

なお、これらの仕様はOpenAIのサーバー負荷や運用状況に応じて、今後変更される可能性があります。

画像生成・音声通話など特定機能の追加課金対象

GPT-4oでは、画像生成や音声通話などの高度な機能を追加課金なしで利用できます。

ただし、プランによって利用回数や制限には違いがあります。

特に無料プランは利用回数に厳しい上限があるため、画像生成や音声通話などを頻繁に利用したい場合はPlusプラン以上の利用がおすすめです。

下記の表は、主要な機能ごとのプラン別制限例です。

| 機能 | 無料プラン | Plusプラン以上 |

|---|---|---|

| 画像生成 | 1日5回 | 明確な制限なし |

| 音声通話 | 上限あり/制限非公開 | 安定/制限非公開 |

| データ分析 | 3ファイル/日 最大512MB 計10GB | 最大80ファイル/3時間 最大512MB 計10GB |

ChatGPT-4oの始め方と使い方|ブラウザ・アプリ・API連携まで

ChatGPT-4oは、誰でも手軽に始められるAIサービスです。

アカウント作成からアプリ操作、API連携まで、基本の使い方を順に解説します。

ChatGPTのアカウント作成方法

ChatGPT-4oを使うには、まずOpenAIアカウントの登録が必要です。

無料プランでも利用でき、数分で完了します。

- ChatGPTにアクセス

- 「Sign up」をクリック

- 登録方法を選択(メールアドレス、Google、Apple、Microsoft)

- メールの場合は認証メールを確認

- プロフィール情報を入力

- 登録完了

登録後、すぐにChatGPTの無料版にアクセスでき、GPT-4oも制限付きで試せます。

まずは無料から始めて、必要に応じて有料プランへ切り替えるのがスムーズです。

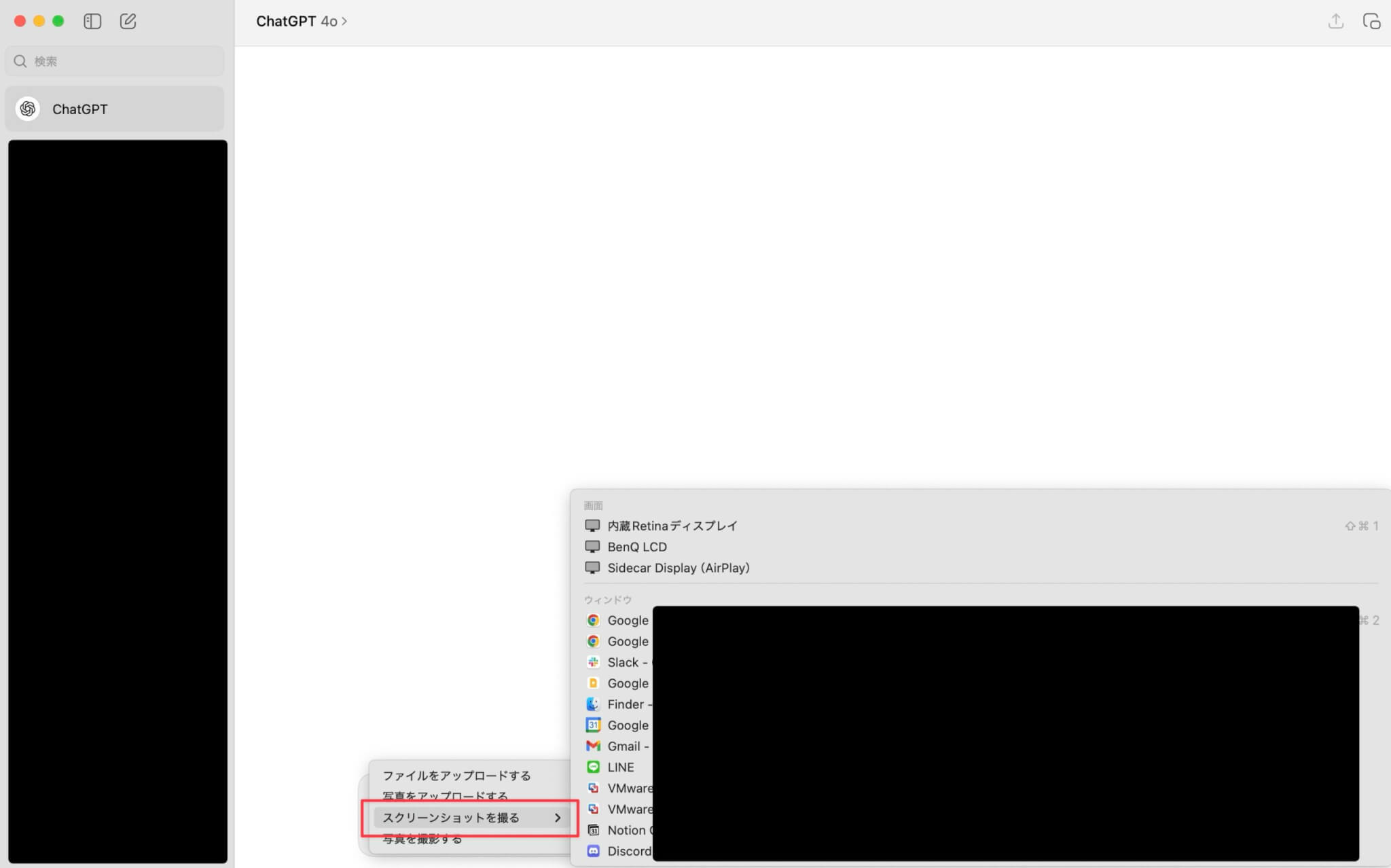

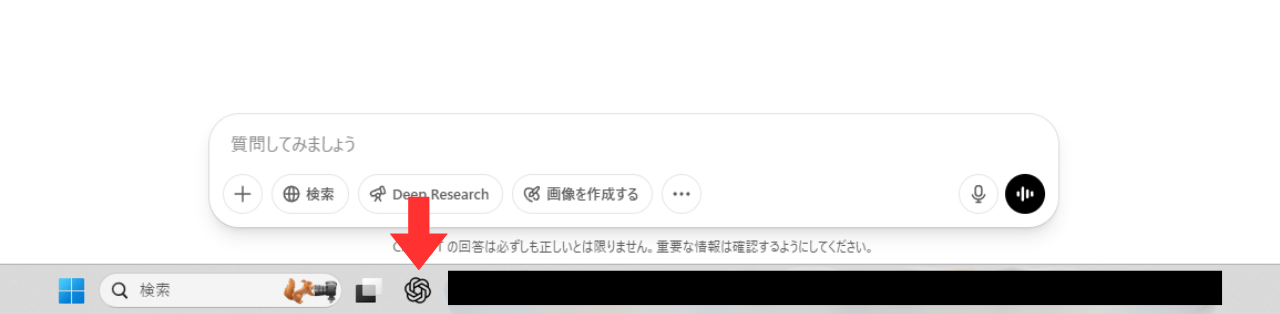

デスクトップアプリ(macOS/Windows)の操作ポイント

ChatGPTは、macOS/Windows向けの公式デスクトップアプリにも対応しています。

インストールすれば、ブラウザを開かずにいつでも利用可能です。

ログインはWebと同じアカウントで行え、すでに登録済みであればすぐに使い始められます。

Macではマルチウィンドウや画面キャプチャ機能が使用できます。

Windowsではタスクバー常駐や最小化からの即復帰など、OSごとの利便性も活かせます。

会話履歴はスマホやブラウザと自動同期され、どのデバイスからでもシームレスにやりとりを続けられます。

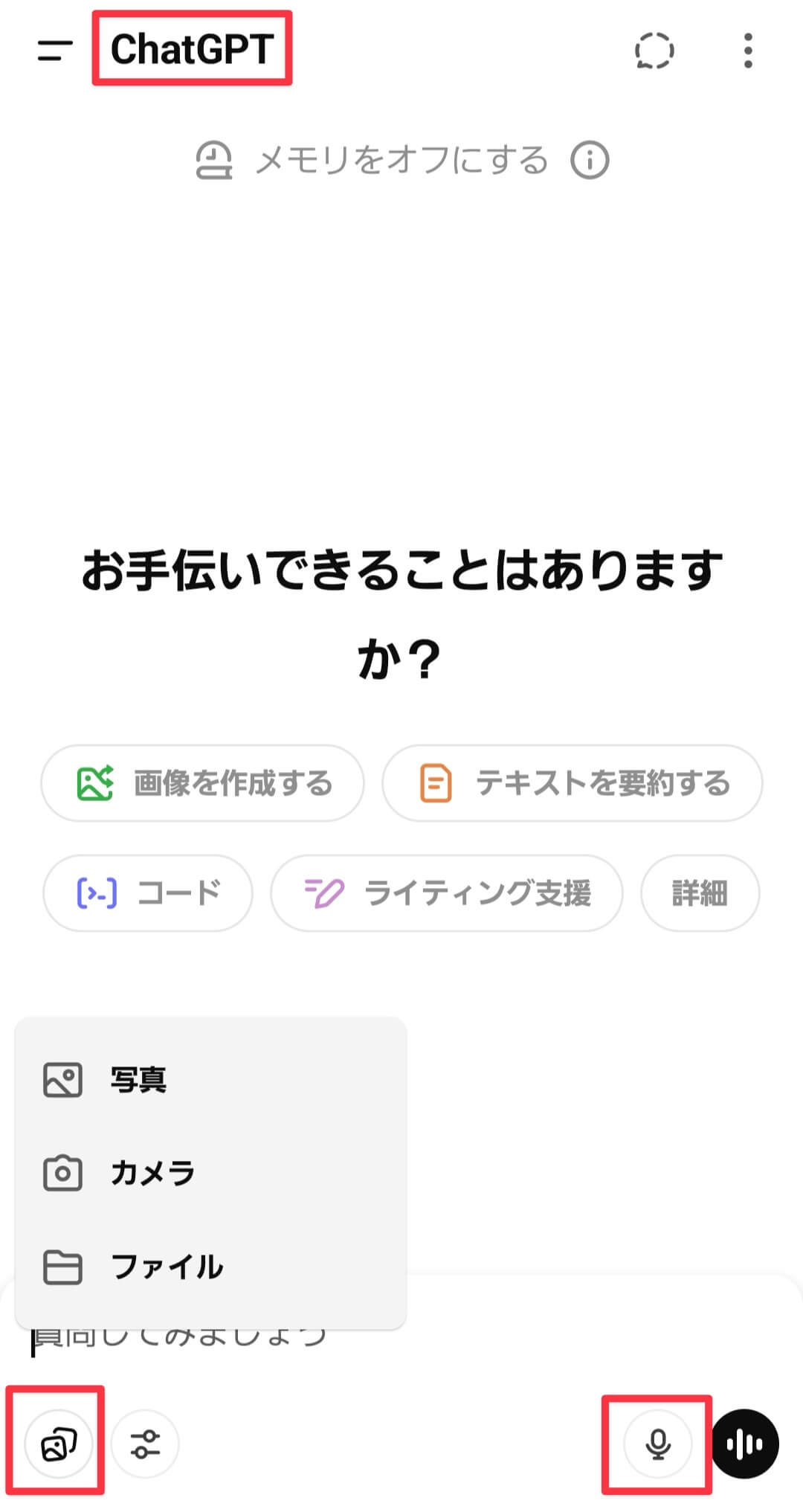

スマホアプリ(iOS/Android)の操作ポイント

ChatGPT-4oは、スマートフォン用の公式アプリでも利用できます。

アプリはApp Store/Google Playで「ChatGPT」と検索してダウンロード。

ログインにはWebで作成したアカウントが使え、Googleアカウントなどでの簡易ログインにも対応しています。

音声入力はマイクアイコンから、画像アップロードはiPhoneなら「+」ボタン、Androidなら「クリップアイコン」から操作可能です。

画面上部から、モデルの選択も簡単に切り替えられます。

会話履歴はクラウド上で同期され、PCとスマホ間での切り替えもスムーズです。

Azure OpenAI Studioでの利用方法

法人利用やセキュリティ重視の場面では、Microsoftの「Azure OpenAI Service」が有効です。

GPT-4oを業務用途で安全に活用でき、企業のセキュリティ要件やコンプライアンスにも対応します。

- Azure OpenAI Studio 利用の3ステップ

-

- AzureポータルでOpenAIリソースを作成

- モデル(GPT-4oなど)をデプロイし、接続情報を取得

- API連携を設定して利用開始

ネットワーク制限やデータ保持ポリシーの管理も可能で、Microsoft製品との連携やスケーラブルな運用にも適しています。

おすすめのプロンプト例を紹介

ChatGPT-4oを効果的に使うには、用途に合わせてプロンプトを工夫しましょう。

希望に近い文章を作成してもらうには、次のような点を意識するのがコツです。

- 目的やテーマを明確に伝える

- トーンや雰囲気を指定する

- 想定する読者層を伝える

理想に近い画像を作ってもらうには、下記のような情報を具体的に指示すると効果的です。

- 描きたい構図やシーンを具体的に伝える

- 雰囲気や画風を細かく指示する

- 入れたい要素や背景を明示する

より正確な分析や使いやすいコードを得たい場合は、次のような点を伝えると精度が上がります。

- ステップごとに説明するよう依頼する

- 条件や前提をはっきり伝える

- 出力形式を指定する

希望の手順や形式を明示するのがポイントです。

ChatGPT-4oの実力は?代表的なテストでの評価

GPT-4oの進化は数値でも証明されています。

ここでは、主要ベンチマークスコアと他AIモデルとの比較から、GPT-4oの実力を見てみましょう。

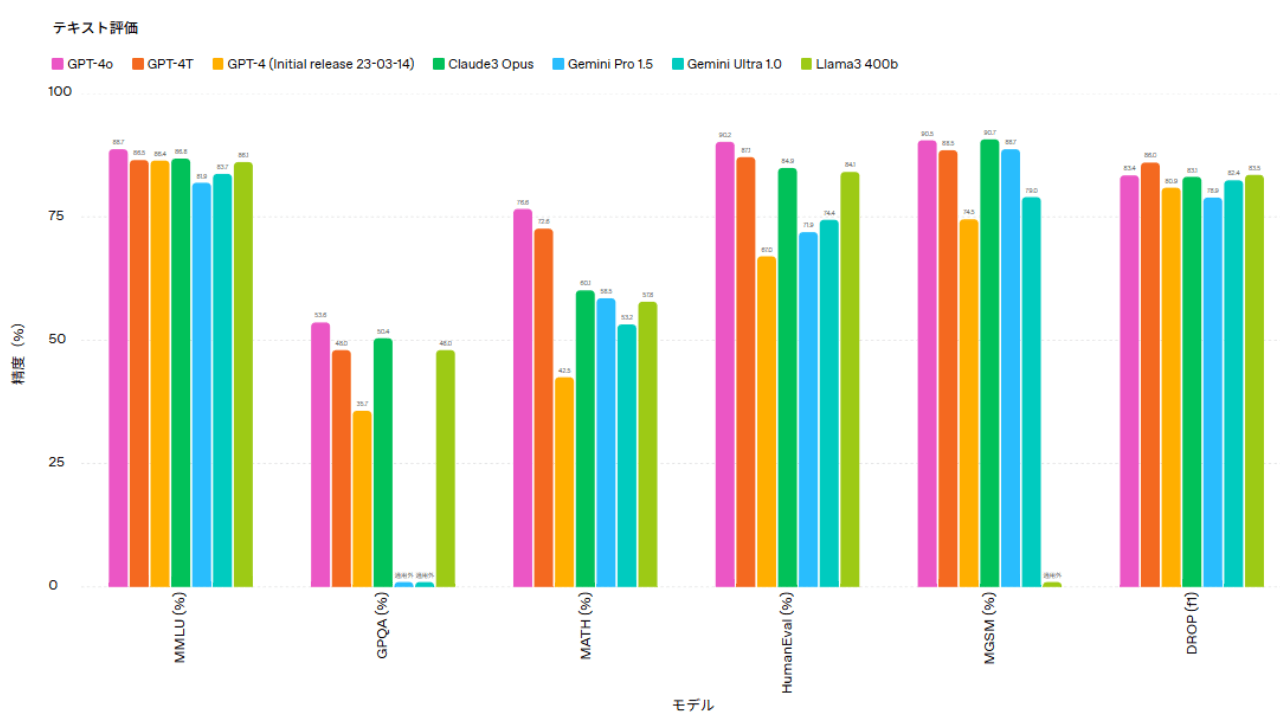

性能ベンチマークと実力比較

GPT-4oは、知識力や計算力、コーディング能力などを測るさまざまなベンチマークテストで、非常に高いスコアを記録しています。

どの分野でもGPT-4oはバランスよく高得点を獲得しており、総合的な「賢さ」が際立っています。

大学レベルの知識を問う「MMLU」や、プログラム生成能力を測る「HumanEval」、数学の難問「MATH」など幅広い分野でトップクラスの実力を示しています。

算数応用問題「MGSM」ではClaude 3.5 Opusなど他モデルが僅差で上回るケースも見られますが、GPT-4oもほぼ同等の成績です。

下記の表は、主要な最新AIと比較したときのテスト結果です。

| テスト名 | 内容 | GPT-4o | GPT-4T | GPT-4 (23-03-14) | Claude 3 Opus | Gemini Pro 1.5 | Gemini Ultra 1.0 | Llama3 400b |

|---|---|---|---|---|---|---|---|---|

| MMLU | 大学レベルの幅広い知識 | 82.7 | 82.5 | 86.4 | 86.5 | 81.3 | 86.5 | 86.3 |

| GPQA | 大学院レベルの専門知識 | 53.6 | 46.9 | 50.4 | 33.7 | 測定外 | 測定外 | 46.2 |

| MATH | 数学の難問 | 76.6 | 72.6 | 42.5 | 60.1 | 61.2 | 57.8 | 57.2 |

| HumanEval | プログラムの生成・コーディング能力 | 92.7 | 87.1 | 67.0 | 84.9 | 74.4 | 71.3 | 84.1 |

| MGSM | 小学生レベルの算数応用問題 | 96.3 | 95.5 | 74.5 | 90.7 | 92.7 | 78.9 | 92.7 |

| DROP | 長文読解と情報抽出力 | 85.9 | 83.1 | 78.9 | 82.4 | 81.5 | 81.3 | 81.3 |

画像・音声・コード分野での実力

マルチモーダル機能においても、GPT-4oは非常に高い評価を得ています。

画像分野では、従来よりも正確で一貫性のある画像処理が可能です。

- 画像Q&Aの正答率が従来より約10%アップ

- 写真やイラスト内の文字も高精度で認識

- キャラクターや画風を統一した画像生成

音声分野でも、応答の速さと認識精度が大幅に向上しました。

- 応答速度は平均320msと非常に高速

- Whisper(音声生成AI)並みの高精度な音声認識

- 声のトーンに合わせて自然に返答

コード分野では、生成・修正ともに高い正確性を実現しています。

- コード生成テストで正答率90.2%(GPT-4より5%向上)

- バグ修正テストでも96.7%の高精度

- コードの自動説明やドキュメント作成も強化

画像や音声、コード分野で示された高いパフォーマンスが、実務・教育・開発のあらゆる場面で役立つことを証明しています。

ChatGPT-4oの日本語対応と翻訳精度

ChatGPT-4oでは、日本語の処理性能が大幅に向上しました。

より自然な日本語生成と精度の高い翻訳が可能になり、非英語ユーザーにも使いやすいモデルへと進化しています。

日本語精度と多言語対応が進化し実用性アップ

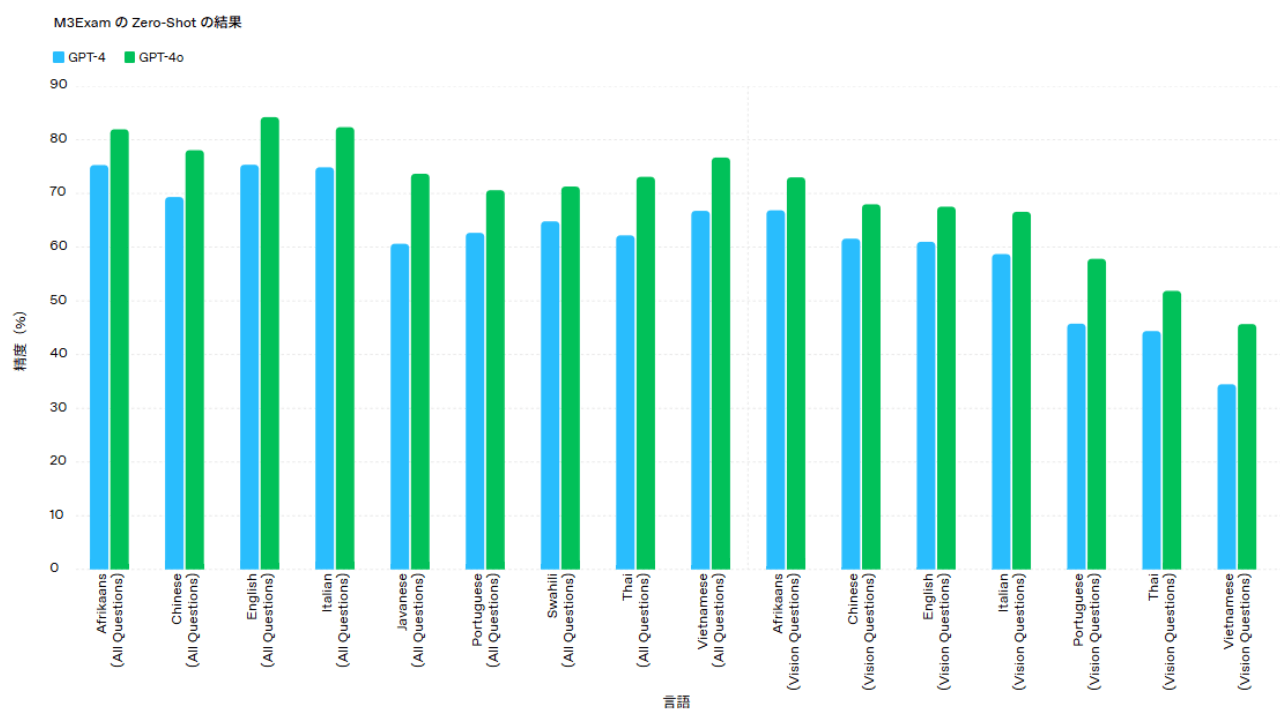

下のグラフは、多言語評価テスト「M3Exam Zero-Shot」におけるGPT-4oとGPT-4の精度を比較したものです。

日本語(Japanese)を含むすべての言語で、GPT-4o(緑色)がGPT-4(水色)より高い正答率を示しています。

「All Questions」は、テキストだけでなく画像を含むあらゆるタイプの設問を総合的に評価した結果です。

「Vision Questions」は画像理解が必要な問題に限定した結果を表しています。

このグラフから、GPT-4oは日本語を含む多言語・マルチモーダルな設問でも、従来モデルより大幅に精度が向上しているのがわかります。

敬語や固有名詞の処理は今後に期待

GPT-4oは日本語にも対応していますが、まだ完全ではありません。

特に敬語や固有名詞の扱いなど、日本語特有の表現には苦手な部分があります。

現状の主な課題は以下の通りです。

- 敬語の使い分けが正確でない場合がある

- 固有名詞の読み方や意味を間違えることがある

- 新語や時事用語への対応が不十分なことがある

日本語特有の表現に対応するためには、日本語に特化した学習やモデルの改良が必要です。

今後のアップデートにより、より自然で正確な日本語が使えるようになることが期待されています。

ChatGPT-4oの活用法|個人もビジネスも強力にサポート

ChatGPT-4oは、高精度なマルチモーダル対応と処理速度の向上により、個人・企業を問わず幅広いニーズに応えられるAIツールです。

ここでは、代表的な活用シーンを具体的に紹介します。

ChatGPT-4oの個人活用法|学習・画像図解・要約補助など

GPT-4oは、日常生活や学習、創作など、さまざまなシーンで活用できる対話型AIです。

単なる検索ツールではなく、自分の考えを整理したり、次の行動を後押ししてくれる思考のパートナーとして活用できます。

代表的な活用例は次の通りです。

- 語学学習や文法チェック

- 資格対策や要点整理

- コードの解説や開発支援

- 創作活動や構成づくり

- 図解や情報の整理

GPT-4oを「一緒に考える相手」として日常に取り入れることで、発想力や作業効率を大きく高められます。

ぜひ、自分の目的や悩みに合わせてGPT-4oを活用し、自分らしい使い方を見つけてみてください。

ChatGPT-4oのビジネス活用法|Drive連携・OCR・データ分析など

GPT-4oは、業務効率化から翻訳・分析まで、さまざまなビジネス課題に対応できる高性能AIです。

Enterpriseプランならセキュリティも強化され、安心して実務に活用できます。

主な活用例は次の通りです。

- 議事録や報告書の自動作成

- SNSや販促資料の文案作成

- メール翻訳や異文化対応

- 競合分析やレポートの自動化

- 契約書の要約やFAQ生成

重要な文書や公開前の情報は、必ず人が最終確認することで精度と信頼性がさらに高まります。

業務内容や目的に合わせてGPT-4oを使い分けるのが、成果につながるポイントです。

ChatGPT-4oのセキュリティとプライバシー対策

AIを日常的に使う時代において、セキュリティとプライバシーの確保は欠かせません。

ChatGPT-4oでは、個人・法人それぞれに応じた対策機能が整備されています。

一般利用における実践すべきセキュリティ対策

ChatGPT-4oを安全に使うには、基本的なセキュリティ対策を習慣化するのが重要です。

履歴や個人情報の扱いに注意しつつ、便利な機能も正しく使いましょう。

以下に主な対策を整理しました。

- 二段階認証によるログイン強化

- 機密情報の入力回避

- 不要履歴の定期削除

- 履歴保存の無効化(オプトアウト)

出力内容を他者と共有する際は、個人情報のマスキング処理(大事な部分を隠すこと)も有効です。

ツールの特性を理解し、安心して日常的に活用できる環境を整えましょう。

法人利用におけるデータ管理方針と暗号化対策

企業でGPT-4oを導入する際は、業務データの取り扱いとセキュリティ対策が不可欠です。

ChatGPT Enterpriseは、以下のような明確な方針と高度な管理体制を備えています。

You own and control your business data in ChatGPT Enterprise. We do not train on your business data or conversations, and our models don’t learn from your usage. ChatGPT Enterprise is also SOC 2 compliant and all conversations are encrypted in transit and at rest.

ChatGPT Enterpriseのビジネスデータは、あなたが所有し管理しています。 ChatGPTエンタープライズでは、お客様のビジネスデータや会話から学習することはありません。 また、ChatGPT EnterpriseはSOC 2に準拠しており、すべての会話は転送中および静止状態で暗号化されています。

出典:OpenAI

会話内容や業務データはAIの学習には使用されず、利用者が自ら管理できる設計となっています。

さらに、SOC2準拠に基づく暗号化により、企業レベルのセキュリティ要件も満たしています。

GPT-4oを使いこなすには、性能を見るだけでなく、安心して運用できる体制づくりも重要です。

まとめ

ChatGPT-4oは、マルチモーダル処理・高速性能・高精度な日本語対応を備えた次世代のAIアシスタントです。

個人から法人まで、活用の場が広がり続けています。

注目すべきポイントは次の3つです。

- テキスト・画像・音声をまとめて扱える

- GPT-4比で約2倍の処理速度と高いコスト効率

- 日本語精度と柔軟な料金プランで導入しやすい

今後さらに進化が進む中で、重要なのは「どう使いこなすか」です。

プロンプト設計や出力の見直しを意識し、自分に合った活用法を見つけていくのが大切です。

AIと共に前進する姿勢を持ち、未来の可能性を広げていきましょう。