ChatGPTの登場から数年が経ち、今や世の中のアプリサービスやシステムにおいてAIの存在は欠かせないものとなりました。

ChatGPTを活用して作業を効率化したり業務の自動化を図ったりと、多くの社内システムにも導入され始めていますが、利用にあたりデータの取り扱いに関して慎重な対策が必要です。

この記事では、ChatGPTをよく利用している方に向けて、プライバシー保護や情報漏洩防止の観点から、ChatGPTにデータの学習をさせない(オプトアウト)ための具体的な手順やデメリット、最新の注意点について紹介します。

【2026年最新】ChatGPTオプトアウトの設定方法

ChatGPTは、日常業務から高度な分析業務まで幅広く活用されています。便利さゆえに個人情報や機密情報の入力が求められるシーンも多く、入力した情報がChatGPTのモデル学習に利用されてしまう可能性が懸念されています。

特に業務での利用においては情報漏洩を防ぐための対策が必須です。

オプトアウト機能は、ChatGPTが個人情報などの入力データを学習に利用するのを防ぎプライバシーを守れます。

ここでは、2026年の最新版ChatGPTのオプトアウト設定方法について具体的に解説していきます。

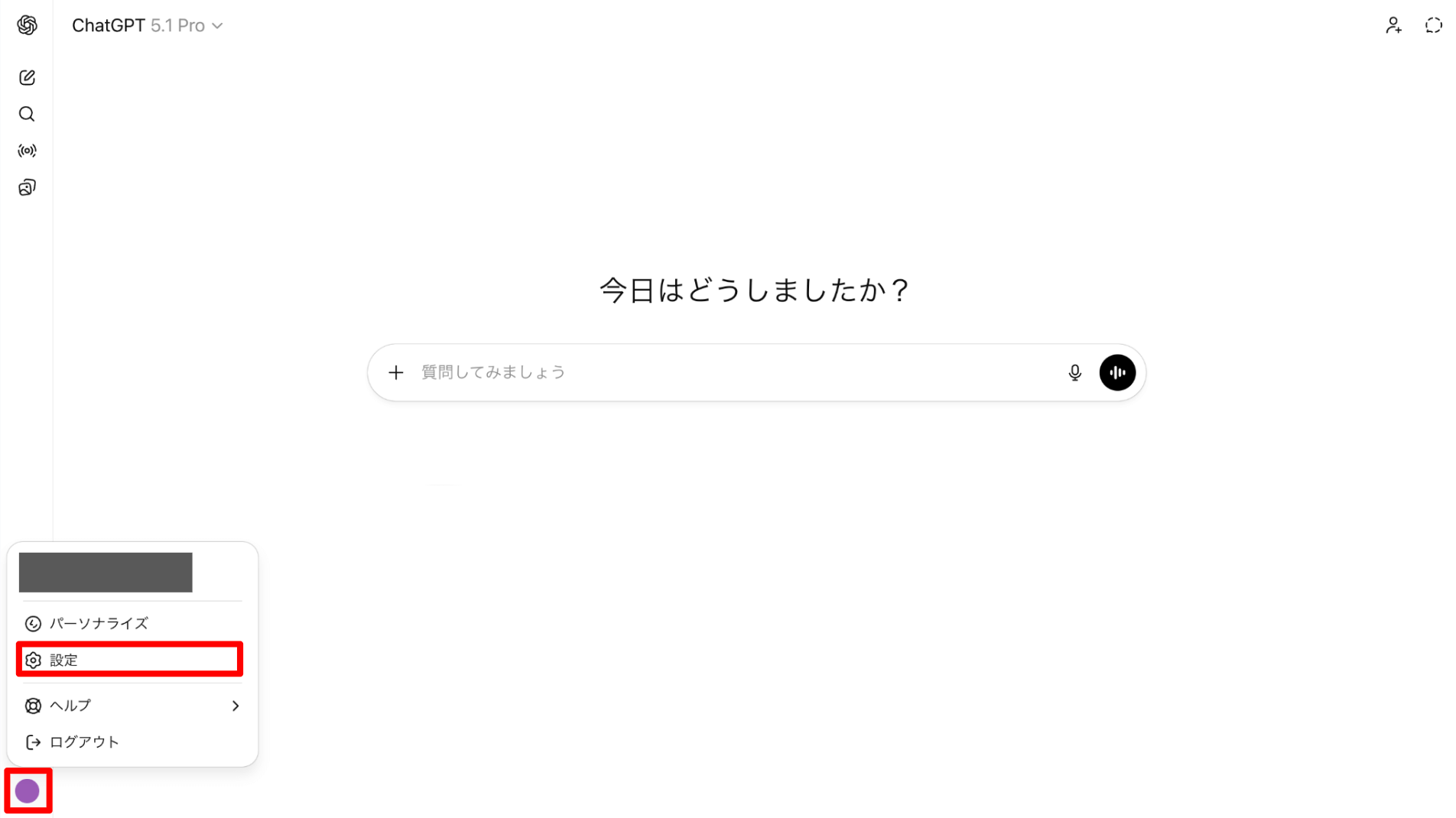

設定画面から学習させない設定に変更する

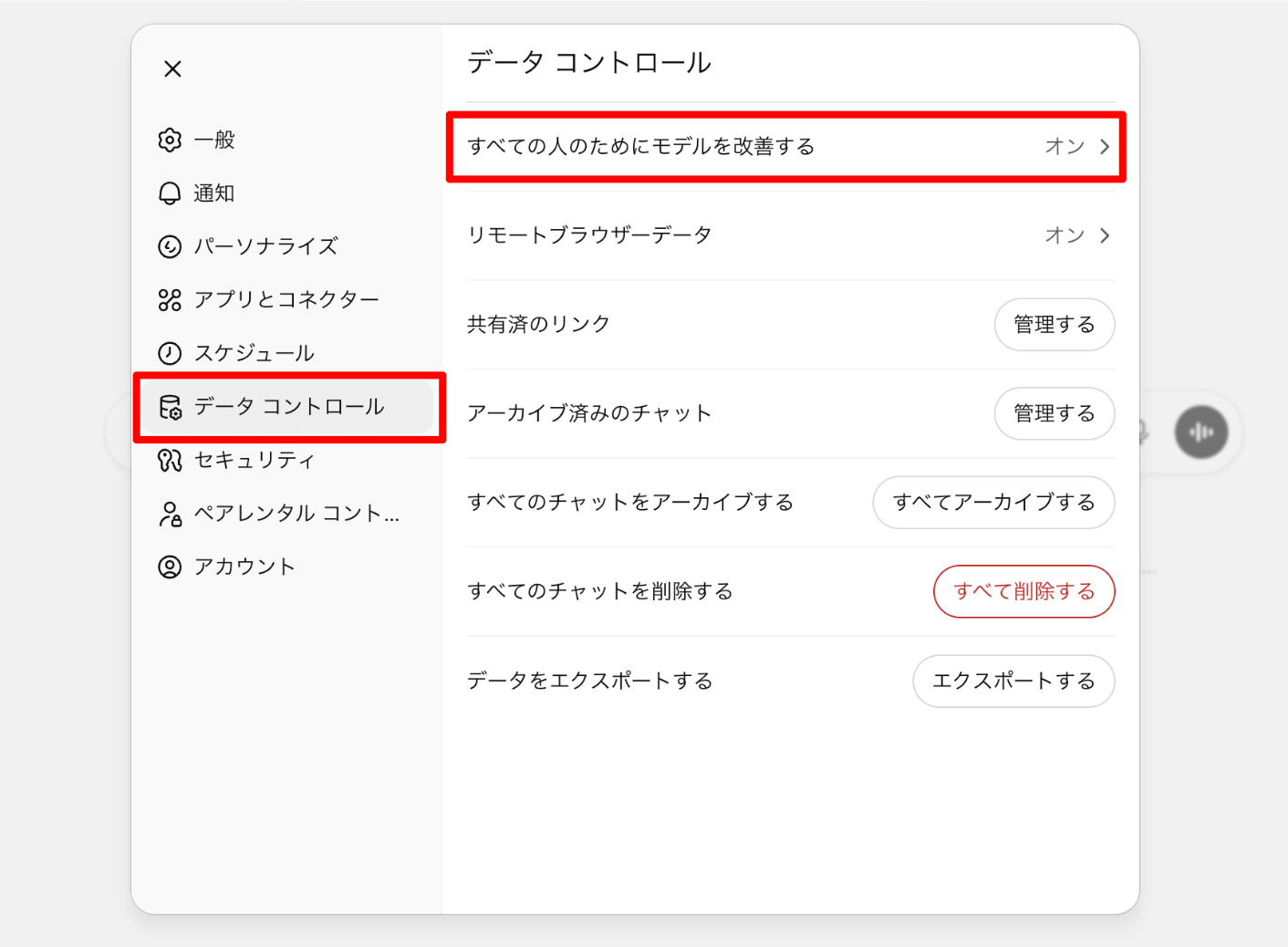

まずは、ChatGPTの設定画面から学習させないための設定について、ステップごとに解説していきます。

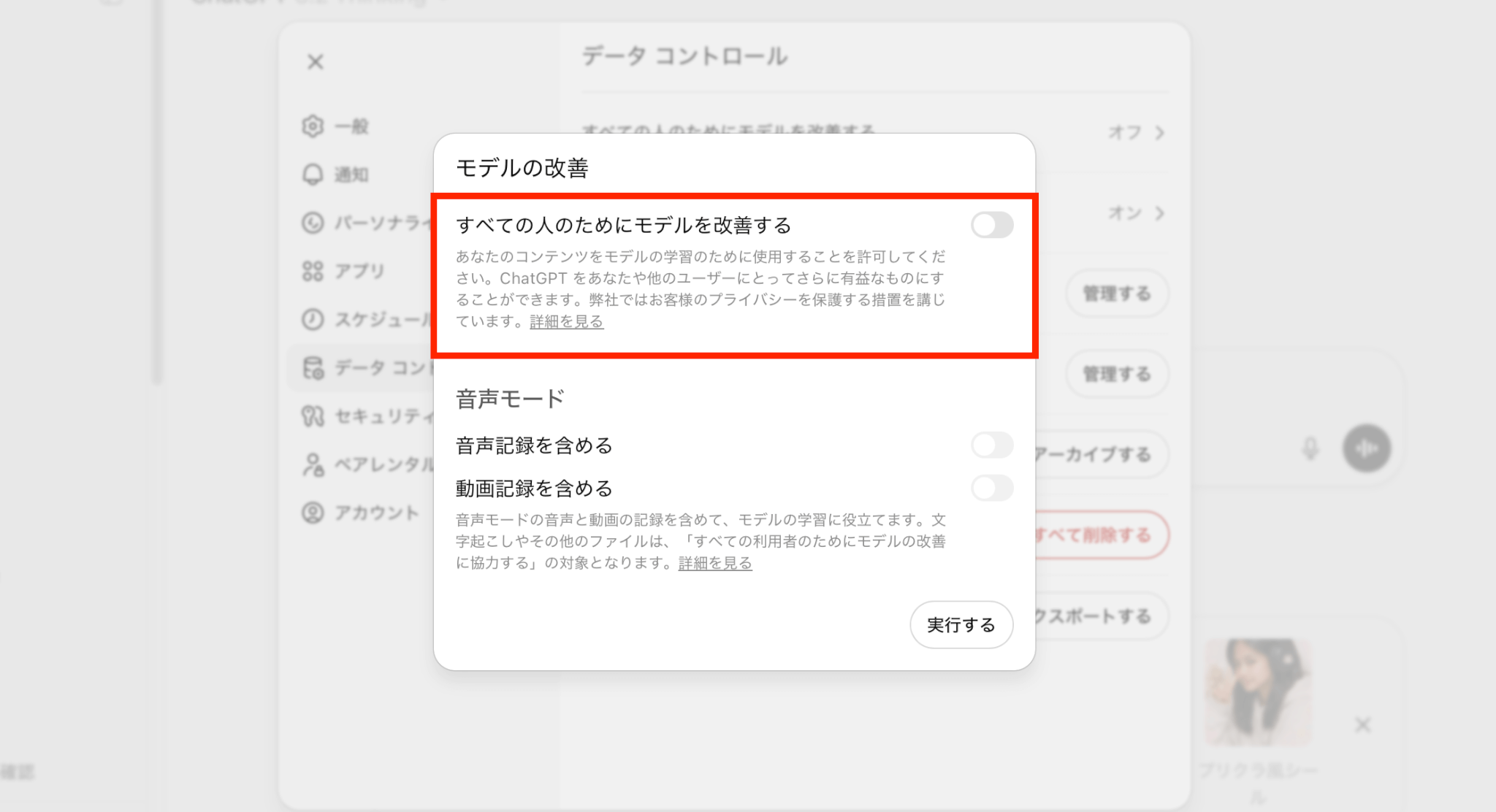

「データコントロール(Data Controls)」から「全ての人のためにモデルを改善する(Improve the model for everyone)」を選択します。

「すべての人のためにモデルを改善する」のボタンをOFFにして、「実行する」をクリックすることで、学習させない設定にできます。

また音声データについても、「音声記録」「動画記録」のそれぞれモデル学習のためにデータを提供するかどうかを選択できます。

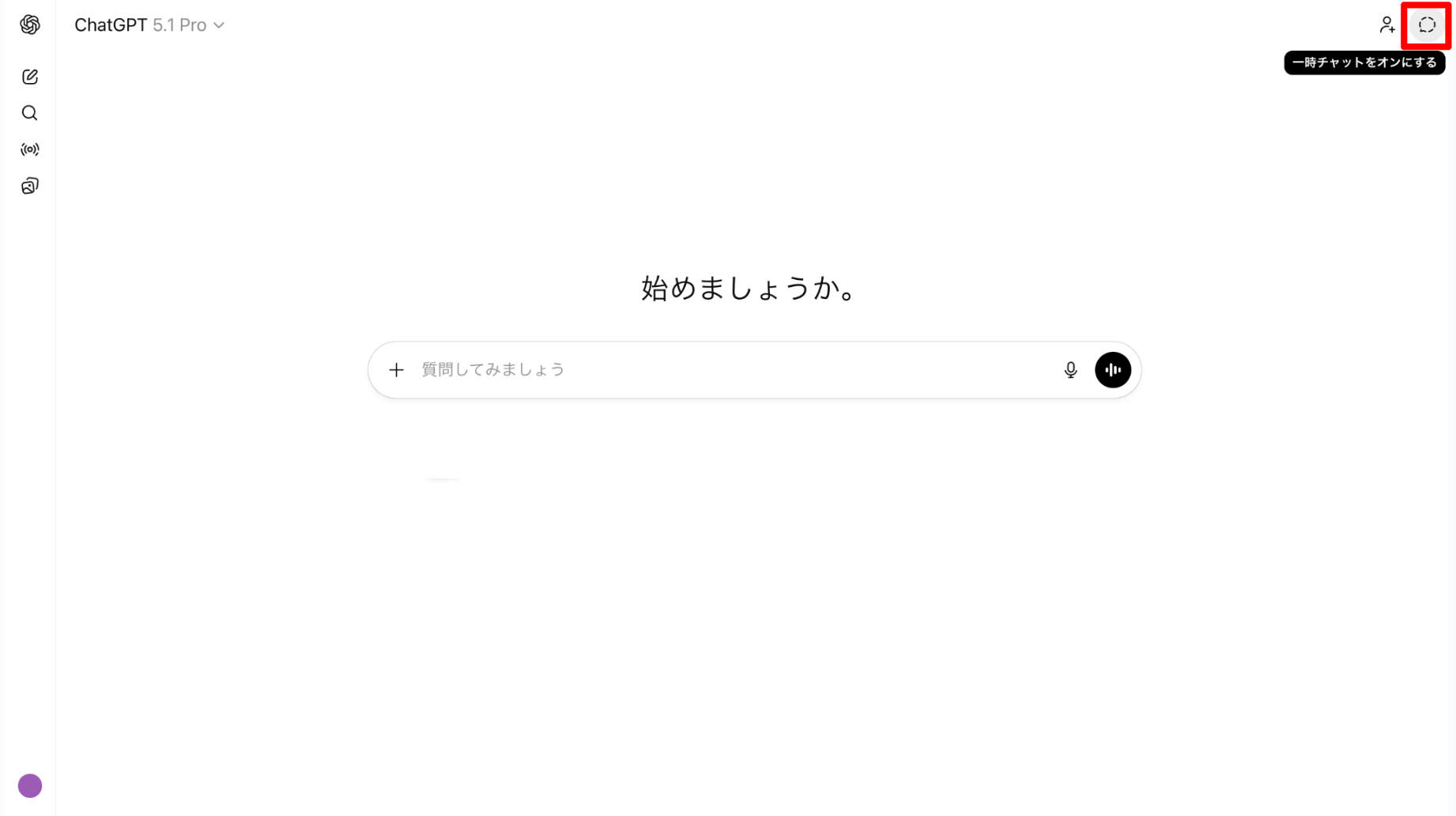

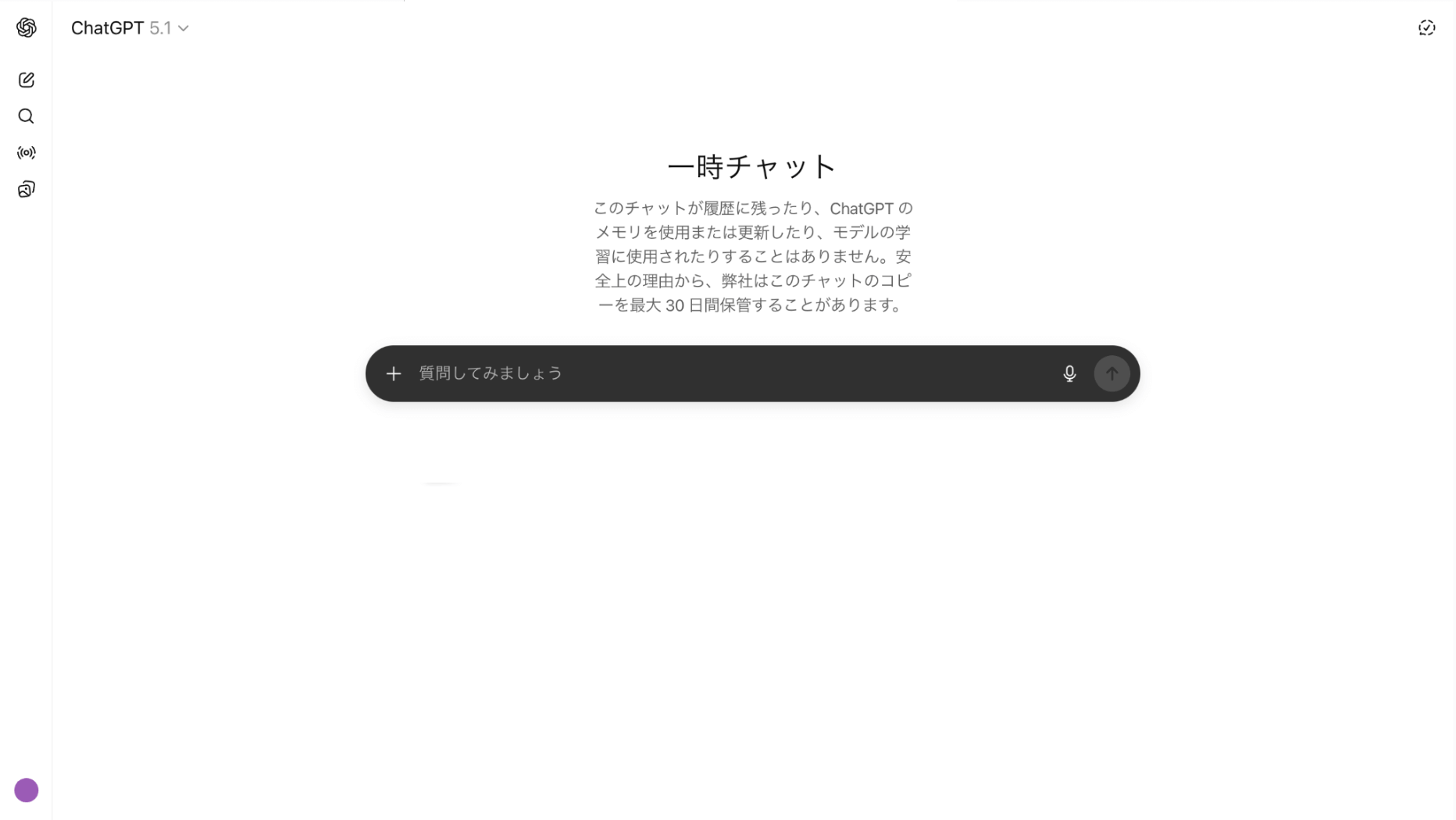

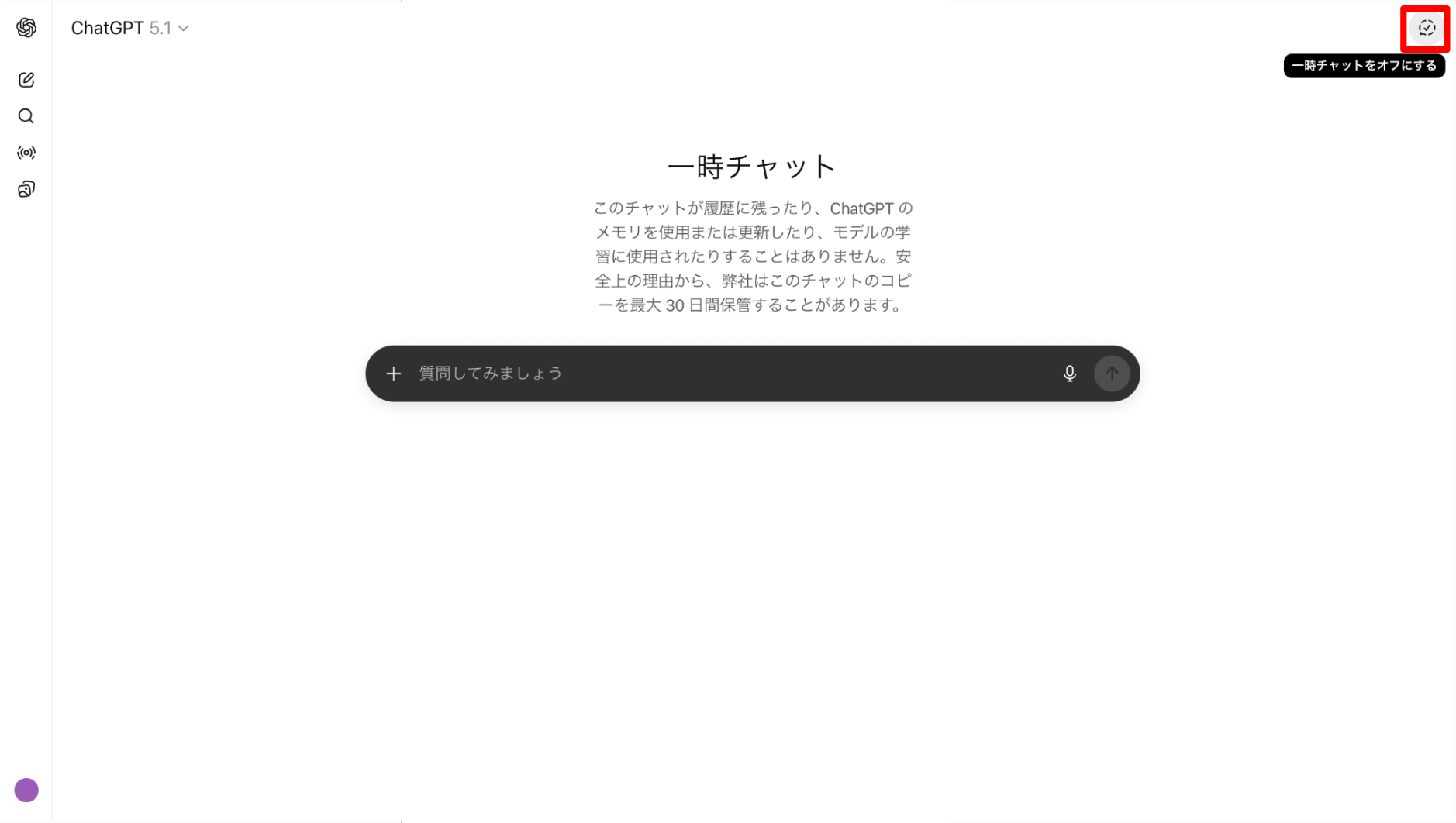

履歴も残さない「一時チャット」を使う

もし、「学習させたくない」だけでなく「チャット履歴自体も画面に残したくない」という場合は、一時チャット機能を利用するのが最適です。

通常の設定では履歴が残りますが、一時チャットはブラウザのシークレットモードのようなもので、このモードで会話を行うと履歴には一切保存されず、モデルの学習にも使用されません。

- サイドバーの履歴に会話が表示されない

- 入力データはモデルの学習に使われない

- 次回以降の会話に影響する「メモリ」も作成されない

- 原則、会話ログはセキュリティ目的で最大30日間保持されたのち削除される

具体的な設定手順は以下の通りです。

プライバシーリクエストからオプトアウトの申請をする

先ほどの学習させない設定よりも、さらに確実にChatGPTでのデータ学習を停止させたい場合は、OpenAIの公式サイトからプライバシーリクエストを提出する方法があります。

この方法では、オプトアウトの設定を申請することで、データがChatGPTのモデル学習に利用されることを防げます。

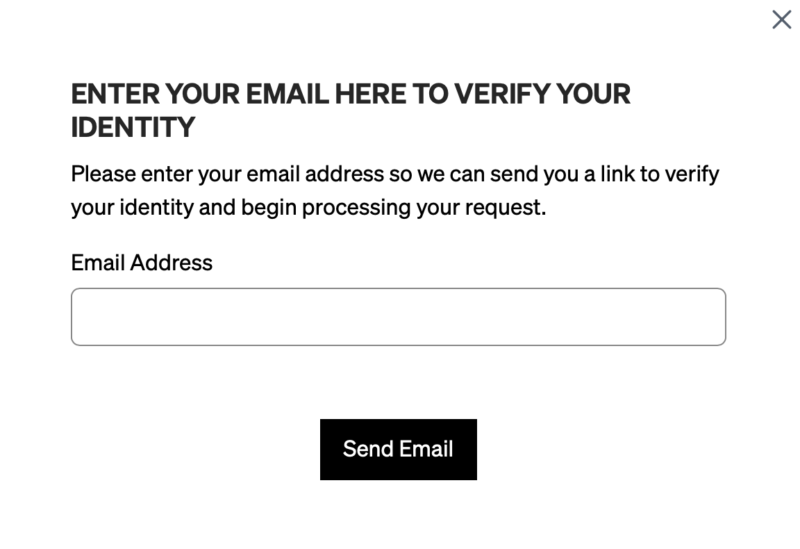

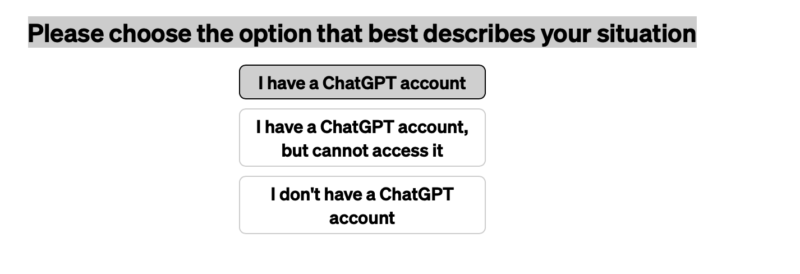

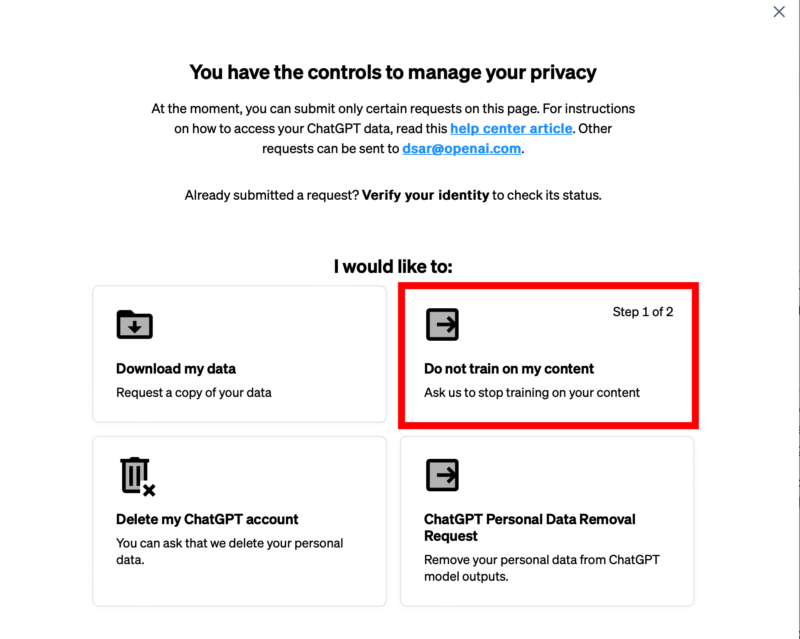

画面右上の「Make a Privacy Request」を押下すると、下記画面が表示されるので自身の状態に合ったものを選択してください。

Please choose the option that best describes your situation(あなたの適切な状況を選択してください)

・I have a ChatGPT account(ChatGPTのアカウントを持っています。)

・I have a ChatGPT account, but cannot access it(ChatGPTのアカウントは持っていますが、アクセスできません)

・I don’t have a ChatGPT account(ChatGPTのアカウントを持っていません。)

状況を選択すると以下の画面が表示されるので、「Do not train on my content(私のコンテンツを学習に使用しないでください)」を選択してください。

受信したメールのログインボタンからログインし、居住地の入力と同意を行うと「You Do not train on my content request is complete」というメールが届きます。

こちらでChatGPTのオプトアウト設定が完了となります。

ただし、今後のコンテンツに対して適用され、すでに学習に用いられたデータがモデルから削除されない点に留意しましょう。

ChatGPTでオプトアウトして学習させないメリット

ChatGPTのような生成系AIにおいては、入力されたデータがAIの学習に利用されるため、ユーザーのプライバシーやセキュリティに対する懸念が高まっています。

これに対処するために、OpenAIはユーザーに対してオプトアウト機能を提供していますが、具体的にChatGPTでオプトアウトして学習させないメリットとしてはどのようなものがあるのかについて詳しく説明していきます。

情報漏洩のリスクを軽減

オプトアウト設定することでChatGPTに入力した情報がAIの学習に利用されることがなくなるため、個人情報や企業の機密情報が他のユーザーの回答に含まれてしまう可能性が減り、情報漏洩のリスクが小さくできます。

企業が内部の会議で使用した議事録や顧客とのやり取りで発生する重要な情報が、第三者に知られる心配がなくなる点にメリットがあるといえます。

また、業界においては規制や法律の遵守が求められる場面も多く、その際にオプトアウト設定を行うこともセキュリティ的に有効な対策となるでしょう。

回答の精度を維持できる

オプトアウト設定を行うことで、ChatGPTが不正確な情報や誤ったデータ、嘘の情報を学習してしまうなどの問題を防げる場合があります。

例えば、初心者ユーザーが誤って入力した情報が記録されてしまうと、次回以降の回答がその誤った情報に基づいて出力される可能性があり、満足のいく回答が得られるどころか嘘の情報が提示されてしまう可能性があります。

オプトアウト設定を行えば、こうした誤った情報が蓄積されることを防げるため、回答の精度を保ちたい場合におすすめです。

ただし、オプトアウト設定を行う前に入力したデータについては、保存されているため注意が必要です。あくまでも「オプトアウト以降の会話を学習に使わない」設定である点を念頭におきましょう。

ChatGPTでオプトアウトして学習させないデメリット

一方で、ChatGPTのオプトアウト機能を利用することには、いくつかのデメリットもあります。

ここではそのデメリットについてそれぞれの項目で解説していきます。

回答精度の向上が見込めない

ChatGPTは、ユーザーが入力した様々な情報を学習することで回答の質を向上させる仕組みになっています。しかし、オプトアウト設定することで、ユーザー情報やデータが蓄積・反映されないため、AIならではの「利用するたびに精度が良くなっていく」ことが見込めません。

その結果、同じ質問をしたとしても、以前よりも抽象的になってしまったりあまり正確ではない回答となってしまったりする可能性があります。

例えば、業界でよく使われているような用語や社内のルールなどを学習させたい場合でも、オプトアウト設定をしてしまうと、その情報が蓄積されていかないため満足のいく回答を得られない場合があります。

間違った情報を入力してしまうような初心者ユーザーと利用に慣れているユーザーとでは、オプトアウト設定の必要性についても意見が分かれてくるため、ご自身に合った設定をするように心がけましょう。

過去のチャット履歴を確認できなくなる(一時チャット使用時)

設定からオプトアウト設定を行った場合は履歴が残りますが、より機密性を重視して一時チャット機能を利用した場合は、チャットの履歴が保存されません。

そのため、ブラウザを閉じたり画面を更新したりすると、過去にどのようなやり取りを行ったかを後から確認することが一切できなくなります。

例えば、契約書のレビューや長文の作成など、後から「あの時の回答をもう一度見たい」と思うような作業で一時チャットを使ってしまうと、再確認ができず業務に支障が出る恐れがあります。

「履歴を残して学習だけ拒否する」のか、「履歴ごと残さない」のか、状況に応じて「通常のオプトアウト設定」と「一時チャット」を使い分けるようにしましょう。

情報漏洩のリスクが完全には排除されない

オプトアウトすることでデータがAIの学習に使われなくなりますが、これだけでは情報漏洩のリスクが完全に排除されるわけではありません。

例えばシステムに何らかの脆弱性があった場合、オプトアウトの設定がされていてもデータが漏洩する可能性があります。

また、OpenAIのポリシーによりオプトアウトしても一定期間は会話の履歴が保持されるため、情報が完全に削除されるまでの間にリスクが存在することも考えられます。

一時チャットを使用した場合についても同様に情報漏洩のリスクは完全に排除されません。

このため、オプトアウト設定や一時チャットを使用しても絶対的な安全性を保証するものではないという点に注意が必要です。

企業がChatGPTで情報漏洩させないためにオプトアウト以外の有効手段

オプトアウト機能は確かに情報漏洩対策に有効ですが、それだけでは十分とは言えません。

企業はさらに多層的な対策を講じることで、情報漏洩リスクを最小限に抑えることができます。

ここでは、オプトアウト以外の有効な手段として、機密情報の扱い方、セキュリティシステムの活用、ガイドラインの設定などの具体的な対策を紹介してきます。

機密情報を入力しない工夫とAPI版の活用

最も基本的な対策として、機密情報をChatGPTに入力しないことです。

入力した情報が他のユーザーの回答に反映される可能性があるため、機密性の高い情報はプロンプトに入力しないように徹底する必要があります。

業務で機密情報を扱う必要がある場合は、個人プランではなくBusiness / Enterpriseなどの法人向けプラン、あるいはAPI版を活用しましょう。 これらの法人向けサービスでは、入力データがモデルの学習に使われないことが規約で保証されているため、社外に情報が漏れるリスクを大幅に低減しながら安全にAIを活用することが可能です。

デフォルトでは、ChatGPT Enterprise、ChatGPT Edu、ChatGPT Business、ChatGPT for Teachers、そして当社 API プラットフォームのビジネスデータ(入力と出力を含む)は、モデルの学習や改善には使用されません。

出典:ビジネスデータのプライバシー、セキュリティ、コンプライアンス-Open AI

また、API版では企業の独自データを学習させることができ、他のユーザーが利用するChatGPTに影響を与えることなく安全に活用することが可能なため、機密情報が外部に漏れるリスクを低減できます。

セキュリティシステムの導入による自動防御

セキュリティシステムの導入も有効な対策です。

特にDLP(Data Loss Prevention)システムは、重要なデータや機密情報を自動的に特定したり、持ち出しが疑われる場合にはアラートを発したり、操作をブロックしたりする機能を持っています。

このシステムを導入することで、従業員がうっかり機密情報をChatGPTに入力してしまった場合でも送信がブロックされ、情報漏洩を防ぐことができます。

さらに、Microsoftの「Azure OpenAI Service」を利用することで、企業はしっかりとしたセキュリティ環境下でChatGPTを使用でき、外部からの不正アクセスを制限することが可能です。

ガイドラインの設定と従業員教育

企業がChatGPTを安全に利用するためには、明確なガイドラインの設定も必要です。

ガイドラインには、どのような情報を入力すべきか、どのような場面でChatGPTを使用すべきか、または利用を避けるべき状況など、具体的なルールを定める必要があります。

例えば、機密情報や個人情報を入力する際の注意点や使用後のデータ処理方法についても詳細に記載することで、従業員が適切に利用できるようになります。

まとめ

企業がChatGPTを安全に利用するためには、オプトアウト設定だけでなく多層的な対策が求められます。

機密情報を直接入力しない工夫やBusiness / Enterpriseなどの法人向けプランの使用、API版の活用によるセキュリティ強化が基本ですが、DLPシステムやAzure OpenAI Serviceの導入による自動防御も情報漏洩のリスクを大幅に軽減できます。

さらに、明確なガイドラインの設定と従業員教育によって、全社的に安全なAI利用を推進することも重要です。

AIを利用して業務を効率化させるためにも、しっかりとしたセキュリティ対策を講じるようにしましょう。