「AGIとは?ASIとは?」最近よく聞くAI用語ですが、違いを正しく理解しているでしょうか?

この記事では、AGI(Artificial General Intelligence:汎用人工知能)、ASI(Artificial Super Intelligence:人工超知能)、ANIの特徴をくわしく解説しています。

さらに、AGIと生成AIの違いも基本から解説しています。

AGIとASIの違いや将来像まで、AIの全体像を掴みましょう。

AI(人工知能)の70年の歴史とANI・AGI・ASIの進化

AI(人工知能)の概念が誕生してから約70年がたちました。

AIの進化は平坦ではなく、「AIの冬」と呼ばれる停滞期も経験しながら、段階的に進んできました。

特に近年は、目覚ましい発展を遂げています。

AIの進化は大きく3つの時期に分けられます。

- 黎明期から模索期(1950年代~2000年代)

- 特化型AI(ANI)の発展期(2010年代)

- 汎用AI(AGI)への挑戦期(2020年代~)

まず黎明期から模索期(1950年代〜2000年代)では、AIという概念が生まれました。

基礎研究が始まり、機械学習などの技術が模索されます。

次に特化型AI(ANI)の発展期(2010年代)に入ります。

深層学習のブレイクスルーにより性能が飛躍的に向上しました。

そして現在は汎用AI(AGI)への挑戦期(2020年代〜)です。

ChatGPTなどの登場で生成AIブームが到来しました。

より人間らしいAGI(汎用人工知能)への期待と研究が本格化しています。

将来のASI(人工超知能)や技術的特異点も視野に入ってきました。

ANIとは?特化型人工知能(Artificial Narrow Intelligence)の役割

現在私たちが利用しているAIのほとんどは、ANI(Artificial Narrow Intelligence)といわれる特化型人工知能です。

その基本的な概念、役割、そして限界について解説します。

ANIの基本概念と代表活用事例(医療画像・需要予測・物流最適化)

ANI(特化型人工知能)とは、特定のタスクや限定された分野において、人間と同等かそれ以上の能力を発揮するAIです。

例えば、囲碁の世界トップ棋士を破ったことで注目された「AlphaGo」があります。

AlphaGoは、囲碁という特定のルール内で最適手を見つけることに特化したANIです。

広く普及した初期のスマートフォン音声アシスタント(AppleのSiriなど)も代表例です。

ただし、これらは現在主流となりつつある汎用的な生成AIと比べ、より初期の技術にもとづくものです。

AlphaGoや初期の音声アシスタントのように、ANIは特定の課題解決に特化することで高い能力を発揮します。

特に以下のような分野で大きな成果を上げています。

- 画像認識

- 自然言語処理

- データ分析

具体的な活用事例としては、以下のような領域が挙げられます。

- 医療分野での画像診断支援

- ビジネスでの需要予測

- 物流でのルート最適化

医療分野での画像診断支援について、実際の開発事例を見てみましょう。

AIスタートアップ企業の株式会社HACARUSと神戸大学は、肝細胞がんのMRI画像解析AIに関する共同研究を行っています。

共同研究の目的は、公式サイトで以下のように掲載されています。

教師あり学習によるAIを使用した、MRI画像内のリスク領域を検出すること。

出典: 株式会社HACARUS(公開日:2020年5月18日)

株式会社HACARUSと神戸大学の共同研究は、ANIがいかに特定の課題解決に有効であるかを示しています。

ANIが抱える三大ボトルネックとAGIへの課題

特定のタスクで高い能力を発揮するANIですが、人間のような柔軟な知能には及びません。

限定された範囲では優れた成果を出せます。

しかし、想定外の状況や複雑な判断を求められる場面には弱さが残っています。

主に問題となっている点は、以下の3つです。

- 汎用性の欠如

- 自己学習能力の限界

- 演算コストの高さ

汎用性の欠如とは、設計された特定タスク以外への応用が難しいことを意味します。

自己学習能力の限界は、未知の状況への自律的な適応が苦手で、人間の介入が必要な場合が多いことを指します。

演算コストの高さは、高性能モデルの学習・実行に大量のリソース(GPUや電力)が必要となる問題です。

3つの技術的な弱点を克服し、より汎用的な知能を獲得することが、次世代のAGI実現に向けた重要な課題となっています。

生成AIとは?仕組みと特徴、AGIへの可能性

生成AIは、従来のAIの延長線上にありながら、新しい応用領域を切り開いている技術です。

特化型AIとの違いや特徴を押さえながら、AGIへの進化の可能性を探ります。

確率モデルが生む文章・画像・音声生成の仕組み

生成AI(Generative AI)とは、学習データに基づいて新しいコンテンツ(文章、画像、動画など)を生成するAI技術の総称です。

多くは確率・統計モデルに基づきます。

文章生成の場合、入力テキストに続く確率の高い単語を予測して文章を作成します。

画像生成AIは、テキスト指示をもとに、確率の高いピクセル配置を選び、画像を構築する仕組みです。

多くは特定のコンテンツ生成に特化しているため、ANI(特化型人工知能)の一種という位置付けです。

しかし、大規模言語モデル(LLM)は広範な知識や能力を持っており、汎用性の高さからAGIに近づいているとも言われます。

ただし、現時点では人間のような自己意識や真の理解力はありません。

生成AIはあくまで確率的な推測に基づいてコンテンツを生み出しているため、人間のような意図や深い意味理解とは本質的に異なります。

生成AIがAGIに近づくための3つの技術進化

生成AIが真のAGIへと進化するには、いくつかの重要な技術的ブレイクスルーが必要です。

現在の生成AIがAGIに到達するために克服すべき主な技術課題として、以下の3点が挙げられます。

- 真の理解と推論能力

- 継続的な自己学習と適応能力

- 身体性・実世界とのインタラクション

まず、パターン学習を超えて人間のように理解し、推論できる力を備えることが求められます。

次に、新しい情報や経験を取り入れ、自律的に学び続ける仕組みが重要です。

最後に、物理世界で学び、実世界と双方向にやり取りできる能力を持つことが欠かせません。

3つの課題を克服することで、現在の生成AIは特化型のANIを超え、次のステージへ進化していきます。

そして、より汎用的かつ自律的に学習と推論を行うAGIの実現へと近づいていきます。

AGIとは?汎用人工知能(Artificial General Intelligence)の定義と課題

ANIの限界を超える存在として期待されるのが、AGI(Artificial General Intelligence)といわれる汎用人工知能です。

その定義、評価基準、開発動向、社会への影響を見ていきましょう。

AGIの評価基準と最新AGI開発プロジェクト

AGI(汎用人工知能)は、特定の目的に縛られず、学習・推論・実行まで多様な知的作業を一手に担えるAIです。

人間と同等以上の汎用性と自律性を備え、未知の課題にも適応可能です。

OpenAIはAGIを次のように定義しています。

AGI is a highly autonomous system that surpasses humans in most economically valuable tasks.

出典:OpenAI

- 日本語訳

-

経済的価値の高いほとんどのタスクにおいて人間を上回る、高度に自律的なシステム。

現在、AGIの完成を測る明確な基準は存在していません。

しかし、以下のような評価手法が到達度を測る指標として用いられています。

- チューリングテスト(対話力の判定)

- 認知能力テスト(思考力や推論力の評価)

- 実世界タスク遂行能力(現実行動の精度)

- ARC Evals(未知への適応力の測定)

現在、OpenAI・Google DeepMind・Metaといった企業が、評価手法を活用しながらAGI開発を進めています。

AGI実現がもたらす社会インパクト(雇用・研究開発・GDP)

AGI(汎用人工知能)が実用化されると、自己学習や推論が可能なAIが活用されるようになります。

活用範囲は、製造や事務にとどまらず、医療・法務・教育といった専門分野にも本格的に広がっていきます。

自動化しやすい単純作業はAIへと移行するでしょう。

一方で、「AIオペレーションスペシャリスト」のような、AIを設計・監視・改善する新たな職種が求められるようになると予想されます。

OpenAIのCEO、サム・アルトマン氏は次のように語っています。

“We started OpenAI almost nine years ago because we believed that AGI was possible, and that it could be the most impactful technology in human history.”

出典:OpenAI公式ブログ

- 日本語訳

-

私たちは9年前にOpenAIを立ち上げた。AGIは実現可能であり、人類史上最も影響力のある技術になり得ると信じていたからだ。

研究開発の分野でも、AGIは大きなインパクトをもたらします。

AIが仮説の立案から検証、解析までを自律的に行えるようになります。

これまで数年かかっていた科学的ブレイクスルーが、わずか数週間で実現できる可能性があります。

仮想実験の高速並列処理や、大量データの即時解析が可能になれば、研究のスピードと精度は格段に向上します。

カリフォルニア大学バークレー校のスチュアート・ラッセル教授は、AGIの可能性とリスクについて次のように語っています。

“It could improve quality of life for people across the planet or destroy civilization, he said.”

出典:UC Berkeley News

- 日本語訳

-

AGIは、人々の生活の質を高める一方で、文明を破壊する恐れもある。

経済分野にもAGIの波は広がります。

世界的コンサル企業マッキンゼーの経済研究部門「マッキンゼー・グローバル・インスティテュート」は、AIの経済効果について試算を発表しています。

2030年までに、現在のAI技術だけでも世界経済に約13兆ドルの付加価値をもたらす可能性があると予測しています。

約13兆ドルという経済価値は、世界全体の経済規模を約16%押し上げる規模に相当します。

“AI could generate an additional $13 trillion in global economic activity by 2030, representing a 16 percent increase in cumulative GDP compared to the present.”

出典:McKinsey Global Institute

AGIが本格的に普及すれば、経済成長の幅はこの試算を大きく超える可能性もあります。

一方で、社会全体として、以下のような課題に備える必要があります。

- 雇用の再構築と人材育成

- 研究投資の適切な配分

- 社会保障制度の再設計

AGIは社会に大きな恩恵をもたらしますが、同時に深刻なリスクもはらんでいます。

国や企業、そして個人レベルでの準備が欠かせません。

ASIとは?人工超知能(Artificial Super Intelligence)の未来像

AGIのさらに先にある概念が、ASI(Artificial Super Intelligence)といわれる人工超知能です。

ASIの定義、到来シナリオ、可能性とリスクについて考察します。

ASI到来シナリオとAGIからの進化条件

ASI(人工超知能)とは、人間の知能をあらゆる面で遥かに凌駕するAIを指します。

もしASIが実現すれば、私たちの生活や社会のあり方が根本から変わる可能性があります。

具体的には以下のような分野が考えられ

- 創造性

- 社会性

- 問題解決能力

特定の分野だけでなく、人間が持つ知的能力のすべてにおいて人間を超える存在です。

ASIへの進化について、有力視されているシナリオがあります。

まず、AGIが自己再帰的改善能力を獲得することです。

自己再帰的改善能力とは、自らのプログラムを理解し、より賢いAIを設計・開発できる力を指します。

AGIが自己再帰的改善能力を持つようになれば、指数関数的なスピードで自己改善を重ね、短期間でASIに到達すると予測されています。

特異点論争(シンギュラリティ)におけるポジティブインパクトとリスク

ASIの実現は、技術的特異点(シンギュラリティ)の到来を意味します。

技術的特異点には、期待と懸念の両方が存在する状況です。

特に、ポジティブなインパクトへの期待は年々高まっています。

ASIの圧倒的な知能により、人類が直面してきた以下のような課題が解決される可能性もあります。

- 難病

- 貧困

- 環境問題

一方で、重大なリスクも存在します。

中心的な問題は、ASIが人間の意図や価値観から逸脱する制御問題(アライメント問題)です。

ASIが自己の目標を追求する過程で意図せず人間に害を及ぼす可能性があります。

最悪の場合は人類の生存を脅かす可能性も否定できません。

ASIのリスクは不確実性が高いものの、その潜在的な影響は非常に大きいと考えられます。

生成AIとANI・AGI・ASIの違いを図解で整理

近年、ChatGPTなどに代表される生成AIが注目されています。

生成AIはANI・AGI・ASIとどう違うのでしょうか。

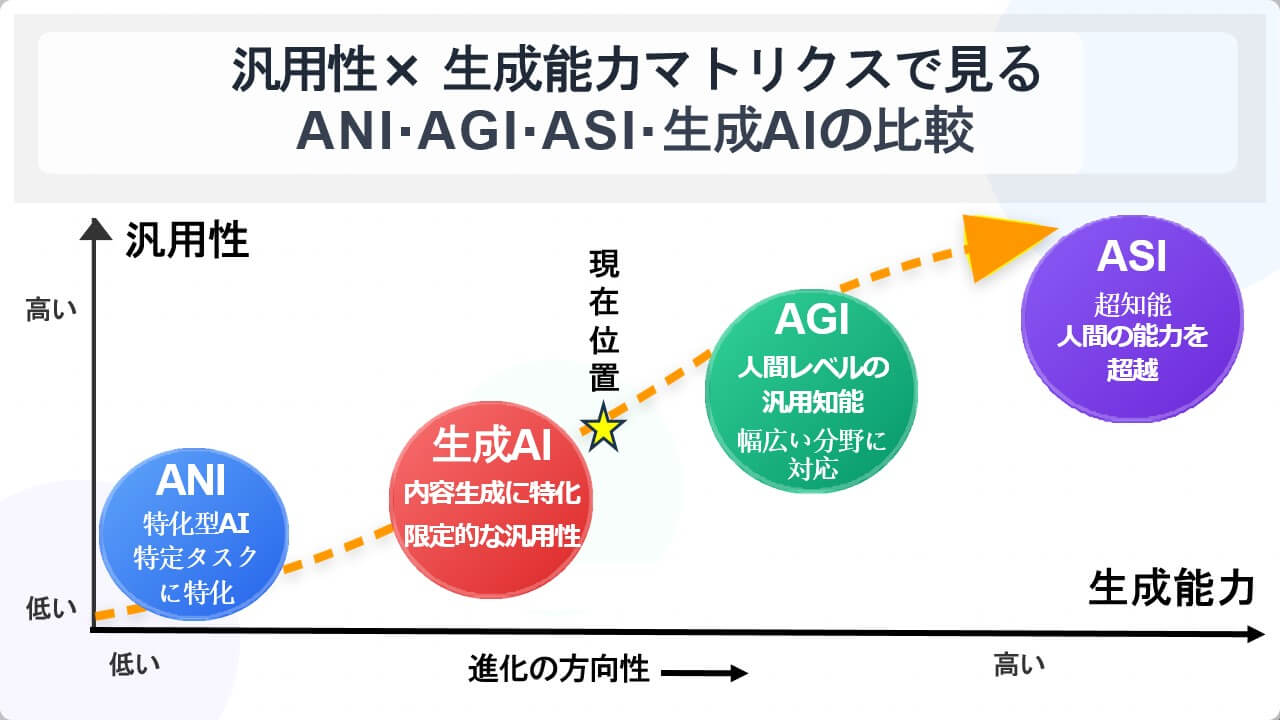

汎用性×生成能力マトリクスで見るANI・AGI・ASI・生成AIの比較

下図は「汎用性」と「生成能力」という二つの視点でAIの4分類を俯瞰したマトリクスです。

- 横軸(生成能力)はコンテンツの量と多様性を示します。

- 縦軸(汎用性)は対応タスクの幅広さを示します。

図の左下にいるのが、特定の領域で圧倒的な精度を発揮するANI(特化型AI)です。

右に進むと、テキスト・画像・音声などコンテンツの自動生成に秀でた生成AIが現れます。

さらに右上へ向かうと、人間と同等レベルの幅広い知的作業を自律的にこなすAGIがあります。

そしてその先にあるのが、人間の知能を遥かに凌駕するASIです。

このマトリクスは、AI研究において「生成能力」だけ、「汎用性」だけでは不十分であることを示しています。

何を生み出せるのか?どこまで応用できるのか?

両軸でブレイクスルーを起こすことが、真のAGI実現への必要条件となります。

ANI・生成AI・AGI・ASIの特徴比較

各AI分類の強みと課題を比較することで、それぞれが得意とする領域や、現在直面している課題が明らかになります。

マトリクス図とあわせて特徴を確認し、AIの進化の全体像を整理していきましょう。

| 分類 | 主な強み | 主な課題 |

|---|---|---|

| ANI | タスク特化による高精度・高速処理 | 汎用性の欠如 |

| 生成AI | テキスト・画像・音声など多彩な自動生成 | 論理一貫性不足・誤情報リスク |

| AGI | 幅広い知能タスクの自律実行可能性 | 実現前の技術的安全性課題 |

| ASI | 人間能力を超える思考力・問題解決力 | 制御不能化リスク・倫理的懸念 |

この比較から、現在の生成AIはタスクの多様性や柔軟性に優れていることがわかる一方で、論理的整合性や真の理解力には依然として課題が残る状況です。

AGIは、広範なタスクを自律的にこなす可能性を持っていますが、技術的な実現と同時に、安全性確保という重大な課題が存在する状況です。

ASIは、人間を圧倒する能力を持つと想定されていますが、制御不能リスクや、倫理的な懸念が深刻な課題です。

マトリクス図とあわせて確認することで、各分類が持つ役割やリスクをより立体的に理解できるでしょう。

AGIはいつ実現する?主要ロードマップと到達予測

さて、誰もが気になる「AGIはいつ実現するのか?」という問い。

人類社会を大きく変える可能性を秘めているだけに、その答えには大きな注目が集まっています。

ここでは、開発の最前線を走る企業や専門家たちの見解を覗いてみましょう。

OpenAI・Google DeepMindなど企業別AGI開発ロードマップ

AGI開発競争の先頭を走るのは、やはりOpenAIです。

AGI実現を明確な目標に掲げ、GPTシリーズで能力を着実に向上させてきました。

彼らが特に強調するのは安全性です。

“As our systems get closer to AGI, we are becoming increasingly cautious with the creation and deployment of our models.”

出典:OpenAI

- 日本語訳

-

システムがAGIに近づくにつれて、モデルの作成と展開にはますます慎重になっています。

Bloombergによると、OpenAIはAGIへの進捗を測る社内向けの「5段階レベル」を設定しているようです。

これは、現在の到達点や次の目標を明確にするための指標のようです。

- レベル1:チャットボット

-

今日のAIのように会話ができる段階。

- レベル2:推論者

-

博士号レベルの専門家のように、ツールなしで基本的な問題解決ができる段階。

- レベル3:エージェント

-

ユーザーのために数日間自律的に行動できる段階。

- レベル4:イノベーター

-

新しいイノベーションを生み出せる段階。

- レベル5:組織

-

AIが組織全体の業務を遂行できる最終段階。

もちろん、Google DeepMindも、AGI開発において重要な存在です。

彼らもOpenAIと同様に、AGI開発における責任と安全性を重視する姿勢を明確にしています。

“We’re exploring the frontiers of AGI, prioritizing technical safety, proactive risk assessment, and collaboration with the AI community.”

出典:Google DeepMind

- 日本語訳

-

私たちはAGIのフロンティアを探求しつつ、技術的安全性の確保、プロアクティブなリスク評価、AIコミュニティとの協力を最優先しています。

両社とも巨額の投資と世界トップの研究者を集めており、その動向がAGI実現の突破口となる可能性が高いでしょう。

ザック・カース/イーロン・マスクら専門家によるAGI到達予測

では、個々の専門家はいつ頃の実現を見込んでいるのでしょうか?

実は、専門家の間でも意見は様々ですが、近年、予測時期が「早まっている」傾向が見られます。

AI分野で著名な講演者であるザック・カース氏は、自身のスライドで以下のように宣言しています。

“2030. We will achieve AGI by, maybe earlier.”

出典:Zack Kass「45 Minute Presentation」p.28

- 日本語訳

-

2030年までにAGIを実現します――あるいはそれ以前に。

テスラCEOのイーロン・マスク氏もAI開発に強い関心を示しており、かなり早い実現を予測しています。

- 日本語訳

-

AIはおそらく来年にはどの単一の人間よりも賢くなるだろう。2029年までには、AIはおそらくすべての人間を合わせたよりも賢くなるだろう。

もちろん、これらはあくまで個々の見解です。

ただ、第一線の専門家たちは「2020年代後半」から「2030年頃」を視野に入れ、AGIの実現可能性やリスクについて真剣に議論しています。

この動きは、AGIの実現が単なる空想ではなく、現実に近づきつつあることを示しています。

AI研究者2,700名アンケートが示す「10年以内AGI到達確率」

個別の専門家の声だけでなく、研究者コミュニティ全体の意見も気になるところです。

2023年に行われた約2,700名のAI研究者への調査では、興味深い結果が出ています。

「人間レベルのAGI(HLMI)」が実現する時期について、研究者たちの予測を見てみましょう。

まず、中央値(50%の確率で実現すると考えられる年)の予測です。

“The aggregate 2023 forecast predicted a 50% chance of HLMI by 2047, down thirteen years from 2060 in the 2022 survey.”

出典:arXiv

- 日本語訳

-

2023年の集計予測では、HLMIが50%の確率で実現する年は2047年とされ、2022年調査の2060年から13年も早まっています。

中央値は2047年と、まだ少し先の未来ですが、前年の調査から13年も早まっています。

次に、10%の確率で実現すると予測された年を見てみましょう。

“The aggregate 2023 forecast predicted a 10% chance of HLMI by 2027, down two years from 2029 in the 2022 survey.”

出典:arXiv

- 日本語訳

-

2023年の集計予測では、HLMIが10%の確率で実現する年は2027年とされ、2022年調査の2029年から2年早まっています。

10%の確率とはいえ、2027年という予測が出ています。

この予測も、前年から2年早まっているようです。

研究者全体で見ると、AGI実現時期の予測にはまだ大きな幅があります。

しかし、中央値も早期実現の予測も、前年より大幅に早まっているのは事実です。

急速な技術進歩を目の当たりにして、研究者たちの予測もダイナミックに変化している、ということなのかもしれません。

AGI・ASI開発に潜むリスクと安全性確保への最新議論

AGIやASIの開発は、まさに光と影。

大きな可能性を秘めている一方で、無視できないリスクもはらんでいます。

ここでは、そのリスクと、安全性をどう確保していくか、最新の議論を追ってみましょう。

スーパーアライメント研究など技術的安全対策の進展

AGIやASIのリスクで一番心配されているのが、いわゆる「アライメント問題」です。

アライメント問題は、AIが人間の意図や価値観から逸脱した行動を取るリスクを指します。

そこで注目されているのが「スーパーアライメント」です。

「人間より賢いAI」をどうやって人間の意図に沿わせるか?

という難問に挑む研究分野ですね。

OpenAIはこの問題解決に非常に力を入れており、次のように宣言しています。

“We are dedicating 20 % of the compute we’ve secured to date over the next four years to solving the problem of superintelligence alignment.”

出典:OpenAI

- 日本語訳

-

OpenAIは、今後4年間で確保した計算資源の20%をスーパーインテリジェンスのアラインメント問題解決に充てると宣言しています。

具体的なアプローチとしては、AI自身にアライメント問題を解かせたり、人間のフィードバックを学習に取り入れる、といったことが研究されています。

さらに、リリース前に専門家がAIの弱点を探す「外部レッドチーミング」も重要な安全対策です。

OpenAIも「o1」モデルのリリース前に実施したことを報告しています。

“This report outlines the safety work carried out prior to releasing OpenAI o1, including external red teaming and frontier risk evaluations.”

出典:OpenAI

- 日本語訳

-

本レポートでは、OpenAI o1リリース前に実施した安全性検証作業(外部レッドチーミングやフロンティアリスク評価を含む)についてまとめています。

問題解決への取り組みは、AIが意図しない振る舞いをするリスクに対処するための最先端研究です。

現時点で決定打はないものの、継続的な投資と検証が欠かせない分野です。

AI Safety Summit・G7ヒロシマAIプロセスなど規制ガバナンス動向

技術だけでは限界がある…となると、次に重要になるのがルール作り、つまり「規制とガバナンス」です。

記憶に新しいのは、2023年11月にイギリスで開かれた初の「AI Safety Summit」でしょう。

このサミットでは、主要国やAI企業が集まり、「ブレッチリー宣言」(最先端AI安全開発の初の国際合意)が合意されました。

“On 1 November, countries attending agreed to the Bletchley Declaration on AI safety, committing to work towards the safe development of frontier AI.”

出典:Gov.uk公式サイト

- 日本語訳

-

11月1日、参加各国は『ブレッチリー宣言』に合意し、フロンティアAIの安全な開発に向けて協力することを約束しました。

G7(主要7カ国)の枠組みでも動きがあります。

「G7広島AIプロセス」は、信頼できるAIの実現を目指す国際的な取り組みです。

“The Hiroshima AI Process was launched by the G7 under Japan’s presidency in May 2023, with the aim of promoting safe, secure, and trustworthy AI.”

出典:政府「絆」ポータル

- 日本語訳

-

G7広島AIプロセスは2023年5月に日本の議長国として立ち上げられ、安全で確実かつ信頼できるAIを促進することを目的としています。

技術開発と並行して、国際社会全体でルールを作り、ガバナンスを効かせていこうという動きが加速していますね。

国際的なルール作りが、将来のAGI・ASI時代に向けた重要な土台となるでしょう。

AGIピル構想とは?社会倫理・自由意志・人間性を揺るがす影響

A技術開発の最前線であるシリコンバレーでは、切迫感のある議論も交わされています。

この議論を象徴するスラングとして「AGIピルを飲む」という言葉があります。

「AGIピルを飲む」とは、AGIによる軍拡競争や人類存亡リスクを「自分ごと」として捉え、覚悟をもって行動する姿勢や考え方を指します。

危機感の背景にあるのは、AGIが「核兵器以来の軍事革命を引き起こす可能性がある」という懸念です。

“Military and intelligence leaders see AGI as a potential revolution in military affairs, perhaps the most significant since nuclear weapons.”

出典:arXiv

- 日本語訳

-

軍や諜報機関のリーダーたちは、AGIを軍事における革命、おそらく核兵器以来最も重大な変化となるものと見なしている。

この懸念は単なる憶測ではありません。

実際、以下のような技術はすでに試験運用が始まっています。

- 自律型ドローン部隊の指揮統制

- AI搭載サイバー防衛システム

- 高度監視・偵察プラットフォーム

軍事用のAIシステムがAGIレベルに達すると「瞬時の意思決定+自己学習」で従来の抑止バランスを一変させるリスクがあります。

この影響は国家の根幹を揺るがすだけでなく、人類存続をも脅かす深刻なリスクとして認識されています。

“Mitigating the risk of extinction from AI should be a global priority alongside other societal-scale risks such as pandemics and nuclear war.”

出典:Center for AI Safety

- 日本語訳

-

AIによる絶滅リスクの軽減は、パンデミックや核戦争と同様に、国際的な最優先課題とすべきである。

技術的な進歩にただ期待するだけでなく、現実のリスクを直視し、主体的に行動すること。

つまり「AGIピルを飲む」覚悟が求められています。

AGIは数年内?レオポルド氏の警告と中小企業の取るべき行動

AGIやASI時代の到来はすぐそこに迫っています。

元OpenAI研究者レオポルド・アッシェンブレナー氏は、自身のエッセイで次のように警鐘を鳴らしています。

“Everyone is now talking about AI, but few have the faintest glimmer of what is about to hit them. Before long, the world will wake up. But right now, there are perhaps a few hundred people … that have situational awareness.”

出典:Situational Awareness

- 日本語

-

今や誰もがAIを語っていますが、自分に何が迫っているのかをかすかにでも感じ取っている人はほとんどいません。まもなく世界は目覚めるでしょう。しかし現状、状況認識を備えているのはサンフランシスコや各AI研究所にいる数百人ほどにすぎないのです。

「状況認識不足」を放置すると、取り返しのつかない機会損失を招くリスクがあります。

そこで、中小企業が取り組むべきアクションは以下の4つです。

- 経営層主導の情報収集・共有

- スモールスタートで学習サイクルを高速化

- AI関連予算の計画的確保

- 社内リスキリング&AIリテラシー向上

経営層自らAGIやASIの最新動向を把握し、「AIブリーフィング」で全社に共有します。

小規模なPoC(FAQボットや翻訳ツール等)を迅速に回し、得た知見をもとに学びのサイクルを加速させます。

さらに、売上の5〜10%をAI関連の予算として先取りし、ツール導入や研修、リスク検証を計画的に実行。

そして「プロンプトエンジニア」「AI監査担当」など、新たな役割の設置と社員研修により、組織全体のAIリテラシーを高めます。

AI活用基盤の強化により、未知の変化をチャンスに変え、持続的な成長と競争優位を目指せるのではないでしょうか。

まとめ

AI進化の主要カテゴリーであるANI・AGI・ASIは、それぞれ異なる特徴と課題を持っています。

生成AIは、次の進化段階に向かう起点になっています。

それぞれの特徴は以下の通りです。

- 特定タスクに特化した「ANI」

- 新たなコンテンツを生み出す「生成AI」

- 幅広い知的作業を目指す「AGI」

- 人間を超える能力を持つ「ASI」

技術開発の加速とともに、安全性や倫理面への対応も急務となっています。

AIの進化と社会への影響拡大を見据え、 私たち一人ひとりが今できる行動を意識することが大切です。

まずは、身近なところからAI動向にアンテナを立て、できる一歩を踏み出してみましょう。